🌷🍁 博主猫头虎 带您 Go to New World.✨🍁

🦄 博客首页——猫头虎的博客🎐

🐳《面试题大全专栏》 文章图文并茂🦕生动形象🦖简单易学!欢迎大家来踩踩~🌺

🌊 《IDEA开发秘籍专栏》学会IDEA常用操作,工作效率翻倍~💐

🌊 《100天精通Golang(基础入门篇)》学会Golang语言,畅玩云原生,走遍大小厂~💐

🪁🍁 希望本文能够给您带来一定的帮助🌸文章粗浅,敬请批评指正!🍁🐥

自建类ChatGPT服务:本地化部署与远程访问教程

摘要

本文介绍了如何在Windows 10系统上,通过使用Text generation web UI和cpolar内网穿透工具,搭建和远程访问自建类ChatGPT服务。文章详细介绍了安装Text generation web UI和语言模型、安装cpolar内网穿透工具、创建公网地址和固定公网地址的步骤,帮助读者快速搭建并远程访问自定义的大型语言模型。

引言

随着大型语言模型在自然语言处理领域的广泛应用,许多研究者和开发者对如何在本地进行自建类ChatGPT服务,并通过远程访问来提高效率和满足私有化部署的需求产生了兴趣。Text generation web UI为类ChatGPT的大型语言模型提供了一个友好的网页界面,使其易于使用和自定义。本文将介绍如何将Text generation web UI与cpolar内网穿透工具结合使用,实现从本地化部署到最后的远程访问。

导语

本文将指导读者通过简单的步骤在Windows 10系统上搭建自建类ChatGPT服务,并通过cpolar内网穿透工具实现远程访问。通过这种方法,读者可以轻松地拥有一个自定义的语言模型服务,无论是用于个人学习研究还是商业应用,都能得到便捷的体验。

系统环境

Windows 10

Python 3.11.4

1. 安装Text generation web UI

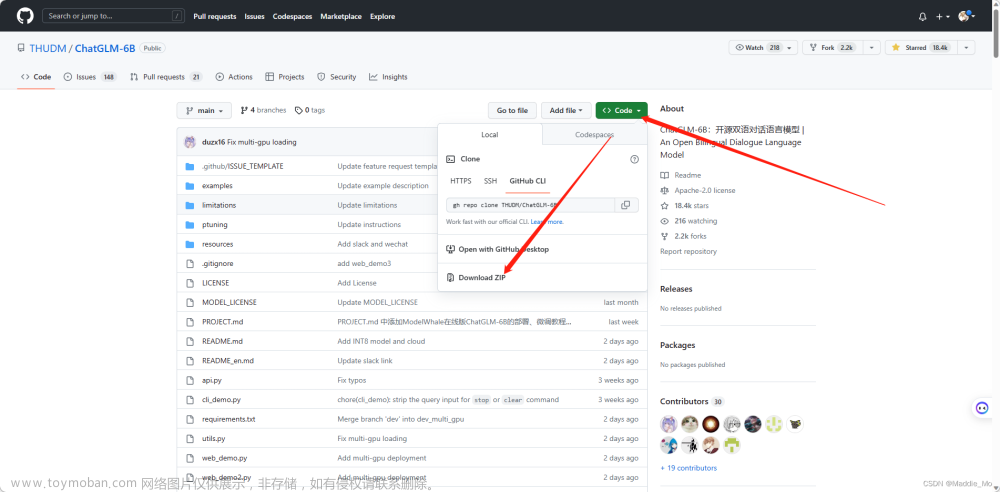

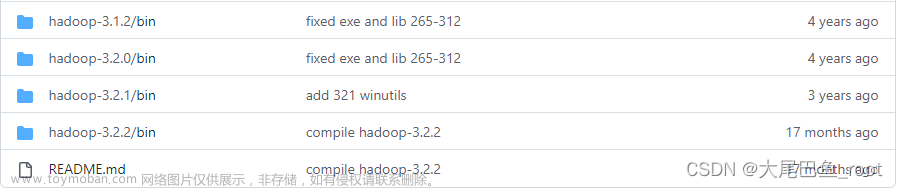

在github界面下载压缩包,这里以windows系统为例:

https://github.com/oobabooga/text-generation-webui

使用windows系统,我们下载windows压缩包:

下载后,这里注意:存放目录的路径不能有空格,然后点击start_windows.bat启动安装。

在安装过程中会提示选择显卡类型,根据电脑配置正常选择即可,然后等待下载,下载大小2个GB左右大小资源。

2.安装依赖

上面安装后会出现两个文件夹,可以看到其中一个是text-generation-webui 名称文件夹,我们点击cmd_windows.bat打开cmd命令行。

打开后,进入text-generation-webui文件夹:

cd text-generation-webui

执行下载依赖命令,注意!!!这里需要kx上网,否则下载依赖会发生错误,包括后面也一直需要保持kx上网哦!!!

pip install -r requirements.txt

执行后等待下载完成即可

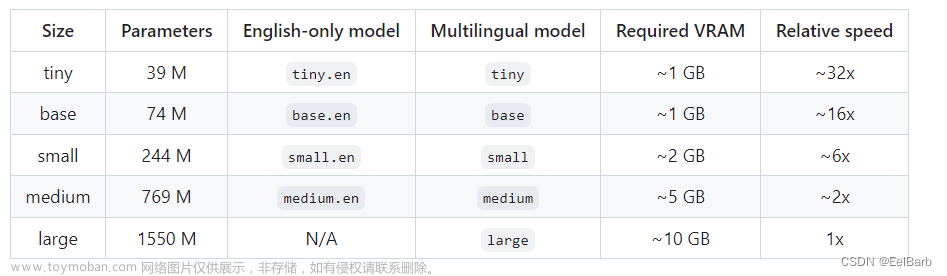

3. 安装语言模型

同意点击cmd_windows.bat打开cmd命令行,进入

输入命令进入text-generation-webui文件夹

cd text-generation-webui

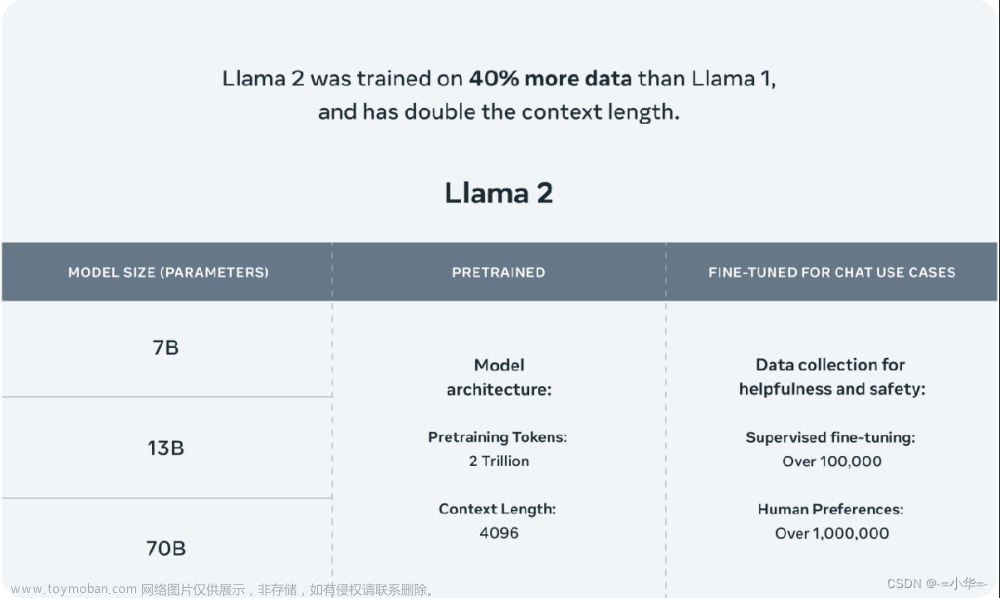

安装facebook语言模型,其他语言模型可以查看GitHub文档上面找到:

python download-model.py facebook/opt-1.3b

输入后等待下载安装完成即可,为了防止出现下载失败,建议开启kx上网!

4. 启动

点击start_windows.bat启动

启动后,可以看到访问的地址和端口,端口是:7860

在浏览器输入上述URL,即可看到web ui 界面:

设置一下语言模型,点击Model,在下拉框可以看到我们上面下载安装的facebook模型,选择后点击Load,然后保存设置。

然后输入即可对话,这样就搭建好了,可玩度很高,且可以扩展其他语言模型!

5. 安装cpolar 内网穿透

cpolar内网穿透工具,永久免费且不限制流量,支持http/https/tcp协议,无需公网IP,也不用设置路由器,使用简单。

cpolar官网:https://www.cpolar.com/

访问cpolar官网,注册一个账号,然后下载并安装客户端,具体安装教程可以参考官网文档教程。

- windows系统:在官网下载安装包后,双击安装包一路默认安装即可。

- linux系统:支持一键自动安装脚本,详细请参考官网文档——入门指南

cpolar安装成功后,在浏览器上访问本地9200端口【http://localhost:9200】,使用cpolar账号登录。

6. 创建公网地址

点击左侧仪表盘的隧道管理——创建隧道,创建一个我们上面的text generation webui 的http访问方式的7860隧道

- 隧道名称:可自定义命名,注意不要与已有的隧道名称重复

- 协议:选择http

- 本地地址:7860

- 域名类型:免费选择随机域名

- 地区:选择China vip

点击创建

隧道创建成功后,点击左侧的状态——在线隧道列表,查看所生成的公网地址,有两种访问方式,一种是http 和https

7. 公网访问

我们使用http公网地址访问,可以看到,我们访问到了text generation webui 界面,这样一个公网地址访问就创建好了。

8. 固定公网地址

由于以上使用cpolar所创建的隧道使用的是随机公网地址,24小时内会随机变化,不利于长期远程访问。因此我们可以为其配置二级子域名,该地址为固定地址,不会随机变化【ps:cpolar.cn已备案】

注意需要将cpolar套餐升级至基础套餐或以上,且每个套餐对应的带宽不一样。【cpolar.cn已备案】

登录cpolar官网,点击左侧的预留,选择保留二级子域名,地区选择china vip top,然后设置一个二级子域名名称,填写备注信息,点击保留。

保留成功后复制保留的二级子域名地址:

登录cpolar web UI管理界面,点击左侧仪表盘的隧道管理——隧道列表,找到所要配置的隧道,点击右侧的编辑。

修改隧道信息,将保留成功的二级子域名配置到隧道中

- 域名类型:选择二级子域名

- Sub Domain:填写保留成功的二级子域名

- 地区: China VIP

点击更新

更新完成后,打开在线隧道列表,此时可以看到随机的公网地址已经发生变化,地址名称也变成了保留和固定的二级子域名名称。

最后,我们使用固定的公网地址访问text generation webui 界面可以看到访问成功,一个永久不会变化的远程访问方式即设置好了。

转载自cpolar极点云文章:本地化部署自建类ChatGPT服务远程访问

总结

本文详细介绍了在Windows 10系统上搭建自建类ChatGPT服务并实现远程访问的步骤。首先,通过下载Text generation web UI并安装依赖,成功部署了类ChatGPT的大型语言模型。然后,使用cpolar内网穿透工具创建了一个公网地址,并通过固定公网地址保证了长期稳定的远程访问。通过这样的搭建,读者可以方便地在本地操作和定制语言模型,同时通过远程访问实现更加灵活的使用方式。

原创声明

=======

作者wx: [ libin9iOak ]

本文为原创文章,版权归作者所有。未经许可,禁止转载、复制或引用。

作者保证信息真实可靠,但不对准确性和完整性承担责任。

未经许可,禁止商业用途。

如有疑问或建议,请联系作者。

感谢您的支持与尊重。文章来源:https://www.toymoban.com/news/detail-625667.html

点击

下方名片,加入IT技术核心学习团队。一起探索科技的未来,共同成长。文章来源地址https://www.toymoban.com/news/detail-625667.html

到了这里,关于自建类ChatGPT服务:本地化部署与远程访问教程的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!