LangChain+ChatGLM大模型应用落地实践(一)

LLaMa模型GitHub地址

git lfs clone https://huggingface.co/huggyllama/llama-7b

添加LLaMa模型配置

在Langchain-ChatGLM/configs/model_config.py中llm_model_dict添加

"llama-7b": {

"name": "llama-7b",

"pretrained_model_name": "/home/user/data/your_path/llama-7b",

"local_model_path": "/home/user/data/your_path/llama-7b",

"provides": "LLamaLLMChain"

}

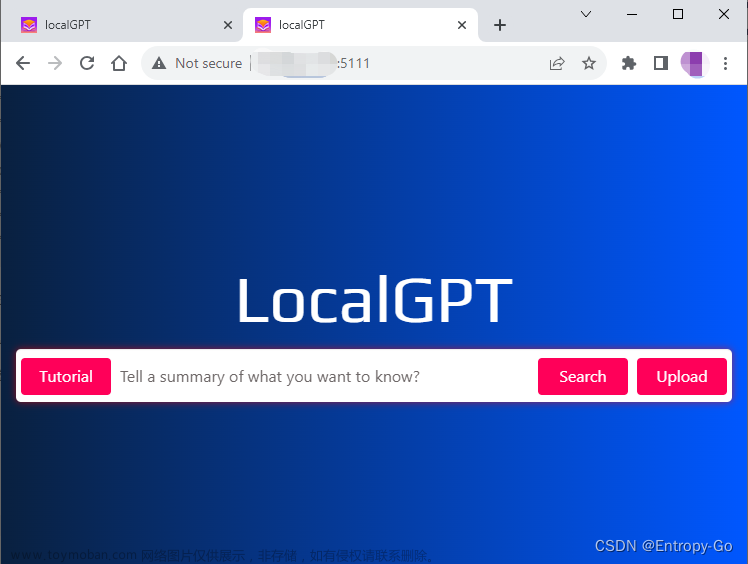

启用LLaMa模型

进入Web UI选择LLaMa模型

文章来源:https://www.toymoban.com/news/detail-629610.html

文章来源:https://www.toymoban.com/news/detail-629610.html

LLAMA-7B(中文提问当作翻译回答了…看来训练的中文语料不太行,但是英文也算是答对了)

具体为什么LLaMa为什么这样回答,等待后续。文章来源地址https://www.toymoban.com/news/detail-629610.html

到了这里,关于LangChain+ChatGLM整合LLaMa模型(二)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[NLP] 使用Llama.cpp和LangChain在CPU上使用大模型-RAG](https://imgs.yssmx.com/Uploads/2024/02/765060-1.png)