Llama 2 with langchain项目详解(三)

17.3 Llama 2 with langchain基础

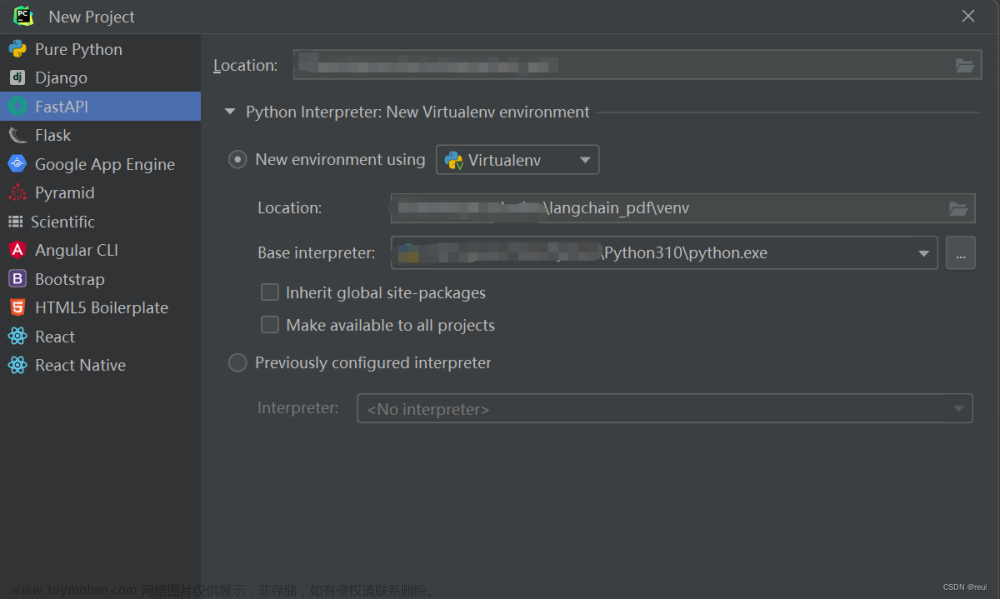

本节讲解在LangChain中使用Llama 2模型的基础知识,展示如何运行LangChain的代码,及在云端运行Llama 2的700亿模型。

首先,使用Python的pip管理器安装一系列库,包括huggingface/transformers、datasets、loralib、sentencepiece、bitsandbytes、accelerate、xformers、einops和langchain。文章来源地址https://www.toymoban.com/news/detail-629674.html

1. !pip -q install git+https://github.com/huggingface/transformers # need to install from github

2. !pip install -q datasets loralib sentencepiece

3. !pip -文章来源:https://www.toymoban.com/news/detail-629674.html

到了这里,关于Llama 2 with langchain项目详解(三)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[NLP] 使用Llama.cpp和LangChain在CPU上使用大模型-RAG](https://imgs.yssmx.com/Uploads/2024/02/765060-1.png)