Transformer架构是一种重要的神经网络模型架构,最初由Vaswani等人在2017年提出,并在机器翻译任务上取得了显著的性能提升。Transformer架构在自然语言处理领域得到广泛应用,特别是在语言模型、机器翻译和文本生成等任务中。

Transformer架构的核心思想是使用自注意力机制(self-attention mechanism)来建立输入序列的表示。相比于传统的循环神经网络(RNN)架构,Transformer不需要按顺序逐步处理输入序列,而是可以并行地处理整个序列。

Transformer架构由两个主要组件组成:编码器(Encoder)和解码器(Decoder)。编码器负责将输入序列编码成一个表示,解码器则根据该表示生成输出序列。

编码器和解码器都由多个相同层级的模块堆叠而成。每个模块内部由两个子层组成:多头自注意力机制层(multi-head self-attention layer)和前馈神经网络层(feed-forward neural network layer)。

在自注意力机制中,输入序列中的每个位置都与其他位置进行交互,根据它们之间的相关性分配不同的权重。这有助于模型捕捉输入序列中的全局信息,并建立更好的表示。

前馈神经网络层则对每个位置的表示进行非线性变换和特征提取,进一步增强表示能力。

此外,Transformer还引入了位置编码(position encoding)来将序列中每个位置的信息与其相对位置关联起来。这允许模型辨识输入序列中的顺序信息。

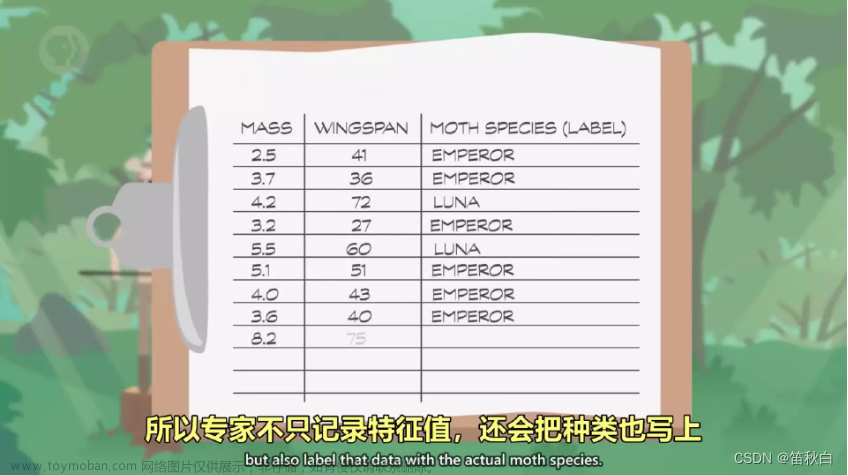

在训练阶段,Transformer使用有监督学习的方式进行训练,通过最小化目标标签与模型生成序列之间的差异来调整模型参数。通常使用交叉熵损失函数进行优化。

Transformer架构的优势在于它可以处理较长的输入序列,并且由于并行化的设计,训练和推理速度较快。此外,自注意力机制使得模型能够捕捉输入序列中不同位置之间的依赖关系,增强了模型的表达和建模能力。文章来源:https://www.toymoban.com/news/detail-634137.html

总而言之,Transformer架构是一种基于自注意力机制的神经网络模型架构,广泛用于自然语言处理任务。它的设计使得它在处理长文本序列时表现优秀,并取得了许多NLP任务的突破性进展。文章来源地址https://www.toymoban.com/news/detail-634137.html

到了这里,关于Transformer架构的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!