在现代的分布式系统中,延迟队列是一种常见的解决方案,用于处理具有延迟要求的任务或消息。Apache Kafka是一个高性能、可扩展的分布式消息队列,可以作为延迟队列的基础设施。本文将介绍如何使用Kafka实现延迟队列,并提供详细的Java示例。

什么是延迟队列?

延迟队列是一种特殊的消息队列,可以将消息或任务推迟到指定的时间再进行处理。它通常用于处理需要在未来某个时间点执行的任务,如定时任务、延迟通知等。延迟队列允许开发人员根据任务的延迟要求进行灵活的调度和处理。

使用Kafka实现延迟队列的方式

Kafka本身并没有提供原生的延迟队列功能,但我们可以通过一些技术手段来实现延迟队列的功能。下面介绍两种常见的实现方式。

方式一:使用消息的时间戳和消费者组

Kafka消息具有时间戳(timestamp)属性,我们可以利用这个属性来实现延迟队列。具体步骤如下:

- 生产者发送消息时,设置消息的时间戳为需要延迟的时间点。

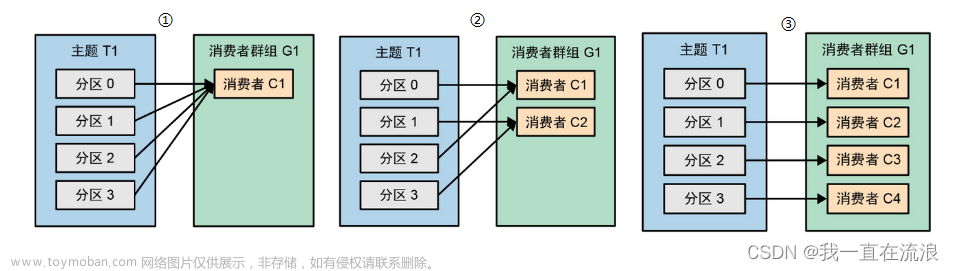

- 消费者以消费者组的方式订阅主题,并设置适当的消费者偏移量(offset)。

- 消费者定期拉取消息,并根据消息的时间戳判断是否达到处理时间。

- 如果消息的时间戳大于当前时间,则将消息重新发送到延迟队列的主题中。

- 延迟队列的消费者订阅延迟队列的主题,并在延迟时间到达后处理消息。

下面是一个使用Java编写的示例代码:

// 生产者发送延迟消息

ProducerRecord<String, String> record = new ProducerRecord<>("my_topic", "my_key", "my_value");

long delay = System.currentTimeMillis() + 5000; // 5秒延迟

record.headers().add("delay", String.valueOf(delay).getBytes());

producer.send(record);

// 消费者处理延迟消息

ConsumerRecords<String, String> records = consumer.poll(Duration.ofMillis(100));

for (ConsumerRecord<String, String> record : records) {

long delay = Long.parseLong(record.headers().lastHeader("delay").value());

if (delay <= System.currentTimeMillis()) {

// 处理消息

processMessage(record);

} else {

// 将消息重新发送到延迟队列

producer.send(record);

}

}

方式二:使用Kafka Streams的事件时间(event time)

Kafka Streams是Kafka提供的一种流处理框架,可以用于实时处理和转换数据。我们可以利用Kafka Streams的事件时间功能来实现延迟队列。具体步骤如下:

- 生产者发送消息时,设置消息的时间戳为需要延迟的时间点。

- 使用Kafka Streams处理消息流,并根据消息的事件时间进行窗口操作。

- 在窗口操作中,根据窗口的结束时间判断是否达到处理时间。

- 如果窗口的结束时间大于当前时间,则将消息重新发送到延迟队列的主题中。

- 延迟队列的消费者订阅延迟队列的主题,并在延迟时间到达后处理消息。

下面是一个使用Java编写的示例代码:

KStream<String, String> stream = builder.stream("my_topic");

stream

.filter((key, value) -> {

long delay = Long.parseLong(value);

return delay <= System.currentTimeMillis();

})

.foreach((key, value) -> {

// 处理消息

processMessage(key, value);

});

stream

.filter((key, value) -> {

long delay = Long.parseLong(value);

return delay > System.currentTimeMillis();

})

.to("delayed_topic");

总结

本文介绍了如何使用Kafka实现延迟队列的两种方式。无论是使用消息的时间戳和消费者组,还是使用Kafka Streams的事件时间,都可以实现灵活的延迟队列功能。通过合理的设计和调度,我们可以在分布式系统中实现高效、可靠的延迟任务处理。

希望本文对你理解Kafka延迟队列的实现方式有所帮助。如果你有任何问题或疑问,请随时提问。谢谢阅读!

参考文献:文章来源:https://www.toymoban.com/news/detail-636599.html

- Apache Kafka Documentation

- Kafka Streams Documentation

- Kafka: A Distributed Streaming Platform

👉 💐🌸 公众号请关注 "果酱桑", 一起学习,一起进步! 🌸💐

文章来源地址https://www.toymoban.com/news/detail-636599.html

到了这里,关于Kafka延迟队列的实现方式的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!