Ubuntu下nvidia-smi失败,使用dkms解决

错误信息

nvidia-smi显示无法与驱动通讯

NVIDIA-SMI has failed because it couldn't communicate with the NVIDIA driver. Make sure that the latest NVIDIA driver is installed and running.

原因

一般来说是因为机器重启linux内核自动更新导致,可以尝试回退内核版本,或者使用dkms安装该内核下驱动配套的包,这里主要介绍使用dkms如何处理

解决步骤

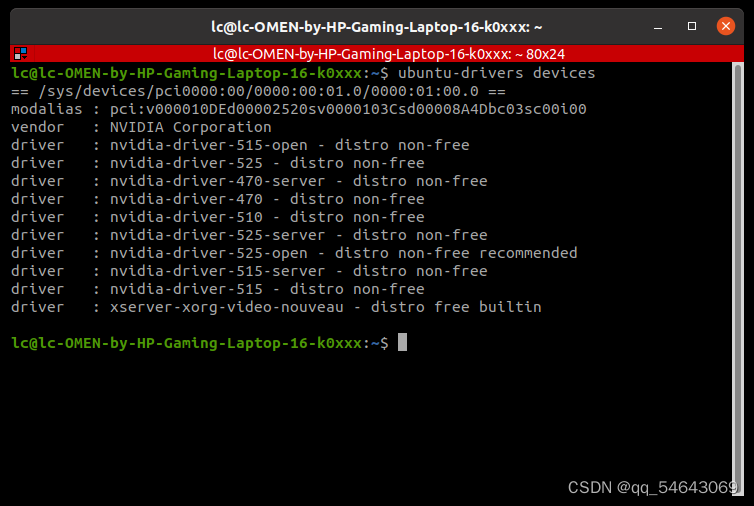

查看已安装的nvidia驱动版本

ls /usr/src | grep nvidia

显示

nvidia-525.116.04

说明我电脑上nvidia驱动的版本是nvidia-525.116.04

安装dkms和相关包

安装dkms

sudo apt install dkms

安装相关包(注意-v后更换成自己的nvidia版本)文章来源:https://www.toymoban.com/news/detail-638974.html

sudo dkms install -m nvidia -v 525.116.04

重启系统,nvidia-smi成功输出!文章来源地址https://www.toymoban.com/news/detail-638974.html

到了这里,关于Ubuntu下nvidia-smi失败,使用dkms解决的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!