一、说明

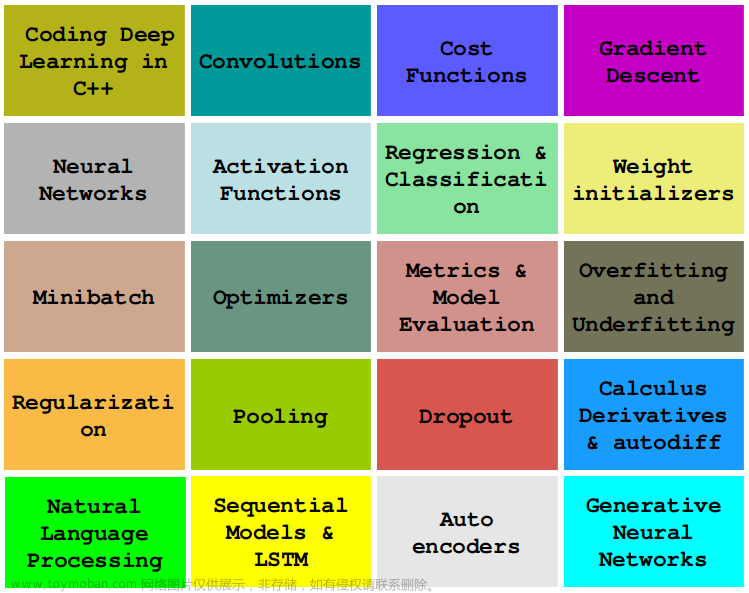

在本系列中,我们将学习如何仅使用普通和现代C++编写必须知道的深度学习算法,例如卷积、反向传播、激活函数、优化器、深度神经网络等。文章来源:https://www.toymoban.com/news/detail-640464.html

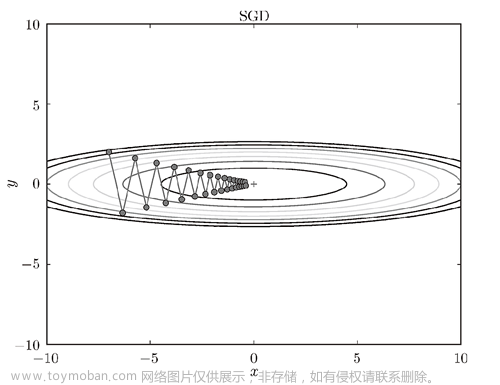

在这个故事中,我们将通过引入梯度下降算法来介绍数据中 2D 卷积核的拟合。我们将使用卷积和上一个故事中引入的成本函数概念,将所有内容编码为现代C++和特文章来源地址https://www.toymoban.com/news/detail-640464.html

到了这里,关于现代C++中的从头开始深度学习:【4/8】梯度下降的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![计算机视觉与深度学习-全连接神经网络-详解梯度下降从BGD到ADAM - [北邮鲁鹏]](https://imgs.yssmx.com/Uploads/2024/02/732482-1.gif)