1 引言

在学习无监督学习时,最常用的loss就是最大化互信息。所以本文对互信息最大化做了一个总结。内容和图片多有参考其他资料,相关的文献一并在参考文献列出。(如果使用对比学习含有温度系数的那个损失函数可能会更简单一点)文章来源:https://www.toymoban.com/news/detail-646541.html

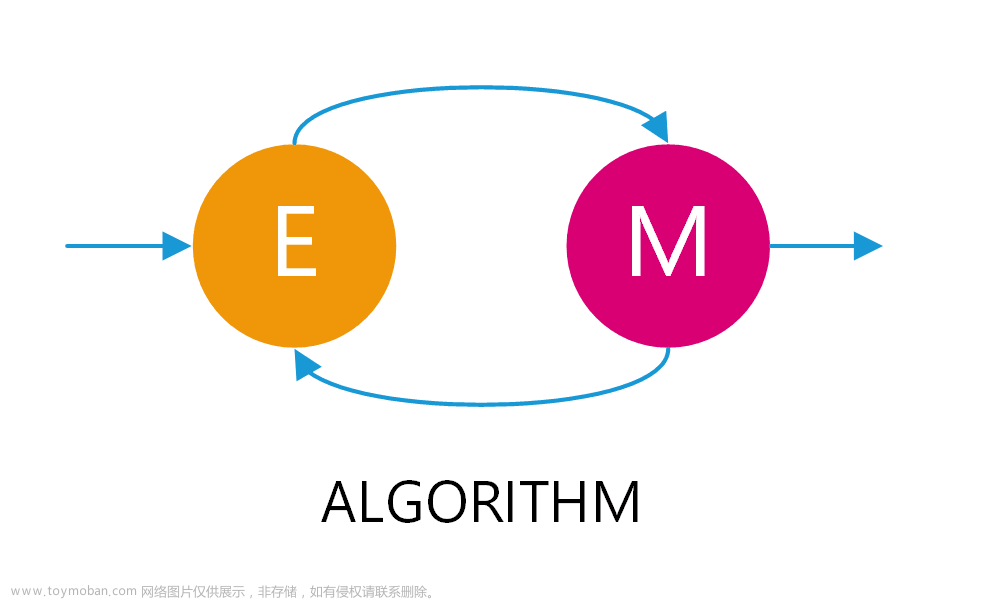

2 什么是互信息?

参考文献

[1]什么是「互信息」?

[2]DIM:通过最大化互信息来学习深度表征

[3]【互信息 Deep InfoMax】Learning Deep Representations by Mutual Information Estimation and Maximization

[4]ICLR 2020 | 互信息视角下的表征学习

[5]互信息的深度理解(总结的不错值得一看)

[6]互信息在深度学习的应用

[6]对比学习(Contrastive Learning)综述

[7]特征选择之互信息(mutual information)算法思想及其python代码实现

[8]互信息(Mutual Information)浅尝辄止(一):基础概念

[9]概率论:三、随机变量的期望和方差

[10]【AP统计】期望E(X)与方差Var(X)

[11]随机变量的期望E(x)与X的平均值之间的区别与联系?

[12]动手学深度学习-信息论文章来源地址https://www.toymoban.com/news/detail-646541.html

到了这里,关于【深度学习】什么是互信息最大化?的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!