SLAM简介

视觉SLAM,主要指的是利用相机完成建图和定位问题。如果传感器是激光,那么就称为激光SLAM。

定位(明白自身状态(即位置))+建图(了解外在环境)。

视觉SLAM中使用的相机与常见的单反摄像头并不是一个东西,它更简单,不携带昂贵的镜头,以一定速率拍摄周围环境,形成一个连续的视频流。

在SLAM(同时定位与地图构建)中,常用的相机种类包括以下几种:

-

RGB相机:RGB相机是最常用的相机类型之一,它可以捕获彩色图像。通常使用标准的RGB传感器来获取图像,并可以通过软件处理来提取深度信息。 -

深度相机:深度相机也被称为RGB-D相机,它不仅可以捕获彩色图像,还可以获取每个像素点到相机的距离信息。这些相机通常使用结构光、时间飞行或双目视觉等技术来测量物体和场景的深度。最大的特点是通过红外结构或ToF原理,像激光传感器那样,主动向物体发射光并接收返回的光。 -

单目相机:单目相机只有一个镜头,可以捕获二维图像(只是三维空间的二维映射)。由于只有一个视角,需要使用其他传感器或算法来估计深度信息。它以二维的形式记录了三维的世界,但是丢掉了场景中深度(距离)这一维度。 -

双目相机:双目相机具有两个镜头,可以模拟人眼的立体视觉。通过比较两个镜头捕获的图像之间的差异,可以计算得到场景的深度信息。 -

多目相机:多目相机包含三个或更多的镜头,可以提供更丰富的视角和深度信息。多目相机可以用于构建更精确和稳健的SLAM系统。

这些相机种类在SLAM中的选择取决于应用场景、需要的精度和实时性等因素。不同的相机类型有不同的优势和限制,选择合适的相机是设计SLAM系统时需要考虑的重要因素之一。

SLAM可以用来做什么:自主机器人+三维重建+AR

常用工具

htop

相当于windows任务管理器

直接输入htop即可运行

vim

文本编辑工具

terminator

超级终端

支持分栏和同时操作

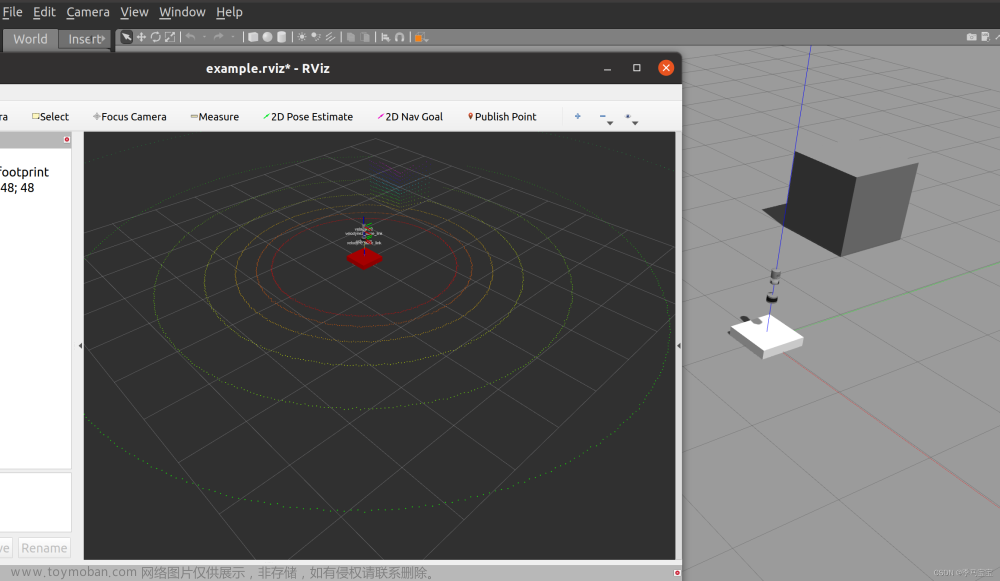

ros

机器人操作系统,去官网选择对应版本去装即可

经典视觉SLAM框架

视觉里程计

视觉里程计关心相邻图像之间的相机运动,视觉里程计能够通过相邻帧间的图像估计相机运动,并恢复场景的空间结构。

仅通过视觉里程计来估计轨迹,将不可避免的出现累积漂移,为了解决这个问题出现了后端优化(校正整个轨迹的形状)和回环检测(把“机器人回到原始位置”的事情检测出来)

后端优化:

主要指处理SLAM过程中的噪声问题。后端优化要考虑的问题就是如何从带有噪声的数据中估计整个系统的状态,以及这个状态估计的不确定性有多大–这叫做最大后验概率估计。

在SLAM中,前端给后端提供待优化的数据,后端负责整体的优化过程。前端和计算机视觉研究领域更为相关,比如图像的特征提取与匹配,后端主要是滤波与非线性优化算法。。

回环检测(闭环检测)

主要解决位置估计随时间漂移的问题。视觉回环检测实质上是一种计算图像数据相似性的算法。检测完后,会将信息告诉后端优化算法,然后后端优化算法根据这些新的信息,把轨迹和地图调整到符合回环检测结果的样子。

建图

根据不同的应用构建不同的地图。总体上可以分为:度量地图:强调精确地表示地图中物体的位置关系,通常用稀疏和稠密对其分类。稀疏图进行一定程度的抽象,并不需要表达所有物体,通常适用于定位。稠密地图着重于建模看到的所有东西,适用于导航。拓扑地图:更加强调地图元素之间的关系。由节点和边组成,只考虑节点间的连通性。 文章来源:https://www.toymoban.com/news/detail-647093.html

文章来源:https://www.toymoban.com/news/detail-647093.html

SLAM问题数学表示

xk代表在k时刻与xk处探测到某一个路标yi。uk是运动传感器的读数或者输入。wk为该过程加入的噪声。运动方程:

观测方程:

在xk位置看到某个路标点yi,产生了一个观测数据zk,j

vk,j是这次观测里的噪声。

针对不同的传感器,方程有不同的参数化形式。

总结为两个基本方程:

文章来源地址https://www.toymoban.com/news/detail-647093.html

文章来源地址https://www.toymoban.com/news/detail-647093.html

到了这里,关于视觉SLAM【第二讲-初识SLAM】的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!