林业有害生物防治是指针对危害森林健康的昆虫、病原菌、杂草等有害生物进行预防和控制的活动。这些有害生物可能会导致树木的衰弱、死亡,破坏森林生态系统的平衡,影响木材产量和质量,甚至对人类社会造成经济和环境损失。

以下是一些常见的林业有害生物防治方法:

生物防治:利用天敌、寄生虫、病原体等对有害生物进行控制。例如,引入天敌昆虫来捕食有害昆虫,或使用寄生虫寄生于害虫体内控制其繁殖。

化学防治:使用化学农药来控制有害生物的数量和影响。这需要根据不同的有害生物选择适当的农药,并注意使用方法和剂量,以最小化对环境和非靶标生物的影响。

物理防治:采用物理手段来防治有害生物,如挖掘、砍伐或焚烧感染的树木,以阻止有害生物传播。此外,还可以利用光线、温度等物理因素对有害生物进行控制。

集约管理:通过合理的林业管理措施,如间伐、修剪、灌溉等,改善林分的生长环境,增强树木的抵抗力,降低有害生物的侵害程度。

营造生态平衡:通过合理的植物多样性管理、退耕还林、生态恢复等措施,恢复和维护森林生态系统的平衡,降低有害生物的发生和侵害风险。

林业有害生物防治需要综合运用多种手段,并根据具体情况制定相应的防治计划。此外,科学研究和监测也是林业有害生物防治的重要组成部分,可以及时发现和预测有害生物的发生趋势,并采取相应措施进行防治。

基于AI人工智能技术进行林业有害生物检测防治是一种新兴的技术手段,具有很大的潜力,可以从以下几个维度进行实施:

图像识别:利用计算机视觉技术,通过拍摄树木的图像进行有害生物的检测。通过机器学习算法训练,可以让计算机对图像进行分析,并识别出有害生物的类型和数量。这种方法的优点是可以大规模地进行监测,且具有很高的准确性。

声学监测:利用有害生物活动产生的声音信号进行检测。通过对音频信号的收集和分析,可以确定有害生物的数量和类型,并对其行为进行监测。这种方法的优点是可以实时监测,且不需要接触树木。

传感器网络:利用传感器网络对树木进行全面的监测。通过布置传感器节点,可以实时监测树木的生长环境、健康状况和有害生物的活动情况。这种方法的优点是可以实现大范围、全面的监测,但需要大量的传感器节点和计算资源。

自然模型:利用自然模型对树木进行预测和监测。通过建立数学模型或生态模型,可以对树木的生长和健康状况进行预测,并根据模型结果进行有害生物的防治。这种方法的优点是可以综合考虑环境因素和树木本身的特点,但需要大量的数据和计算资源。

本文的主要思想就是一个尝试性的探索工作,受到前文的启发:

《全面拥抱AI时刻来临?基于AI技术助力养猪产仔是否可行?》

不过这二者的场景还是相差很大的,养殖行业的场地限制相对比较明显,摄像头的拍摄广度相对固定,而林业相关的场景则非常得广阔,不可能超大面积的铺设电缆覆盖摄像头,这样的成本和安全风险都是非常高的,探索性的方式可以选取具体的试点来具体细化实际的可行方式。

这里我没有这样的资源条件实地选取试点来进行实验,这里主要是一个想法层面的尝试,基于目标检测的方式来开发构建林业领域有害生物的智能化检测系统。首先看下效果图:

简单看下采集收集标注的数据集情况:

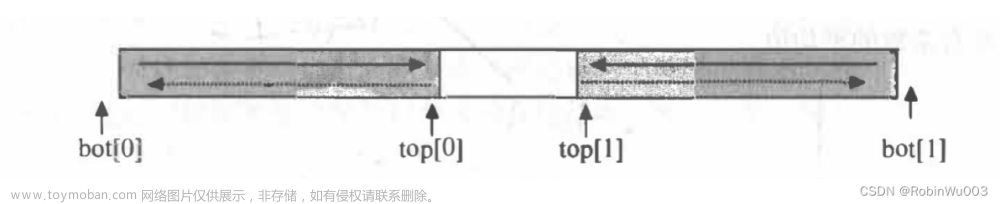

在模型层面主要开发构建了两款模型,分别为n系列和s系列模型。区别于原生模型,这里我在n和s两款模型中都加入了CBAM注意力模块来提升模型的性能,简单看下模型情况。

【yolov5n】

# YOLOv5 🚀 by Ultralytics, GPL-3.0 license

# Parameters

nc: 98 # number of classes

depth_multiple: 0.33 # model depth multiple

width_multiple: 0.25 # layer channel multiple

anchors:

- [10,13, 16,30, 33,23] # P3/8

- [30,61, 62,45, 59,119] # P4/16

- [116,90, 156,198, 373,326] # P5/32

# Backbone

backbone:

# [from, number, module, args]

[[-1, 1, Conv, [64, 6, 2, 2]], # 0-P1/2

[-1, 1, Conv, [128, 3, 2]], # 1-P2/4

[-1, 3, C3, [128]],

[-1, 1, Conv, [256, 3, 2]], # 3-P3/8

[-1, 6, C3, [256]],

[-1, 1, Conv, [512, 3, 2]], # 5-P4/16

[-1, 9, C3, [512]],

[-1, 1, Conv, [1024, 3, 2]], # 7-P5/32

[-1, 3, C3, [1024]],

[-1, 1, SPPF, [1024, 5]], # 9

]

# Head

head:

[[-1, 1, Conv, [512, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 6], 1, Concat, [1]], # cat backbone P4

[-1, 3, C3, [512, False]], # 13

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 4], 1, Concat, [1]], # cat backbone P3

[-1, 3, C3, [256, False]], # 17 (P3/8-small)

[-1, 1, Conv, [256, 3, 2]],

[[-1, 14], 1, Concat, [1]], # cat head P4

[-1, 3, C3, [512, False]], # 20 (P4/16-medium)

[-1, 1, Conv, [512, 3, 2]],

[[-1, 10], 1, Concat, [1]], # cat head P5

[-1, 3, C3, [1024, False]], # 23 (P5/32-large)

[-1, 1, CBAM, [1024]],

[[17, 20, 24], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

]

【yolov5s】

# YOLOv5 🚀 by Ultralytics, GPL-3.0 license

# Parameters

nc: 98 # number of classes

depth_multiple: 0.33 # model depth multiple

width_multiple: 0.50 # layer channel multiple

anchors:

- [10,13, 16,30, 33,23] # P3/8

- [30,61, 62,45, 59,119] # P4/16

- [116,90, 156,198, 373,326] # P5/32

# Backbone

backbone:

# [from, number, module, args]

[[-1, 1, Conv, [64, 6, 2, 2]], # 0-P1/2

[-1, 1, Conv, [128, 3, 2]], # 1-P2/4

[-1, 3, C3, [128]],

[-1, 1, Conv, [256, 3, 2]], # 3-P3/8

[-1, 6, C3, [256]],

[-1, 1, Conv, [512, 3, 2]], # 5-P4/16

[-1, 9, C3, [512]],

[-1, 1, Conv, [1024, 3, 2]], # 7-P5/32

[-1, 3, C3, [1024]],

[-1, 1, SPPF, [1024, 5]], # 9

]

# Head

head:

[[-1, 1, Conv, [512, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 6], 1, Concat, [1]], # cat backbone P4

[-1, 3, C3, [512, False]], # 13

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 4], 1, Concat, [1]], # cat backbone P3

[-1, 3, C3, [256, False]], # 17 (P3/8-small)

[-1, 1, Conv, [256, 3, 2]],

[[-1, 14], 1, Concat, [1]], # cat head P4

[-1, 3, C3, [512, False]], # 20 (P4/16-medium)

[-1, 1, Conv, [512, 3, 2]],

[[-1, 10], 1, Concat, [1]], # cat head P5

[-1, 3, C3, [1024, False]], # 23 (P5/32-large)

[-1, 1, CBAM, [1024]],

[[17, 20, 24], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

]

接下来具体看下结果详情。

【混淆矩阵】

混淆矩阵(Confusion Matrix)是在机器学习和统计学中常用的评估分类模型性能的工具。它展示了分类算法在给定数据集上预测结果与实际标签的对应关系。混淆矩阵是一个二维矩阵,行代表实际类别,列代表预测类别。混淆矩阵的示例如下:

Predicted Class

┌─────────┬─────────┬────────┐

Actual Class │ TP │ FP │ FN │

├─────────┼─────────┼────────┤

│ │ │ │

├─────────┼─────────┼────────┤

│ │ │ │

├─────────┼─────────┼────────┤

│ │ │ │

└─────────┴─────────┴────────┘

其中,TP(True Positive)表示预测为正类且实际为正类的样本数量,FP(False Positive)表示预测为正类但实际为负类的样本数量,FN(False Negative)表示预测为负类但实际为正类的样本数量。

通过混淆矩阵,我们可以计算出一些重要的分类评估指标,如准确率(Accuracy)、精确率(Precision)、召回率(Recall)和 F1 分数(F1-Score)。具体计算公式如下:

准确率 = (TP + TN) / (TP + FP + FN + TN)

精确率 = TP / (TP + FP)

召回率 = TP / (TP + FN)

F1 分数 = 2 * (精确率 * 召回率) / (精确率 + 召回率)

混淆矩阵的分析可以帮助我们了解分类模型的性能表现,准确评估模型的能力,并根据具体的需求进行调整和改进。

【Precision曲线】

精确率曲线(Precision-Recall Curve)是一种用于评估二分类模型在不同阈值下的精确率性能的可视化工具。它通过绘制不同阈值下的精确率和召回率之间的关系图来帮助我们了解模型在不同阈值下的表现。

精确率(Precision)是指被正确预测为正例的样本数占所有预测为正例的样本数的比例。召回率(Recall)是指被正确预测为正例的样本数占所有实际为正例的样本数的比例。

绘制精确率曲线的步骤如下:

使用不同的阈值将预测概率转换为二进制类别标签。通常,当预测概率大于阈值时,样本被分类为正例,否则分类为负例。

对于每个阈值,计算相应的精确率和召回率。

将每个阈值下的精确率和召回率绘制在同一个图表上,形成精确率曲线。

根据精确率曲线的形状和变化趋势,可以选择适当的阈值以达到所需的性能要求。

通过观察精确率曲线,我们可以根据需求确定最佳的阈值,以平衡精确率和召回率。较高的精确率意味着较少的误报,而较高的召回率则表示较少的漏报。根据具体的业务需求和成本权衡,可以在曲线上选择合适的操作点或阈值。

精确率曲线通常与召回率曲线(Recall Curve)一起使用,以提供更全面的分类器性能分析,并帮助评估和比较不同模型的性能。

【Recall曲线】

召回率曲线(Recall Curve)是一种用于评估二分类模型在不同阈值下的召回率性能的可视化工具。它通过绘制不同阈值下的召回率和对应的精确率之间的关系图来帮助我们了解模型在不同阈值下的表现。

召回率(Recall)是指被正确预测为正例的样本数占所有实际为正例的样本数的比例。召回率也被称为灵敏度(Sensitivity)或真正例率(True Positive Rate)。

绘制召回率曲线的步骤如下:

使用不同的阈值将预测概率转换为二进制类别标签。通常,当预测概率大于阈值时,样本被分类为正例,否则分类为负例。

对于每个阈值,计算相应的召回率和对应的精确率。

将每个阈值下的召回率和精确率绘制在同一个图表上,形成召回率曲线。

根据召回率曲线的形状和变化趋势,可以选择适当的阈值以达到所需的性能要求。

通过观察召回率曲线,我们可以根据需求确定最佳的阈值,以平衡召回率和精确率。较高的召回率表示较少的漏报,而较高的精确率意味着较少的误报。根据具体的业务需求和成本权衡,可以在曲线上选择合适的操作点或阈值。

召回率曲线通常与精确率曲线(Precision Curve)一起使用,以提供更全面的分类器性能分析,并帮助评估和比较不同模型的性能。

【F1值曲线】

F1值曲线是一种用于评估二分类模型在不同阈值下的性能的可视化工具。它通过绘制不同阈值下的精确率(Precision)、召回率(Recall)和F1分数的关系图来帮助我们理解模型的整体性能。

F1分数是精确率和召回率的调和平均值,它综合考虑了两者的性能指标。F1值曲线可以帮助我们确定在不同精确率和召回率之间找到一个平衡点,以选择最佳的阈值。

绘制F1值曲线的步骤如下:

使用不同的阈值将预测概率转换为二进制类别标签。通常,当预测概率大于阈值时,样本被分类为正例,否则分类为负例。

对于每个阈值,计算相应的精确率、召回率和F1分数。

将每个阈值下的精确率、召回率和F1分数绘制在同一个图表上,形成F1值曲线。

根据F1值曲线的形状和变化趋势,可以选择适当的阈值以达到所需的性能要求。

F1值曲线通常与接收者操作特征曲线(ROC曲线)一起使用,以帮助评估和比较不同模型的性能。它们提供了更全面的分类器性能分析,可以根据具体应用场景来选择合适的模型和阈值设置。

【batch计算实例】

文章来源:https://www.toymoban.com/news/detail-651261.html

文章来源:https://www.toymoban.com/news/detail-651261.html

这里一方面是各种有害生物的类别数量都不多,另一方面是有害生物的类别比较多将近一百种了,评估体现出来的部分效果还是很一般的,后期真正落地的时候可以考虑从数据源入手多做工作。文章来源地址https://www.toymoban.com/news/detail-651261.html

到了这里,关于AI助力林业有害生物防治,基于YOLOv5开发构建林业有害生物检测识别系统的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!