举个例子

查询 source 表,同时执行计算

# 通过 Table API 创建一张表:

source_table = table_env.from_path("datagen")

# 或者通过 SQL 查询语句创建一张表:

source_table = table_env.sql_query("SELECT * FROM datagen")

result_table = source_table.select(source_table.id + 1, source_table.data)Table API 查询

Table 对象有许多方法,可以用于进行关系操作。

这些方法返回新的 Table 对象,表示对输入 Table 应用关系操作之后的结果。

这些关系操作可以由多个方法调用组成,例如 table.group_by(...).select(...)。

Table API 文档描述了流和批处理上所有支持的 Table API 操作。

以下示例展示了一个简单的 Table API 聚合查询:

from pyflink.table import Environmentsettings, TableEnvironment

# 通过 batch table environment 来执行查询

env_settings = Environmentsettings.in_batch_mode()

table_env = TableEnvironment.create(env_settings)

orders = table_env.from_elements([('Jack', 'FRANCE', 10), ('Rose', 'ENGLAND', 30), ('Jack', 'FRANCE', 20)],['name', 'country', 'revenue'])

# 计算所有来自法国客户的收入

revenue = orders \

.select(orders.name, orders.country, orders.revenue) \

.where(orders.country == 'FRANCE') \

.group_by(orders.name) \

.select(orders.name, orders.revenue.sum.alias('rev_sum'))

revenue.to_pandas()Table API 也支持行操作的 API, 这些行操作包括 Map Operation, FlatMap Operation, Aggregate Operation 和 FlatAggregate Operation.

以下示例展示了一个简单的 Table API 基于行操作的查询

from pyflink.table import Environmentsettings, TableEnvironment

from pyflink.table import DataTypes

from pyflink.table.udf import udf

import pandas as pd

# 通过 batch table environment 来执行查询

env_settings = Environmentsettings.in_batch_mode()

table_env = TableEnvironment.create(env_settings)

orders = table_env.from_elements([('Jack', 'FRANCE', 10), ('Rose', 'ENGLAND', 30), ('Jack', 'FRANCE', 20)], ['name', 'country', 'revenue'])

map_function = udf(lambda x: pd.concat([x.name, x.revenue * 10], axis=1),

result_type=DataTypes.ROW(

[DataTypes.FIELD("name", DataTypes.STRING()),

DataTypes.FIELD("revenue", DataTypes.BIGINT())]),

func_type="pandas")

orders.map(map_function).alias('name', 'revenue').to_pandas()SQL 查询

Flink 的 SQL 基于 Apache Calcite,它实现了标准的 SQL。SQL 查询语句使用字符串来表达。SQL 支持Flink 对流和批处理。

下面示例展示了一个简单的 SQL 聚合查询:

from pyflink.table import Environmentsettings, TableEnvironment

# 通过 stream table environment 来执行查询

env_settings = Environmentsettings.in_streaming_mode()

table_env = TableEnvironment.create(env_settings)

table_env.execute_sql("""

CREATE TABLE random_source (

id BIGINT,

data TINYINT

) WITH (

'connector' = 'datagen',

'fields.id.kind'='sequence',

'fields.id.start'='1',

'fields.id.end'='8',

'fields.data.kind'='sequence',

'fields.data.start'='4',

'fields.data.end'='11'

)

""")

table_env.execute_sql("""

CREATE TABLE print_sink (

id BIGINT,

data_sum TINYINT

) WITH (

'connector' = 'print'

)

""")

table_env.execute_sql("""

INSERT INTO print_sink

SELECT id, sum(data) as data_sum FROM

(SELECT id / 2 as id, data FROM random_source)

WHERE id > 1

GROUP BY id

""").wait()Table API 和 SQL 的混合使用

Table API 中的 Table 对象和 SQL 中的 Table 可以自由地相互转换。

下面例子展示了如何在 SQL 中使用 Table 对象:

create_temporary_view(view_path, table) 将一个 `Table` 对象注册为一张临时表,类似于 SQL 的临时表。

# 创建一张 sink 表来接收结果数据

table_env.execute_sql("""

CREATE TABLE table_sink (

id BIGINT,

data VARCHAR

) WITH (

'connector' = 'print'

)

""")

# 将 Table API 表转换成 SQL 中的视图

table = table_env.from_elements([(1, 'Hi'), (2, 'Hello')], ['id', 'data'])

table_env.create_temporary_view('table_api_table', table)

# 将 Table API 表的数据写入结果表

table_env.execute_sql("INSERT INTO table_sink SELECT * FROM table_api_table").wait()下面例子展示了如何在 Table API 中使用 SQL 表:

sql_query(query) 执行一条 SQL 查询,并将查询的结果作为一个 `Table` 对象。

# 创建一张 SQL source 表

table_env.execute_sql("""

CREATE TABLE sql_source (

id BIGINT,

data TINYINT

) WITH (

'connector' = 'datagen',

'fields.id.kind'='sequence',

'fields.id.start'='1',

'fields.id.end'='4',

'fields.data.kind'='sequence',

'fields.data.start'='4',

'fields.data.end'='7'

)

""")

# 将 SQL 表转换成 Table API 表

table = table_env.from_path("sql_source")

# 或者通过 SQL 查询语句创建表

table = table_env.sql_query("SELECT * FROM sql_source")

# 将表中的数据写出

table.to_pandas()优化

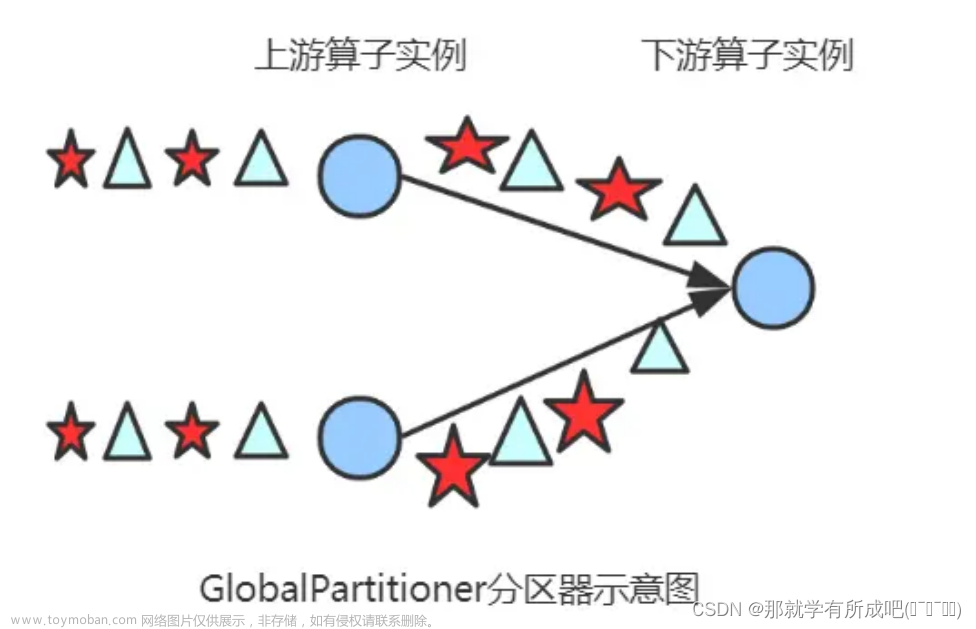

数据倾斜

当数据发生倾斜(某一部分数据量特别大),虽然没有GC(Gabage Collection,垃圾回收),但是task执行时间严重不一致。

- 需要重新设计key,以更小粒度的key使得task大小合理化。

- 修改并行度。

- 调用rebalance操作,使数据分区均匀。

缓冲区超时设置

由于task在执行过程中存在数据通过网络进行交换,数据在不同服务器之间传递的缓冲区超时时间可以通过setBufferTimeout进行设置。

当设置“setBufferTimeout(-1)”,会等待缓冲区满之后才会刷新,使其达到最大吞吐量;当设置“setBufferTimeout(0)”时,可以最小化延迟,数据一旦接收到就会刷新;当设置“setBufferTimeout”大于0时,缓冲区会在该时间之后超时,然后进行缓冲区的刷新。文章来源:https://www.toymoban.com/news/detail-658866.html

示例可以参考如下:文章来源地址https://www.toymoban.com/news/detail-658866.html

env.setBufferTimeout(timeoutMillis);

env.generateSequence(1,10).map(new MyMapper()).setBufferTimeout(timeoutMillis);到了这里,关于Flink流批一体计算(14):PyFlink Tabel API之SQL查询的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!