1、k8s简介

1.1、部署方式的变迁

-

传统部署时代:

- 在物理服务器上运行应用程序

- 无法为应用程序定义资源边界

- 导致资源分配问题

例如,如果在物理服务器上运行多个应用程序,则可能会出现一个应用程序占用大部分资源的情况, 结果可能导致其他应用程序的性能下降。 一种解决方案是在不同的物理服务器上运行每个应用程序,但是由于资源利用不足而无法扩展, 并且维护许多物理服务器的成本很高。

-

虚拟化部署时代:

- 作为解决方案,引入了虚拟化

- 虚拟化技术允许你在单个物理服务器的 CPU 上运行多个虚拟机(VM)

- 虚拟化允许应用程序在 VM 之间隔离,并提供一定程度的安全

- 一个应用程序的信息 不能被另一应用程序随意访问。

- 虚拟化技术能够更好地利用物理服务器上的资源

- 因为可轻松地添加或更新应用程序 ,所以可以实现更好的可伸缩性,降低硬件成本等等。

- 每个 VM 是一台完整的计算机,在虚拟化硬件之上运行所有组件,包括其自己的操作系统。

缺点:虚拟层冗余导致的资源浪费与性能下降

-

容器部署时代:

- 容器类似于 VM,但可以在应用程序之间共享操作系统(OS)。

- 容器被认为是轻量级的。

- 容器与 VM 类似,具有自己的文件系统、CPU、内存、进程空间等。

- 由于它们与基础架构分离,因此可以跨云和 OS 发行版本进行移植。

- 参照【Docker隔离原理- namespace 6项隔离(资源隔离)与 cgroups 8项资源限制(资源限制)】

裸金属:真正的物理服务器

容器优势:

- 敏捷性 敏捷应用程序的创建和部署:与使用 VM 镜像相比,提高了容器镜像创建的简便性和效率。

- 及时性 持续开发、集成和部署:通过快速简单的回滚(由于镜像不可变性),支持可靠且频繁的 容器镜像构建和部署。

- **解耦性:**关注开发与运维的分离:在构建/发布时创建应用程序容器镜像,而不是在部署时。 从而将应用程序与基础架构分离。

- 可观测性 可观察性不仅可以显示操作系统级别的信息和指标,还可以显示应用程序的运行状况和其他指标信号。

- 跨平台 跨开发、测试和生产的环境一致性:在便携式计算机上与在云中相同地运行。

- 可移植 跨云和操作系统发行版本的可移植性:可在 Ubuntu、RHEL、CoreOS、本地、 Google Kubernetes Engine 和其他任何地方运行。

- 简易性 以应用程序为中心的管理:提高抽象级别,从在虚拟硬件上运行 OS 到使用逻辑资源在 OS 上运行应用程序。

- 大分布式 松散耦合、分布式、弹性、解放的微服务:应用程序被分解成较小的独立部分, 并且可以动态部署和管理 - 而不是在一台大型单机上整体运行。

- 隔离性 资源隔离:可预测的应用程序性能。

- 高效性 资源利用:高效率和高密度

1.2、定义

Kubernetes 是一个可移植的、可扩展的开源平台,用于管理容器化的工作负载和服务,可促进声明式配置和自动化。 Kubernetes 拥有一个庞大且快速增长的生态系统。Kubernetes 的服务、支持和工具广泛可用。

1.3、Kubernetes提供的功能

-

服务发现和负载均衡

Kubernetes 可以使用 DNS 名称或自己的 IP 地址公开容器,如果进入容器的流量很大, Kubernetes 可以负载均衡并分配网络流量,从而使部署稳定。 -

存储编排

Kubernetes 允许你自动挂载你选择的存储系统,例如本地存储、公共云提供商等。 -

自动部署和回滚

你可以使用 Kubernetes 描述已部署容器的所需状态,它可以以受控的速率将实际状态 更改为期望状态。例如,你可以自动化 Kubernetes 来为你的部署创建新容器, 删除现有容器并将它们的所有资源用于新容器。 -

自动完成装箱计算

Kubernetes 允许你指定每个容器所需 CPU 和内存(RAM)。 当容器指定了资源请求时,Kubernetes 可以做出更好的决策来管理容器的资源。 -

自我修复

Kubernetes 重新启动失败的容器、替换容器、杀死不响应用户定义的 运行状况检查的容器,并且在准备好服务之前不将其通告给客户端。 -

密钥与配置管理

Kubernetes 允许你存储和管理敏感信息,例如密码、OAuth 令牌和 ssh 密钥。 你可以在不重建容器镜像的情况下部署和更新密钥和应用程序配置,也无需在堆栈配置中暴露密钥

为了生产环境的容器化大规模应用编排,必须有一个自动化的框架或系统

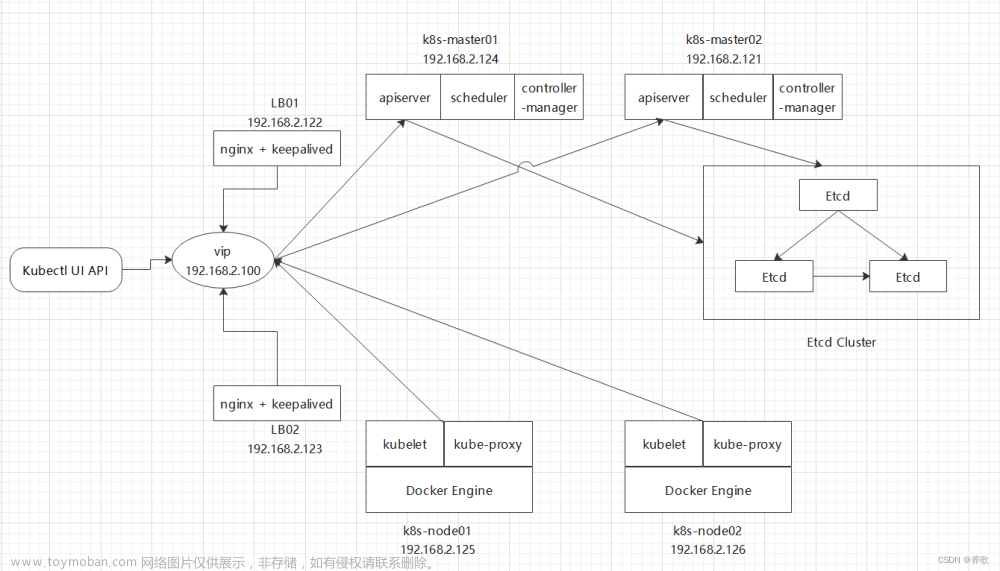

2、虚拟机快速搭建k8s集群

2.1、虚拟机配置(centos7 2G内存2个处理器)

建议最小硬件配置:2核CPU、2G内存、20G硬盘 服务器最好可以访问

| 名称 | IP |

|---|---|

| master | 192.168.40.128 |

| node01 | 192.168.40.129 |

| node02 | 192.168.40.130 |

2.2、基础环境准备

为三台虚拟机设置主机名

hostnamectl set-hostname k8s-master / k8s-node01 / k8s-node02 ==> 三台主机分别设置主机名

hostnamectl status

echo “127.0.0.1 $(hostname)” >> /etc/hosts

关闭 selinux

sed -i ‘s/enforcing/disabled/’ /etc/selinux/config

setenforce 0

关闭 swap

swapoff -a

sed -ri ‘s/.swap./#&/’ /etc/fstab

将桥接的 IPv4 流量传递到 iptables 的链

修改 /etc/sysctl.conf

如果有配置,则修改

sed -i “s#^net.ipv4.ip_forward.#net.ipv4.ip_forward=1#g" /etc/sysctl.conf

sed -i "s#^net.bridge.bridge-nf-call-ip6tables.#net.bridge.bridge-nf-call-ip6tables=1#g” /etc/sysctl.conf

sed -i “s#^net.bridge.bridge-nf-call-iptables.#net.bridge.bridge-nf-call-iptables=1#g" /etc/sysctl.conf

sed -i "s#^net.ipv6.conf.all.disable_ipv6.#net.ipv6.conf.all.disable_ipv6=1#g” /etc/sysctl.conf

sed -i “s#^net.ipv6.conf.default.disable_ipv6.#net.ipv6.conf.default.disable_ipv6=1#g" /etc/sysctl.conf

sed -i "s#^net.ipv6.conf.lo.disable_ipv6.#net.ipv6.conf.lo.disable_ipv6=1#g” /etc/sysctl.conf

sed -i “s#^net.ipv6.conf.all.forwarding.*#net.ipv6.conf.all.forwarding=1#g” /etc/sysctl.conf

可能没有,追加

echo “net.ipv4.ip_forward = 1” >> /etc/sysctl.conf

echo “net.bridge.bridge-nf-call-ip6tables = 1” >> /etc/sysctl.conf

echo “net.bridge.bridge-nf-call-iptables = 1” >> /etc/sysctl.conf

echo “net.ipv6.conf.all.disable_ipv6 = 1” >> /etc/sysctl.conf

echo “net.ipv6.conf.default.disable_ipv6 = 1” >> /etc/sysctl.conf

echo “net.ipv6.conf.lo.disable_ipv6 = 1” >> /etc/sysctl.conf

echo “net.ipv6.conf.all.forwarding = 1” >> /etc/sysctl.conf

执行命令以应用

sysctl -p

2.3、docker安装(易踩坑)

# 1.卸载旧的版本

sudo yum remove docker \

docker-client \

docker-client-latest \

docker-common \

docker-latest \

docker-latest-logrotate \

docker-logrotate \

docker-engine

# 2.安装基本的安装包

sudo yum install -y yum-utils

# 3.设置镜像仓库

sudo yum-config-manager \

--add-repo \

https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo # 阿里云镜像

# 更像软件包索引

yum makecache fast

# 4.安装docker引擎

yum install docker-ce docker-ce-cli containerd.io # docker-ce 社区版 ee 企业版

# 5.启动Docker

systemctl enable docker && systemctl start docker # 代表启动成功

# 6.测试docker可以docker的常用命令

docker version

docker images

docker ps

# 7.配置镜像加速

#配置docker加速

cat > /etc/docker/daemon.json << EOF

{

"registry-mirrors": ["https://b9pmyelo.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"]

}

EOF

# 重启docker

systemctl restart docker

# 查看docker信息

docker info

2.4、安装k8s组件

配置软件源

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

安装指定版本并启动

yum install -y kubelet-1.23.0 kubeadm-1.23.0 kubectl-1.23.0

systemctl enable kubelet && systemctl start kubelet

2.5、master节点部署

192.168.40.128换成自己主节点的IP地址

kubeadm init \

--apiserver-advertise-address=192.168.40.128 \

--image-repository registry.aliyuncs.com/google_containers \

--kubernetes-version v1.23.0 \

--service-cidr=10.96.0.0/12 \

--pod-network-cidr=10.244.0.0/16 \

--ignore-preflight-errors=all

######按照提示继续######

## init完成后第一步:复制相关文件夹

## To start using your cluster, you need to run the following as a regular user:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

## 导出环境变量

## Alternatively, if you are the root user, you can run:

export KUBECONFIG=/etc/kubernetes/admin.conf

2.6、部署网络插件

kubectl apply -f https://docs.projectcalico.org/manifests/calico.yaml

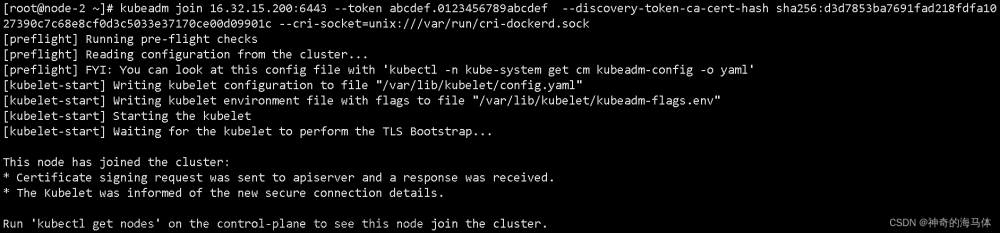

2.7、2台node节点的虚机加入主节点

##在两台node节点虚拟机上执行master节点kubeadm init 后生成的join代码

kubeadm join 192.168.40.128:6443 --token ixvxxd.oamu833eimbkvwt6 --discovery-token-ca-cert-hash sha256:fb6c95e8999315d12267287162973c08e319c731ac5f706d22199b2dfe08b8c2

**建议先重启node上的kubeadm**

kubeadm reset

## 过期怎么办

kubeadm token create --print-join-command

kubeadm token create --ttl 0 --print-join-command

kubeadm join --token y1eyw5.ylg568kvohfdsfco --discovery-token-ca-cert-hash sha256: 6c35e4f73f72afd89bf1c8c303ee55677d2cdb1342d67bb23c852aba2efc7c73

2.8、验证集群是否部署成功

#获取所有节点

kubectl get nodes

#给节点打标签

## k8s中万物皆对象。node:机器 Pod:应用容器

###加标签

kubectl label node k8s-02 node-role.kubernetes.io/worker=''

###去标签

kubectl label node k8s-02 node-role.kubernetes.io/worker-

## k8s集群,机器重启了会自动再加入集群,master重启了会自动再加入集群控制中心

2.9、设置ipvs模式

k8s整个集群为了访问通;默认是用iptables,性能下(kube-proxy在集群之间同步iptables的内容)

#1、查看默认kube-proxy 使用的模式

kubectl logs -n kube-system kube-proxy-28xv4

#2、需要修改 kube-proxy 的配置文件,修改mode 为ipvs。默认iptables,但是集群大了以后就很慢

kubectl edit cm kube-proxy -n kube-system

修改如下

ipvs:

excludeCIDRs: null

minSyncPeriod: 0s

scheduler: ""

strictARP: false

syncPeriod: 30s

kind: KubeProxyConfiguration

metricsBindAddress: 127.0.0.1:10249

mode: "ipvs"

###修改了kube-proxy的配置,为了让重新生效,需要杀掉以前的Kube-proxy

kubectl get pod -A|grep kube-proxy

kubectl delete pod kube-proxy-pqgnt -n kube-system

### 修改完成后可以重启kube-proxy以生效

3、集群管理方式

3.1、分类方式

主从:

(1)主从同步/复制 (MYSQL 主 – MYSQL 从 => MYSQL就是典型的主从同步方式)

(2)主管理从 (K8S属于主管理从的方式)

分片 :也叫数据集群

(1)每个机器上都一样

(2)每个机器都之存储一部分东西,所有机器上的数据加起来是完整的

3.2、master-node 架构

master 和 worker怎么交互

master决定worker里面都有什么

worker只是和master (API) 通信; 每一个节点自己干自己的活

程序员使用UI或者CLI操作k8s集群的master,就可以知道整个集群的状况

4、K8S工作原理和组件介绍

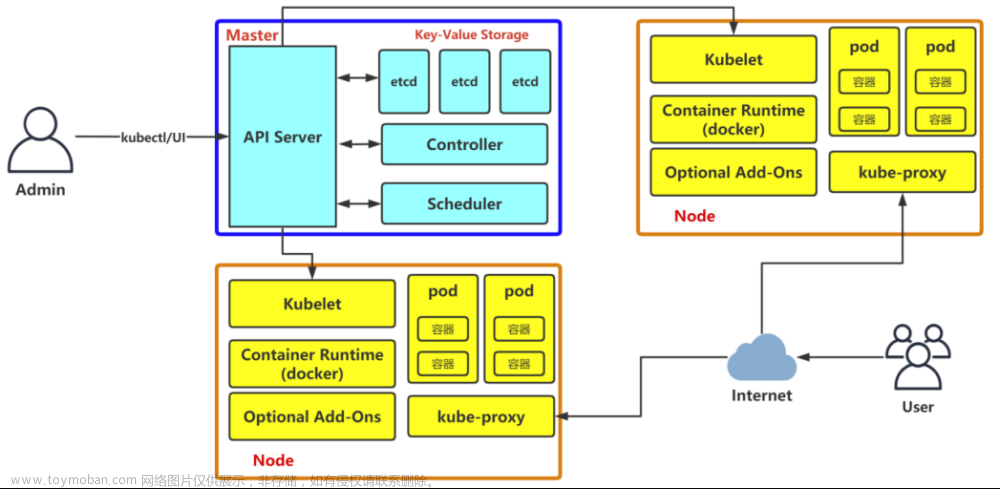

4.1、结构图

4.2、基本组件介绍

master节点(Control Plane【控制面板】):master节点控制整个集群

master节点上有一些核心组件:

- Controller Manager:控制管理器

- etcd:键值数据库(redis)【记账本,记事本】

- scheduler:调度器

- api server:api网关(所有的控制都需要通过api-server)

node节点(worker工作节点):

- kubelet(监工):每一个node节点上必须安装的组件。

- kube-proxy:代理, 代理网络

4.3、部署一个应用在K8S底层的全流程

开发人员:调用CLI或者使用K8S页面管理工具告诉master,我们现在要部署一个tomcat应用

- 程序员的所有调用都先去master节点的网关api-server,这是matser的唯一入口(类似于mvc模式中的c层)

- 收到的请求先交给master的api-server,由api-server交给controller-mannager进行控制

- controller-mannager 进行 应用部署

- controller-mannager 会生成一次部署信息。 tomcat --image:tomcat6 --port 8080, 但是真正不部署应用

- 部署信息被记录在etcd中

- scheduler调度器从etcd数据库中,拿到要部署的应用,开始调度,然后看哪个节点比较合适

- scheduler把算出来的调度信息再放到etcd中

- 每一个node节点的监控kubelet,随时和master保持联系的(给api-server发送请求不断获取最新数据),所有节点的kubelet就会从master

- 假设node2的kubelet最终收到了命令,要部署。

- kubelet就自己run一个应用在当前机器上,随时给master汇报当前应用的状态信息,分配ip

- node和master是通过master的api-server联系的

- 每一个机器上的kube-proxy能知道集群的所有网络,只要node访问别人或者别人访问node,node上的kube-proxy网络代理自动计算进行流量转发

下图和上图一样的,再理解一下

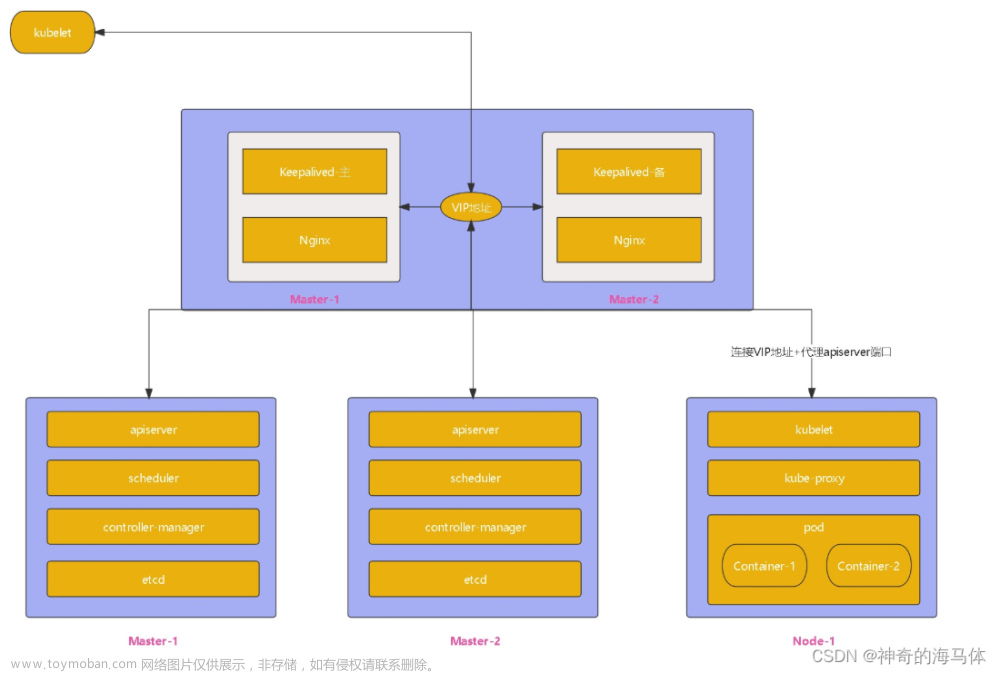

4.4、原理分解

4.4.1、主节点(master)

快速介绍:

- master也要装kubelet和kubeproxy

- 前端访问(UI\CLI):

- kube-apiserver:

- scheduler:

- controller manager:

- etcd

- kubelet+kubeproxy每一个节点的必备+docker(容器运行时环境)

4.4.2、工作节点(node)

快速介绍:文章来源:https://www.toymoban.com/news/detail-662777.html

- Pod:

- docker run 启动的是一个container(容器),容器是docker的基本单位,一个应用是一个容器

- kubelet run 启动的一个应用称为一个Pod;Pod是k8s的基本单位。

- Pod是容器的一个再封装

- 应用 => pod => docker的容器

- 一个容器往往代表不了一个基本应用。博客(php+mysql合起来完成)

- 准备一个Pod 可以包含多个 container;一个Pod代表一个基本的应用。

- IPod(看电影、听音乐、玩游戏)【一个基本产品,原子】

- Pod(music container、movie container)【一个基本产品,原子的】

- Kubelet:监工,负责交互master的api-server以及当前机器的应用启停等,在master机器就是master的小助手。每一台机器真正干活的都是这个 Kubelet

- Kube-proxy:

4.5、组件交互原理

部署流程再说明文章来源地址https://www.toymoban.com/news/detail-662777.html

想让k8s部署一个tomcat?

0、开机默认所有节点的kubelet、master节点的scheduler(调度器)、controller-manager(控制管理器)一直监听master的api-server发来的事件变化(for ::)

1、程序员使用命令行工具: kubectl ; kubectl create deploy tomcat --image=tomcat8(告诉master让集群使用tomcat8镜像,部署一个tomcat应用)

2、kubectl命令行内容发给api-server,api-server保存此次创建信息到etcd

3、etcd给api-server上报事件,说刚才有人给我里面保存一个信息。(部署Tomcat[deploy])

4、controller-manager监听到api-server的事件,是 (部署Tomcat[deploy])

5、controller-manager 处理这个 (部署Tomcat[deploy])的事件。controller-manager会生成Pod的部署信息【pod信息】

6、controller-manager 把Pod的信息交给api-server,再保存到etcd

7、etcd上报事件【pod信息】给api-server。

8、scheduler专门监听 【pod信息】 ,拿到 【pod信息】的内容,计算,看哪个节点合适部署这个Pod【pod调度过后的信息(node: node-02)】,

9、scheduler把 【pod调度过后的信息(node: node-02)】交给api-server保存给etcd

10、etcd上报事件【pod调度过后的信息(node: node-02)】,给api-server

11、其他节点的kubelet专门监听 【pod调度过后的信息(node: node-02)】 事件,集群所有节点kubelet从api-server就拿到了 【pod调度过后的信息(node: node-02)】 事件

12、每个节点的kubelet判断是否属于自己的事情;node-02的kubelet发现是他的事情

13、node-02的kubelet启动这个pod。汇报给master当前启动好的所有信息

到了这里,关于k8s简介、虚拟机快速搭建k8s集群、集群管理方式及K8S工作原理和组件介绍的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!