作者:禅与计算机程序设计艺术

-

利用Hadoop处理离线数据:Hive和Spark离线数据处理实现

-

引言

随着大数据时代的到来,越来越多的数据产生于各种业务系统。这些数据往往需要在离线环境中进行处理,以降低数据处理的时间和成本。Hadoop作为目前最为流行的分布式计算框架,提供了强大的离线数据处理能力。Hive和Spark作为Hadoop生态系统中的核心组件,分别提供了数据仓库和大数据处理引擎,可以协同完成数据的离线处理。本文将为大家介绍如何利用Hadoop的Hive和Spark实现离线数据处理,为数据科学家和程序员提供技术指导。文章来源:https://www.toymoban.com/news/detail-664898.html

- 技术原理及概念

2.1. 基本概念解释

Hadoop生态系统中的Hadoop、Hive、Spark和Hivejoin是核心组件。文章来源地址https://www.toymoban.com/news/detail-664898.html

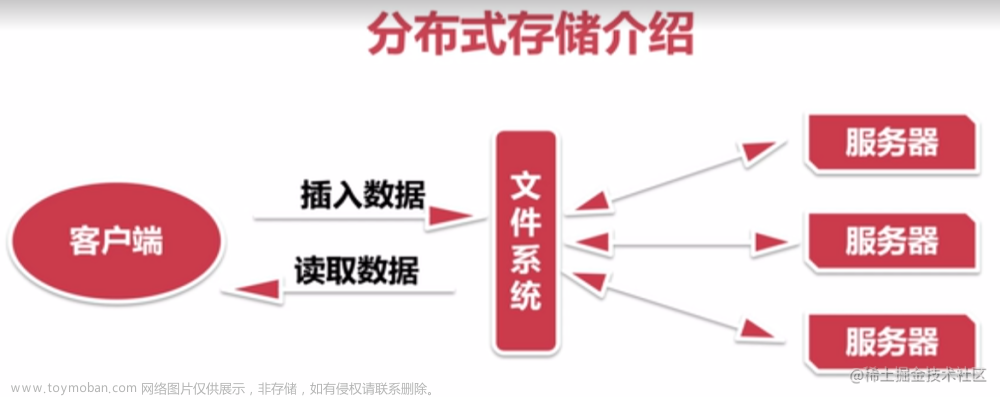

- Hadoop:是一个分布式计算框架,可以处理海量数据。

- Hive:是一个数据仓库工具,提供了一个通用的SQL查询语言HiveQL,可以轻松地完成数据仓库数据的离线处理。

- Spark:是一个大数据处理引擎,可以快速处理海量数据的离线分析。

- HiveJoin:是Hive的联合查询工具,可以实现多个表之间的数据联合查询。

2.2. 技术原理介绍:算法原理,具体操作步骤,数学公式,代码实例和解释说明

到了这里,关于利用Hadoop处理离线数据:Hive和Spark离线数据处理实现的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!