分类预测 | MATLAB实现SCNGO-CNN-LSTM-Attention数据分类预测

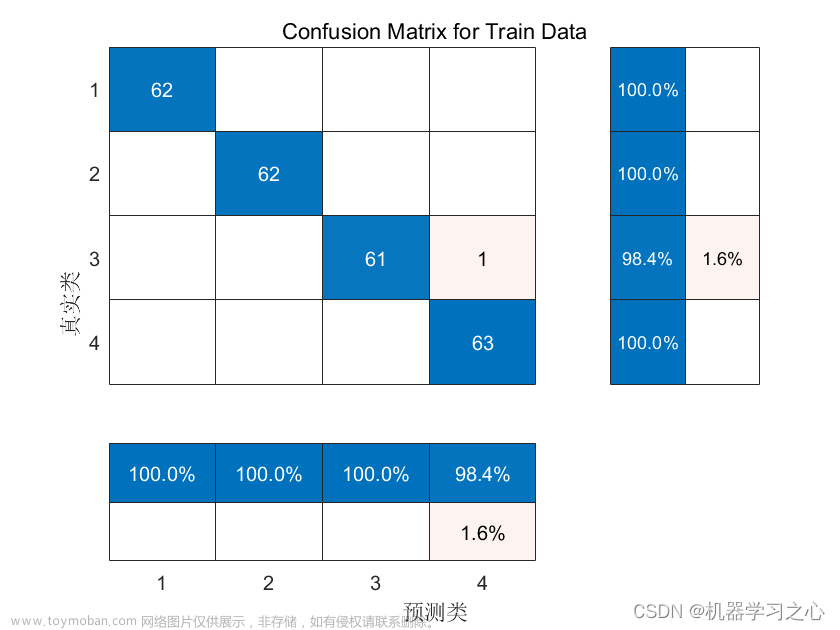

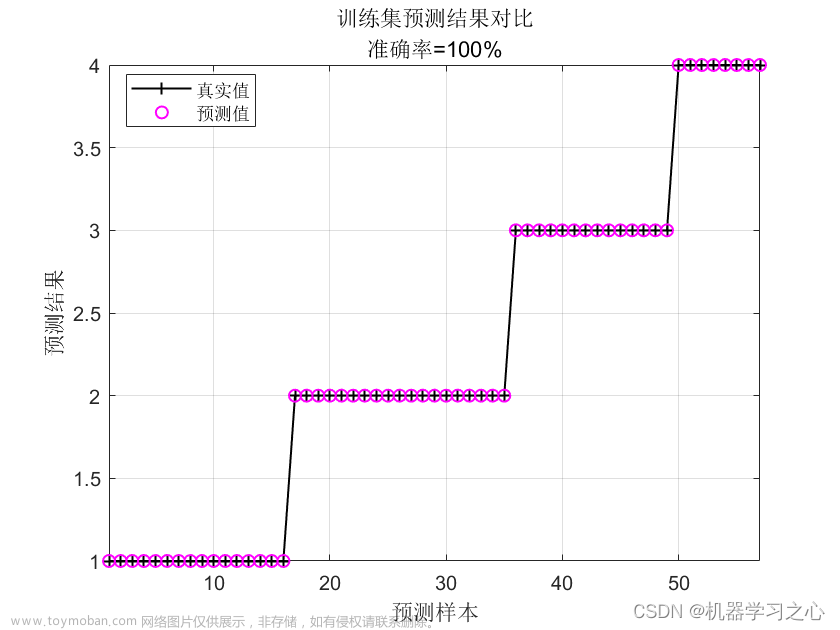

分类效果

基本描述

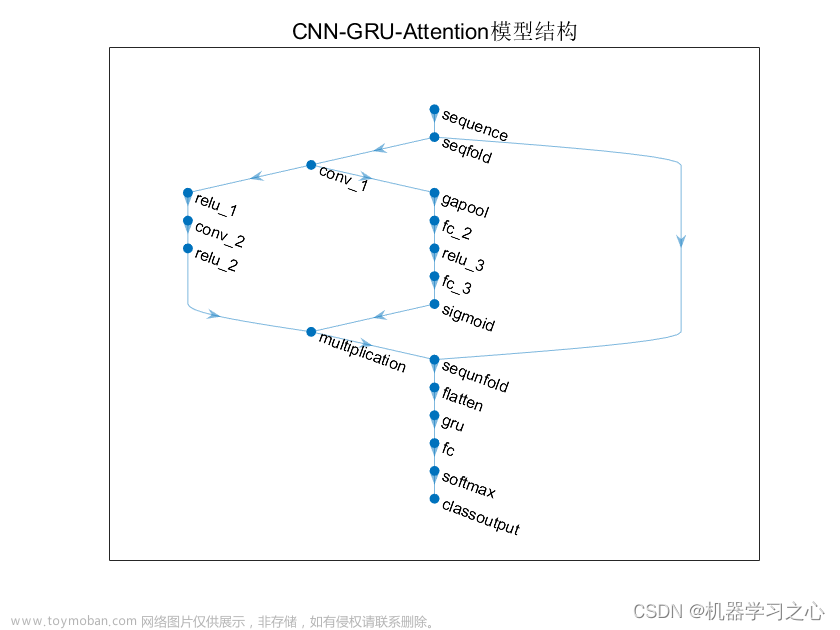

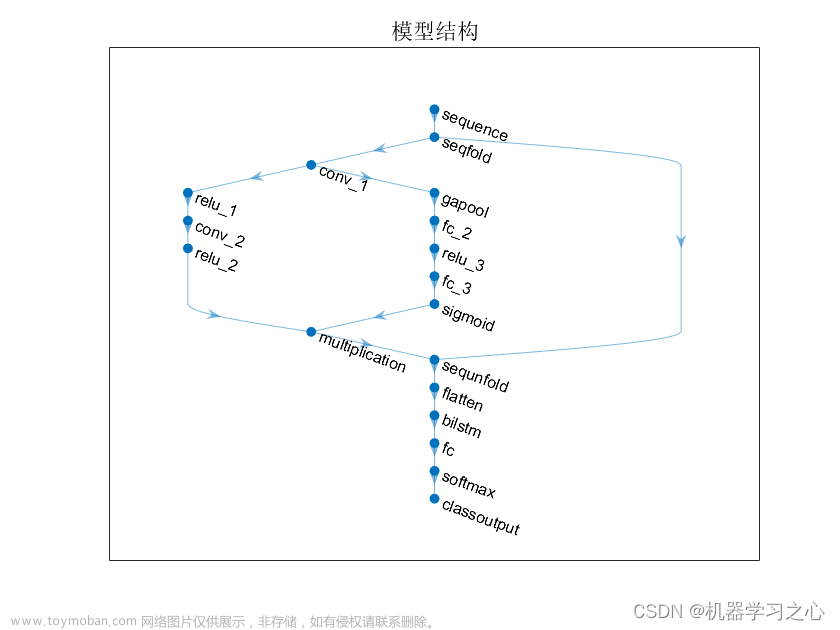

1.SCNGO-CNN-LSTM-Attention数据分类预测程序,改进算法,融合正余弦和折射反向学习的北方苍鹰优化算法;

2.程序平台:无Attention适用于MATLAB 2020版及以上版本;融合Attention要求Matlab2023版以上;

3.基于融合正余弦和折射反向学习的北方苍鹰优化算法(SCNGO)、卷积神经网络(CNN)和长短期记忆网络(LSTM)融合注意力机制的数据分类预测程序;

北方苍鹰优化算法(Northern Goshawk Optimization,NGO)由MOHAMMAD DEHGHANI等人于2022年提出,该算法,该算法模拟了北方苍鹰捕猎过程(猎物识别和攻击、追逐及逃生)。

改进策略参照麻雀优化算法,改进点如下:

①采用折射反向学习策略初始化北方苍鹰算法个体,基本思想是通过计算当前解的反向解来扩大搜索范围,借此找出给定问题更好的备选解;

②采用正余弦策略替换原始苍鹰算法的勘察阶段的位置更新公式;

③对正余弦策略的步长搜索因子进行改进;原始步长搜索因子呈线性递减趋势,不利于进一步平衡北方苍鹰算法的全局搜索和局部开发能力。

程序语言为matlab,程序可出分类效果图,迭代优化图,混淆矩阵图;精确度、召回率、精确率、F1分数等评价指标。

4.通过SCNGO优化算法优化学习率、卷积核大小、神经元个数,这3个关键参数,以测试集精度最高为目标函数

4.绘制:损失、精度迭代变化极坐标图;测试对比散点图、混淆矩阵图;适应度曲线;展示:精确度、召回率、精确率、F1分数等评价指标。

5.适用领域:

适用于各种数据分类场景,如滚动轴承故障、变压器油气故障、电力系统输电线路故障区域、绝缘子、配网、电能质量扰动,等领域的识别、诊断和分类。

使用便捷:

直接使用EXCEL表格导入数据,无需大幅修改程序。内部有详细注释,易于理解。文章来源:https://www.toymoban.com/news/detail-666012.html

程序设计

- 完整程序和数据获取方式:私信博主回复MATLAB实现SCNGO-CNN-LSTM-Attention数据分类预测;

% The Whale Optimization Algorithm

function [Best_Cost,Best_pos,curve]=WOA(pop,Max_iter,lb,ub,dim,fobj)

% initialize position vector and score for the leader

Best_pos=zeros(1,dim);

Best_Cost=inf; %change this to -inf for maximization problems

%Initialize the positions of search agents

Positions=initialization(pop,dim,ub,lb);

curve=zeros(1,Max_iter);

t=0;% Loop counter

% Main loop

while t<Max_iter

for i=1:size(Positions,1)

% Return back the search agents that go beyond the boundaries of the search space

Flag4ub=Positions(i,:)>ub;

Flag4lb=Positions(i,:)<lb;

Positions(i,:)=(Positions(i,:).*(~(Flag4ub+Flag4lb)))+ub.*Flag4ub+lb.*Flag4lb;

% Calculate objective function for each search agent

fitness=fobj(Positions(i,:));

% Update the leader

if fitness<Best_Cost % Change this to > for maximization problem

Best_Cost=fitness; % Update alpha

Best_pos=Positions(i,:);

end

end

a=2-t*((2)/Max_iter); % a decreases linearly fron 2 to 0 in Eq. (2.3)

% a2 linearly dicreases from -1 to -2 to calculate t in Eq. (3.12)

a2=-1+t*((-1)/Max_iter);

% Update the Position of search agents

for i=1:size(Positions,1)

r1=rand(); % r1 is a random number in [0,1]

r2=rand(); % r2 is a random number in [0,1]

A=2*a*r1-a; % Eq. (2.3) in the paper

C=2*r2; % Eq. (2.4) in the paper

b=1; % parameters in Eq. (2.5)

l=(a2-1)*rand+1; % parameters in Eq. (2.5)

p = rand(); % p in Eq. (2.6)

for j=1:size(Positions,2)

if p<0.5

if abs(A)>=1

rand_leader_index = floor(pop*rand()+1);

X_rand = Positions(rand_leader_index, :);

D_X_rand=abs(C*X_rand(j)-Positions(i,j)); % Eq. (2.7)

Positions(i,j)=X_rand(j)-A*D_X_rand; % Eq. (2.8)

elseif abs(A)<1

D_Leader=abs(C*Best_pos(j)-Positions(i,j)); % Eq. (2.1)

Positions(i,j)=Best_pos(j)-A*D_Leader; % Eq. (2.2)

end

elseif p>=0.5

distance2Leader=abs(Best_pos(j)-Positions(i,j));

% Eq. (2.5)

Positions(i,j)=distance2Leader*exp(b.*l).*cos(l.*2*pi)+Best_pos(j);

end

end

end

t=t+1;

curve(t)=Best_Cost;

[t Best_Cost]

end

参考资料

[1] https://blog.csdn.net/kjm13182345320/article/details/129036772?spm=1001.2014.3001.5502

[2] https://blog.csdn.net/kjm13182345320/article/details/128690229文章来源地址https://www.toymoban.com/news/detail-666012.html

到了这里,关于分类预测 | MATLAB实现SCNGO-CNN-LSTM-Attention数据分类预测的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!