本文是LLM系列文章,关于模型压缩相关综述,针对《A Survey on Model Compression for Large Language Models》的翻译。

摘要

大型语言模型(LLM)以显著的成功彻底改变了自然语言处理任务。然而,它们强大的规模和计算需求给实际部署带来了重大挑战,尤其是在资源受限的环境中。随着这些挑战变得越来越重要,模型压缩领域已成为缓解这些限制的关键研究领域。本文对专门为LLM量身定制的模型压缩技术进行了全面的调查。为了满足高效部署的迫切需要,我们深入研究了各种方法,包括量化、修剪、知识蒸馏等。在每一种技术中,我们都强调了有助于LLM研究不断发展的最新进展和创新方法。此外,我们探索了对评估压缩LLM的有效性至关重要的基准测试策略和评估指标。通过深入了解最新发展和实际意义,这项调查为研究人员和从业者提供了宝贵的资源。随着LLM的不断发展,这项调查旨在促进提高效率和现实世界的适用性,为该领域的未来进步奠定基础。

1 引言

2 方法

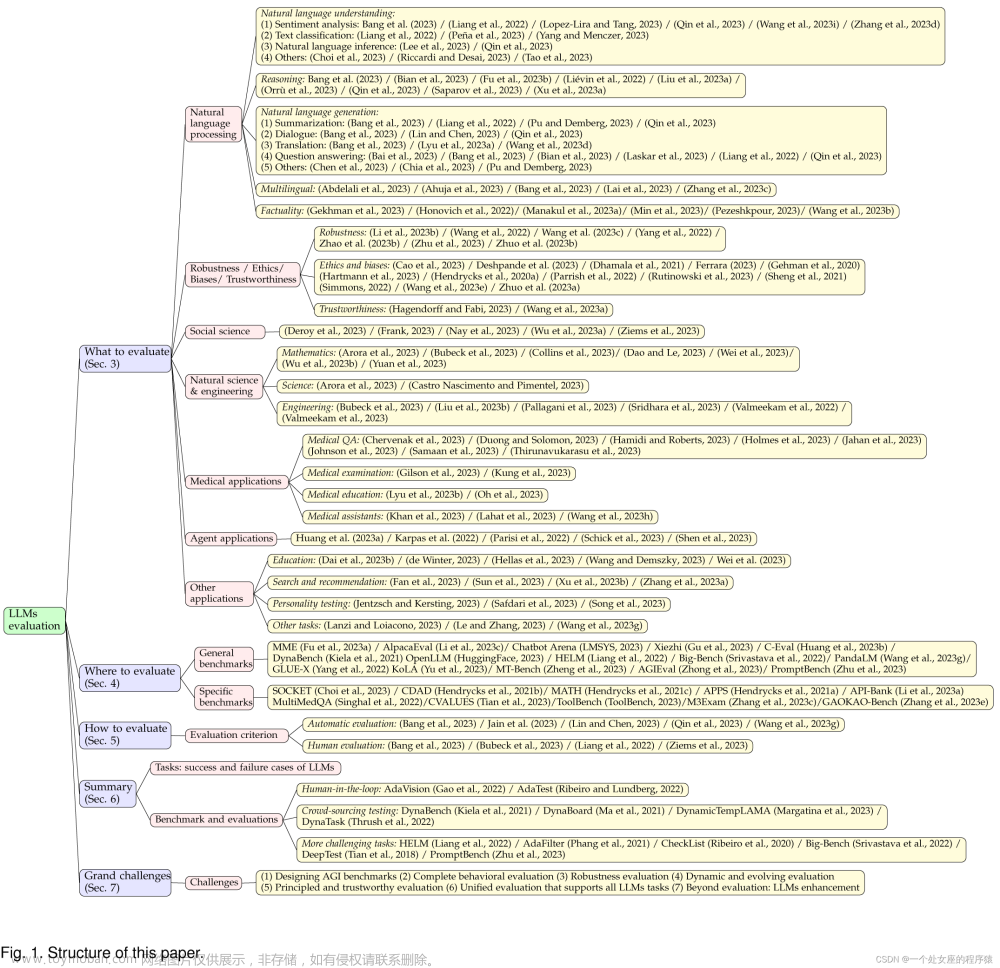

3 度量和基准

3.1 度量

3.2 基准

4 挑战和未来方向

专业基准

尽管早期引入了用于评估模型压缩的基准测试,但这些基准测试仍然存在一些缺点。首先,模型压缩的评估缺乏一个普遍接受的标准设置。不同的研究通常产生具有不同加速比、参数计数和精度水平的模型。因此,这些研究之间的直接比较可能具有挑战性,并因硬件差异而变得更加复杂。其次,常见的基准,如LAMA和StrategyQA,可能不是移动设备上典型任务的最合适表示。第三,为预训练模型设计的基准也可能不是最适合LLM的。一般来说,为LLM设计专门的基准非常重要。

性能大小权衡

先前的研究强调了大型语言模型(LLM)性能和模型大小之间的微妙平衡。分析这种权衡可以在硬件约束下实现最佳性能。然而,目前的工作缺乏对这种权衡的理论和实证见解。未来LLM压缩研究应进行全面分析,以指导先进技术。了解性能和尺寸之间的关系,使研究人员能够开发量身定制的压缩方法,有效地在设计空间中找到高效的解决方案。

动态LLM压缩

尽管目前的压缩方法有所进步,但它们仍然依赖于手动设计来确定LLM的压缩尺寸和结构。这通常涉及基于输入数据或任务要求的试验和错误方法。在知识蒸馏等场景中,这一过程变得特别具有挑战性,在这些场景中,需要进行几次试验才能在计算约束下找到合适的学生模型。这种手工操作造成了实际障碍。一个有前景的解决方案出现在神经结构搜索(NAS)技术的集成中进入LLM压缩领域。NAS有可能减少对人工设计体系结构的依赖,从而有可能彻底改变LLM压缩,从而提高效率和有效性。

解释能力

早期的研究对应用于预训练语言模型(PLM)的压缩技术的可解释性提出了重大担忧。值得注意的是,这些相同的挑战也扩展到LLM压缩方法。因此,可解释压缩方法的集成成为LLM压缩应用发展的关键必要条件。此外,可解释压缩的采用不仅解决了可解释性问题,而且简化了压缩模型的评估过程。这反过来又增强了模型在整个生产阶段的可靠性和可预测性。文章来源:https://www.toymoban.com/news/detail-666188.html

5 结论

在这项全面的综述中,我们探讨了大型语言模型(LLM)的模型压缩技术。我们的覆盖范围涵盖了压缩方法、评估指标和基准数据集。通过深入LLM压缩,我们强调了其挑战和机遇。随着LLM压缩的发展,人们明确呼吁研究专门针对LLM的高级方法,释放其在应用程序中的潜力。这项调查旨在成为一个有价值的参考,提供对当前形势的见解,并促进对这一关键主题的持续探索。文章来源地址https://www.toymoban.com/news/detail-666188.html

到了这里,关于A Survey on Model Compression for Large Language Models的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!