torch.nn.SiLU

原型

CLASS torch.nn.SiLU(inplace=False)

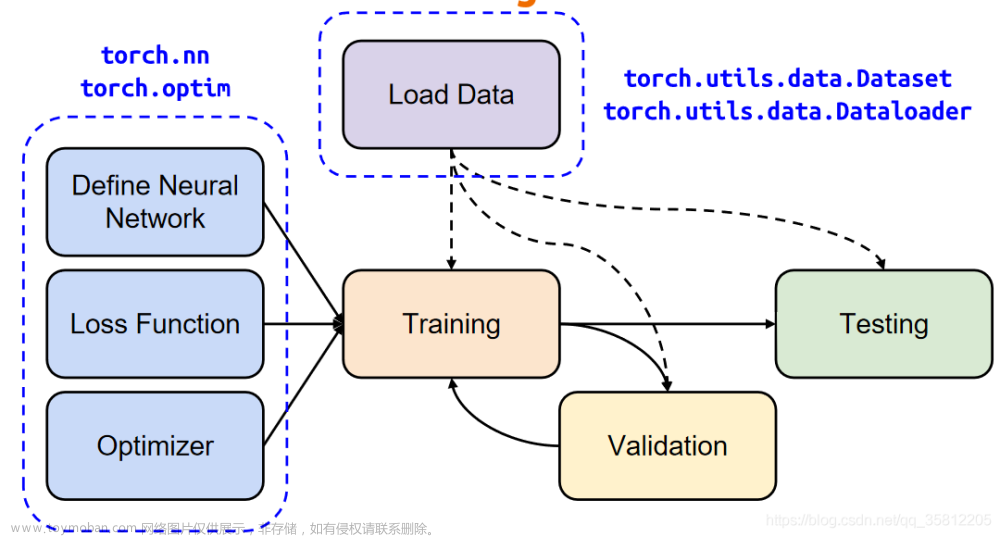

torch.nn.SiLU 是 PyTorch 深度学习框架中的一个激活函数,它代表 Sigmoid-Weighted Linear Unit(SiLU),也称为 Swish 激活函数。SiLU 激活函数在深度学习中被广泛使用,因为它在计算复杂度相对较低的情况下,在某些任务上比常用的激活函数(如 ReLU)具有更好的性能。与 ReLU 相比,SiLU 函数在处理负数输入时引入了一些平滑性,可能有助于缓解梯度消失问题。

图

代码

import torch

import torch.nn as nn

m = nn.SiLU()

input = torch.randn(4)

output = m(input)

print("input: ", input) # input: tensor([ 0.3852, -0.5519, 0.8902, 2.1292])

print("output: ", output) # output: tensor([ 0.2292, -0.2017, 0.6311, 1.9029])

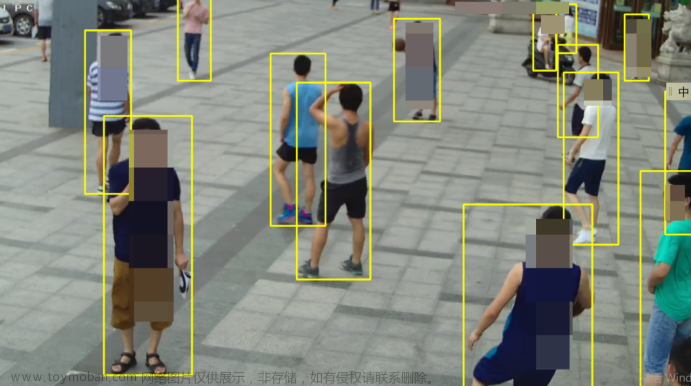

Lnton羚通是专注于音视频算法、算力、云平台的高科技人工智能企业。 公司基于视频分析技术、视频智能传输技术、远程监测技术以及智能语音融合技术等, 拥有多款可支持ONVIF、RTSP、GB/T28181等多协议、多路数的音视频智能分析服务器/云平台。

文章来源:https://www.toymoban.com/news/detail-666778.html

文章来源:https://www.toymoban.com/news/detail-666778.html

文章来源地址https://www.toymoban.com/news/detail-666778.html

到了这里,关于Lnton羚通云算力平台【PyTorch】教程:torch.nn.SiLU的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!