[kafka消息生产被阻塞] - 如何解决Kafka生产者阻塞的问题

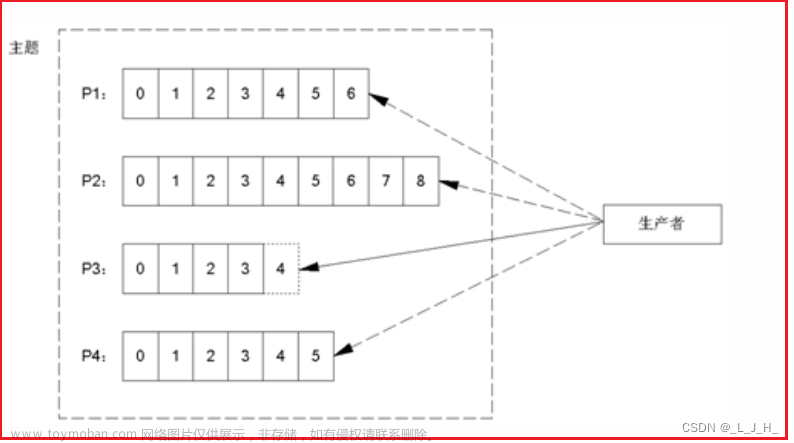

Kafka是一个高度可扩展的分布式流平台,用于构建实时数据管道和流处理应用程序。作为一个广泛使用的消息代理系统,Kafka在数据传输方面表现出色,但是在极端情况下,它可能会出现生产者阻塞的问题。这可能会导致生产者无法将消息及时写入Kafka分区,从而影响整个数据流。

那么,当你遇到Kafka生产者阻塞的情况,应该如何解决呢?以下是一些可能造成Kafka生产者阻塞的原因以及解决方法。

1. 确认生产者配置

首先,你需要确认生产者的配置是否正确。如果消息体过大或其他配置项错误,都有可能阻塞生产者。例如,如果消息体大小超出了broker的最大限制,Kafka会立即关闭连接,这将导致生产者阻塞。

# setting the maximum message size (default is 1MB)

max.request.size=1048576

确保配置中的所有值都已正确设置,并且没有任何歧义。

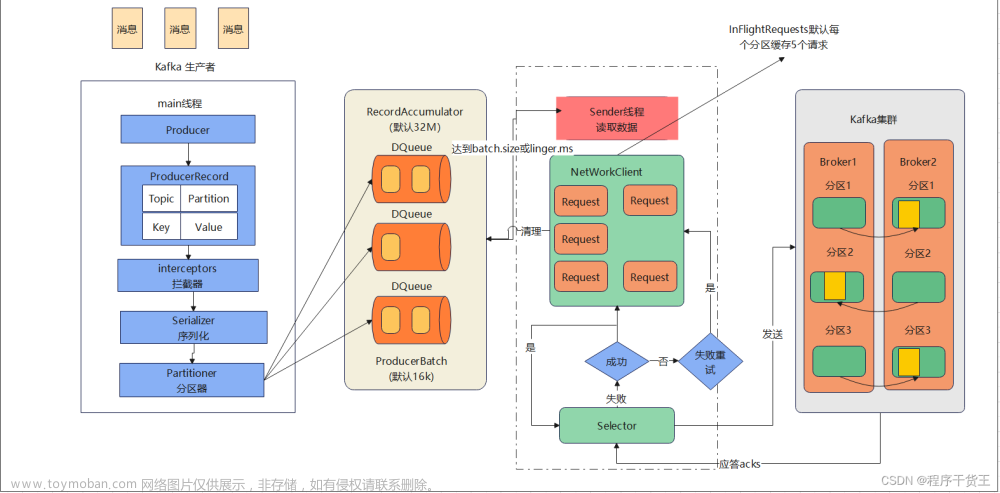

2. 调整批量大小

默认情况下,Kafka生产者会将消息批量发送到Kafka broker以提高传输效率。但是,如果批量大小设置得太大,会导致生产者阻塞。文章来源:https://www.toymoban.com/news/detail-669896.html

# batch size in bytes (default is 16K)

batch.size=16384

# number of messages that trigger a send (default is 100)

linger.ms=5

你可文章来源地址https://www.toymoban.com/news/detail-669896.html

到了这里,关于[kafka消息生产被阻塞] - 如何解决Kafka生产者阻塞的问题的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!