chatglm2-6B 是清华大学开源的一款支持中英双语的对话语言模型。经过了 1.4T 中英标识符的预训练与人类偏好对齐训练,具有62 亿参数的 ChatGLM2-6B 已经能生成相当符合人类偏好的回答。结合模型量化技术,用户可以在消费级的显卡上进行本地部署(INT4 量化级别下最低只需 6GB 显存)。

在个人PC上安装 chatglm2-6B后的测试情况给大家介绍一下。分别从用户身份、编程计算能力、和推理能力等几个方面进行测试。和chatgpt3.5做一个对比,在中文方面咯有优势,在推理能力上稍弱一些。

比如以不同的角色来写一首诗

如果你是一个大学生,写一首春天的诗

ChatGLM:

春意盎然,世界新生,

嫩绿的嫩芽,悄悄地生长。

缤纷的花朵,绽放的盛况,

春雨的滋润,细心的呵护。

远处的山林,柔和的微风,

拂过脸庞的温暖,

似乎在呢喃,也在呢喃。

春天的大学,充满了生机,

知识的海洋,探索的乐园,

每一个角落,都充满了光芒,

每一个灵魂,都充满了希望。

青春在这里,绽放在这里,

愿我们都能,在这里收获果实。

春天的大学,春天的青春,

愿我们都能,在这里放飞自己的梦想。

如果你是一个小学生,写一首春天的诗

ChatGLM:

万物生长,鸟儿歌唱,

春风拂面,花儿绽放。

太阳升起,光芒四溢,

微风拂过,心情欢畅。

大自然恩赐一切,

让我们享受,欣欣向荣。

春天是个宝藏,

蕴藏无限奥秘。

让我们一起,共同探索,

感受春天的美好!

翻译:

Spring has come, and all things are awakening,

Misty rain, nourishing the earth.

All things grow, birds sing,

Spring breeze, flowers bloom.

The sun rises, and the light shines bright,

微风吹过, and one is happy and bright.

Nature has given us everything we need,

Let us enjoy, and flourish together.

Spring is a treasure trove,

A secret world of endless wonders.

Let’s explore together, and see,

How nature’s beauty blooms this year.

计算和编程能力测试

5*4/10 等于多少

ChatGLM:5*4/10 = 20/10 = 2

用户:用python 写一段程序, 计算 5*4/10 等于多少

ChatGLM:以下是一段 Python 程序,可以计算并输出 5*4/10 的结果:

# 计算并输出 5*4/10 的结果

result = 5 * 4 / 10

print(result)

输出结果为:

2

中文推理能力测试

猴子数量计算测试

用户:树上有7只猴子, 地上有1只猴子 , 一共几只猴子?

ChatGLM:树上有7只猴子,地上有1只猴子,一共是8只猴子。

用户:地上1只猴子被赶走了,还剩下几只猴子?文章来源:https://www.toymoban.com/news/detail-676233.html

ChatGLM:如果地上最后一只猴子被赶走了,那么还剩下6只猴子。文章来源地址https://www.toymoban.com/news/detail-676233.html

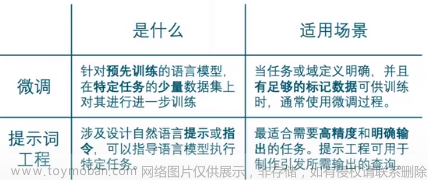

到了这里,关于三个开源大模型(chatglm2-6B, moss, llama)-chatglm2的测试的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!