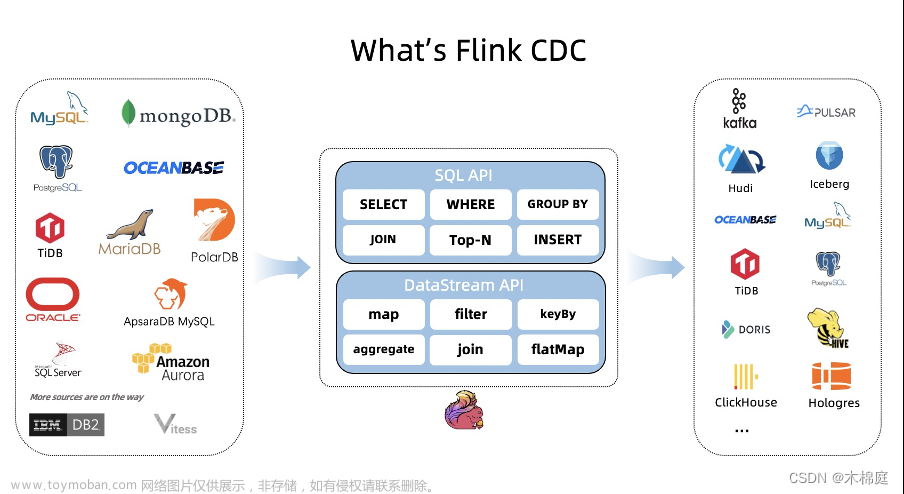

flinkcdc同步完全量数据就不同步增量数据了

使用flinkcdc同步mysql数据,使用的是全量采集模型

startupOptions(StartupOptions.earliest())

全量阶段同步完成之后,发现并不开始同步增量数据,原因有以下两个:

原因1:

1.mysql中对应的数据库没有开启binlog

在/etc/my.cnf配置文件中,在[ mysqld ]添加以下内容

[mysqld]

#数据库id

server-id=1

##启动Binlog,该参数的值会作为binlog的文件名前缀

log-bin=mysql-bin

##binlog类型,maxwell要求为row类型

binlog_format=row

##启动binlog的数据库,需根据实际情况修改配置

binlog-do-db=student

binlog-do-db=easypm

然后重启数据库 ,执行命令

sudo systemctl restart mysqld

原因2

和checkpoint有关

1.没有开启ck

2.ck的时间过长

测试阶段,可以把ck的时间设置的非常短文章来源:https://www.toymoban.com/news/detail-681780.html

env.enableCheckpointing(1000L, CheckpointingMode.EXACTLY_ONCE);//头和头的之间

env.getCheckpointConfig().setMinPauseBetweenCheckpoints(1000L);//头和尾

3.ck的路径收到损坏,删除对应的ck路径下的内容即可文章来源地址https://www.toymoban.com/news/detail-681780.html

到了这里,关于flinkcdc同步完全量数据就不同步增量数据了的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!