Topic

Abstract

我们使用扩散概率模型给出了高质量的图像合成结果,扩散概率模型是一类受非平衡热力学启发的潜变量模型。我们的最佳结果是根据扩散概率模型和去噪分数匹配与朗之万动力学之间的新联系而设计的加权变分界上的训练,并且我们的模型自然地允许渐进有损解压缩方案,可以被解释为自回归译码的推广。在无条件的CIFAR10数据集上,我们获得了9.46的初始得分和3.17的最新FID得分。在256x256 LSUN上,我们获得了与ProgressiveGAN类似的样品质量。

Introduction

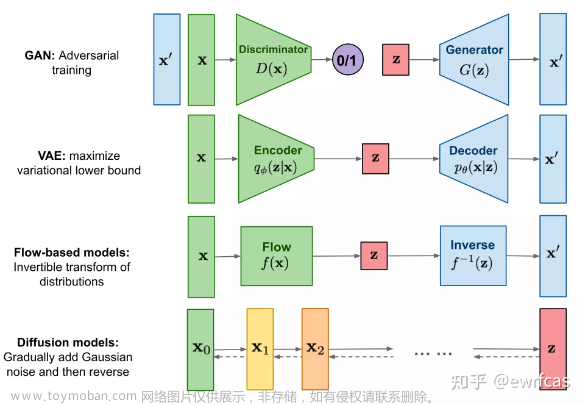

所有类型的深度生成模型最近在各种数据形式中展示了高质量的样本。生成性对抗网络(GANS)、自回归模型、流和变分自动编码器(VAEs)已经合成了引人注目的图像和音频样本,并且在基于能量的建模和分数匹配方面取得了显著的进步,产生了与GANS相当的图像。

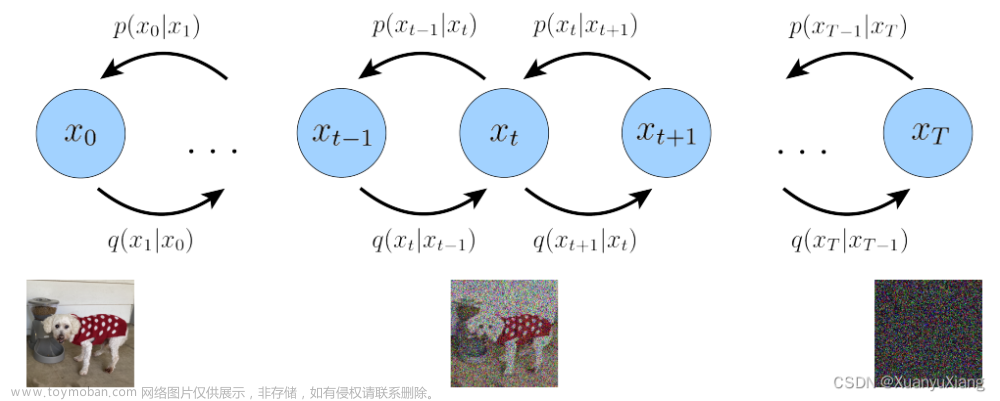

本文介绍了扩散概率模型的进展。扩散概率模型(简称扩散模型)是使用变分推理训练的参数马尔可夫链,以在有限时间后产生与数据匹配的样本。这个链的转变被学习来逆转扩散过程,该扩散过程是在采样的相反方向上逐渐向数据添加噪声直到信号被破坏的马尔可夫链。当扩散由少量的高斯噪声组成时,将采样链转换也设置为条件高斯就足够了,从而允许特别简单的神经网络参数化。

扩散模型定义简单,训练效率高,但就我们所知,还没有证据表明它们能够产生高质量的样本。我们表明扩散模型实际上能够产生高质量的样本,有时比在其他类型的生成模型上发表的结果更好。此外,我们还证明了扩散模型的某种参数化与训练过程中多个噪声水平上的去噪分数匹配和采样过程中的退火朗之万动力学等价。我们使用这个参数获得了最好的样本质量结果,所以我们认为这个等价性是我们的主要贡献之一。

尽管我们的模型具有样本质量,但与其他基于可能性的模型相比,我们的模型并不具有竞争性的对数似然比(然而,我们的模型的对数似然比已报道的退火重要性抽样为基于能量的模型和分数匹配产生的大估计更好[11,55])。我们发现,我们的模型的大多数无损代码长度被用于描述不可感知的图像细节(第4.3节)。我们在有损压缩的语言中提供了对这种现象的更精细的分析,并且我们表明扩散模型的采样过程是一种类似于沿着比特排序的自回归解码的渐进解码,这极大地概括了自回归模型通常可能的情况。

Related Work

Method

扩散模型可能看起来是一类有限的潜变量模型,但它们在实施中允许大量的自由度。必须选择正向过程的方差βt和反向过程的模型结构和高斯分布参数。为了指导我们的选择,我们在扩散模型和去噪得分匹配之间建立了一个新的显式联系,这导致了扩散模型的一个简化的加权变分界目标。最终,我们的模型设计被简单性和实证结果证明是正确的。我们的讨论是按等式的术语来分类的。

- Forward process

- Reverse process

- Data scaling, reverse process decoder

- Simplified training objective

Experiments

文章来源:https://www.toymoban.com/news/detail-686440.html

文章来源:https://www.toymoban.com/news/detail-686440.html

Conclusion and Discussion

我们已经使用扩散模型提供了高质量的图像样本,并且我们发现了用于训练马尔可夫链、去噪分数匹配和退火朗之万动力学(以及扩展的基于能量的模型)、自回归模型和渐进有损压缩的扩散模型和变分推理之间的联系。由于扩散模型似乎对图像数据具有很好的归纳偏差,我们期待着研究它们在其他数据形式中的用途,以及作为其他类型的生成模型和机器学习系统的组成部分。文章来源地址https://www.toymoban.com/news/detail-686440.html

到了这里,关于【扩散模型】【AIGC】DDPM Note的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!