Apache Spark SQL 提供了一组强大的 API 用于结构化数据的处理和分析。比如 DataFrame API

DataFrame API:DataFrame 是 Spark SQL 中的核心数据结构,它是一个分布式的带有命名列的数据集,类似于传统数据库表或 Pandas 数据帧。DataFrame API 提供了多种操作和转换方法,包括选择、过滤、分组、聚合、连接等,用于处理和分析数据。文章来源:https://www.toymoban.com/news/detail-694466.html

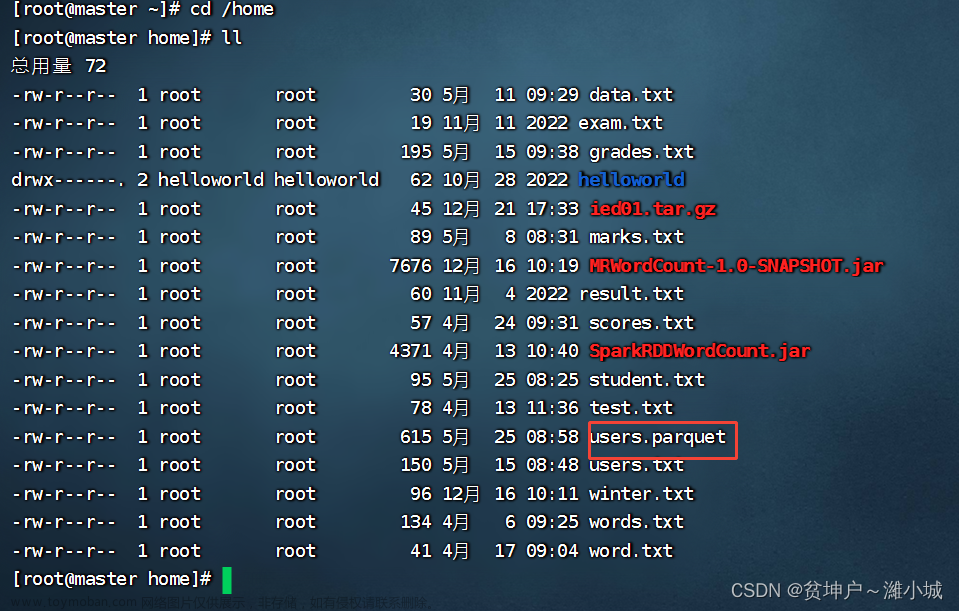

示例:文章来源地址https://www.toymoban.com/news/detail-694466.html

// 选择列

df.select("name", "age")

// 过滤数据

df.filter(df("age") >= 18到了这里,关于13 | Spark SQL 的 DataFrame API的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!