- 全局可解释性方法

- 局部可解释性方法:

- Shap Value

- Permutation

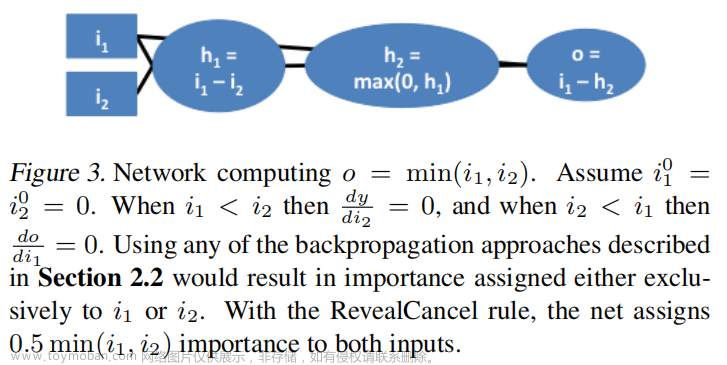

- 积分梯度法:

- 避免了直接以梯度作为特征重要性所带来的梯度饱和问题

- Algorithm Descriptions · Captum

文章来源地址https://www.toymoban.com/news/detail-696843.html

文章来源:https://www.toymoban.com/news/detail-696843.html

到了这里,关于神经网络的可解释性方法的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!