机器学习 | Python实现XGBoost极限梯度提升树模型答疑

问题系列

关于XGBoost有几个问题想请教一下。1.XGBoost的API有哪些种调用方法?2.参数如何调?文章来源:https://www.toymoban.com/news/detail-699097.html

问题回答

- XGBoost的API有2种调用方法,一种是我们常见的原生API,一种是兼容Scikit-learn API的API,Scikit-learn API与Sklearn生态系统无缝集成。

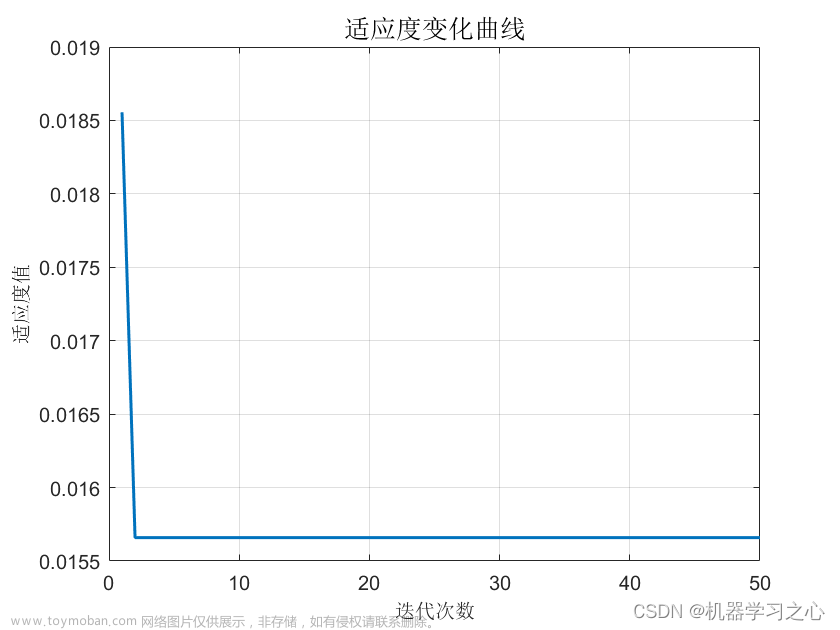

- 对于XGBoost来说,默认的超参数是可以正常运行的,但是如果你想获得最佳的效果,那么就需要自行调整一些超参数来匹配你的数据,以下参数对于XGBoost非常重要:

eta

num_boost_round

max_depth

subsample

colsample_bytree

gamma

min_child_weight

l文章来源地址https://www.toymoban.com/news/detail-699097.html

到了这里,关于机器学习 | Python实现XGBoost极限梯度提升树模型答疑的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!