论文简介

-

作者

Huiqiang Xie

Zhijin Qin

Geoffrey Ye Li

Biing-Hwang Juang -

发表期刊or会议

《IEEE TRANSACTIONS ON SIGNAL PROCESSING》 -

发表时间

2021.4 -

这篇论文由《Deep Learning based Semantic Communications: An Initial Investigation》扩展而来

关于文章内容的总结

| 框架或结构 | 作用 |

|---|---|

| DeepSC | 最大化系统容量、最小化语义误差 |

| 设计两个Loss函数 | 理解语义信息、最大化系统容量 |

| 语义-信道联合编码 | 保持 s s s和 s ^ \hat s s^之间的含义不变← L C E \mathcal{L}_{\mathrm{CE}} LCE用于衡量 s s s和 s ^ \hat s s^之间的差异 |

| 语义-信道联合编码 | 使网络学习特定目标的知识(联合设计时,信道编码可以注重保护与传输和目标相关的语义信息,而忽略其他不相关的信息) |

| L C E \mathcal{L}_{\mathrm{CE}} LCE | 通过训练整个系统来最小化 s s s和 s ^ \hat s s^之间的差异 |

| L MI \mathcal{L}_{\text {MI }} LMI | 最大化发射机训练期间实现的数据速率 |

引申出不理解的问题

-

语义-信道联合编码在上图流程中属于哪部分?

个人理解:整个流程都是 -

联合设计收发器在上图流程中属于哪部分?

未解决文章来源:https://www.toymoban.com/news/detail-700946.html -

以下概念分不清楚

文章来源地址https://www.toymoban.com/news/detail-700946.html

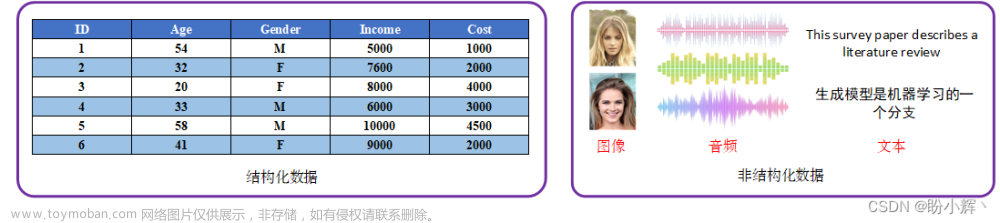

文章来源地址https://www.toymoban.com/news/detail-700946.html- E2E通信系统是一种

形式

自编码器是一种结构

通信系统物理层收发机与自编码器在功能和结构上是相似的。自编码器的主要功能是实现数据重构,而通信系统的主要功能是在接收端恢复发射端的信号。

若把收发信机看成一种自编码器结构,则发射机与接收机分别对应于自编码器的编码器与译码器。因此,通信系统收发信机的最优化设计就转变为自编码器端到端的优化任务。

- E2E通信系统是一种

到了这里,关于语义通信经典文章DeepSC:Deep Learning Enabled Semantic Communication Systems的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!