本文是LLM系列文章,针对《GREASELM: GRAPH REASONING ENHANCED

LANGUAGE MODELS FOR QUESTION ANSWERING》的翻译。

摘要

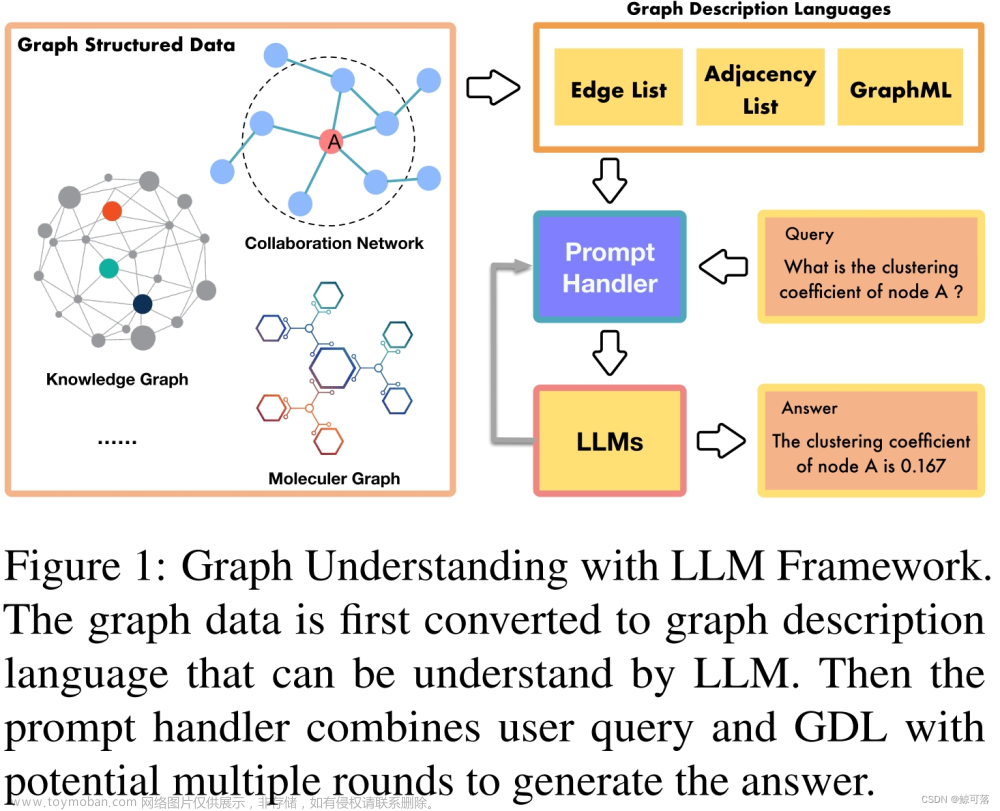

回答关于文本叙事的复杂问题需要对所陈述的上下文和作为其基础的世界知识进行推理。然而,作为大多数现代QA系统的基础的预训练语言模型(LM)并不能有力地表示概念之间的潜在关系,而这是推理所必需的。虽然知识图谱(KG)经常被用来用世界知识的结构化表示来扩充LMs,但如何有效地融合和推理KG表示和语言上下文仍然是一个悬而未决的问题,因为语言上下文提供了情境约束和细微差别。在这项工作中,我们提出了GREASELM,这是一种新的模型,它在多层模态交互操作上融合了来自预训练的LM和图神经网络的编码表示。来自两种模式的信息传播到另一种模式,允许语言上下文表示以结构化的世界知识为基础,并允许上下文中的语言细微差别(例如否定、对冲)告知知识的图形表示。我们在常识推理(即CommonsenseQA、OpenbookQA)和医学问答(即MedQA USMLE)领域的三个基准测试上的结果表明,GREASELM可以更可靠地回答需要对情境约束和结构化知识进行推理的问题,甚至优于8倍。文章来源:https://www.toymoban.com/news/detail-701866.html

1 引言

2 相关工作

3 提出的方法:GREASELM

4 实验设置

5 实验结果

6 结论

在本文中,我们介绍了GREASELM,这是一种新的模型,通过语言模型和知识图谱中的知识之间的联合信息交换,实现交互式融合。实验结果表明,在来自多个领域(常识和医学)的标准数据集上,与先前的KG+LM和仅LM基线相比,性能优越。我们的分析表明,改进了能力建模问题,表现出文本的细微差别,如否定和对冲。文章来源地址https://www.toymoban.com/news/detail-701866.html

到了这里,关于GREASELM: GRAPH REASONING ENHANCED LANGUAGE MODELS FOR QUESTION ANSWERING的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!