一、“现代” vs “传统”

现代卷积神经网络(CNNs)与传统卷积神经网络之间存在一些关键区别。这些区别主要涉及网络的深度、结构、训练技巧和应用领域等方面。以下是现代CNNs与传统CNNs之间的一些区别:

-

深度:

- 传统CNNs:传统的CNNs相对较浅,通常由几层卷积层和全连接层组成。它们的深度有限,不足以处理复杂的任务。

- 现代CNNs:现代CNNs更深,包括数十到数百个卷积层和更多的参数。这使得它们能够从数据中学习更丰富、更高级别的特征表示。

-

网络结构:

- 传统CNNs:传统CNNs使用相对简单的卷积层和池化层,层之间的连接结构相对简单。

- 现代CNNs:现代CNNs引入了更复杂的模块和结构,如残差块(Residual Blocks)、Inception模块、自注意力机制等,允许网络更好地捕获多尺度特征和建模更复杂的关系。

-

训练技巧:

- 传统CNNs:传统CNNs通常使用标准的梯度下降训练,缺乏一些现代训练技巧,如批标准化、权重初始化策略、学习率调整等。

- 现代CNNs:现代CNNs利用更复杂的训练技巧,包括残差连接、批标准化、权重初始化策略、学习率调度、数据增强等,以加速训练和提高性能。

-

应用领域:

- 传统CNNs:传统CNNs主要用于基本的计算机视觉任务,如图像分类、目标检测和分割。它们不太适合处理大规模和复杂的数据。

- 现代CNNs:现代CNNs被广泛用于各种领域,包括自然语言处理、强化学习、生成对抗网络(GANs)、自动驾驶、医学图像处理等,它们能够处理更广泛的数据类型和任务。

-

模型大小:

- 传统CNNs:传统CNNs通常具有相对较少的参数和较小的模型大小。

- 现代CNNs:现代CNNs可能包含数百万或数亿个参数,使得它们更适合大规模的数据和任务。

总之,现代CNNs相对于传统CNNs在深度、结构、训练技巧和应用领域等方面有显著的改进和区别。这些改进使得现代CNNs能够处理更复杂的任务,并在计算机视觉以外的领域取得显著的成功。这也反映了深度学习领域不断演进和发展的趋势。

二、知名的CNN架构

卷积神经网络(Convolutional Neural Networks,CNNs)在计算机视觉和深度学习领域中发挥了重要作用,并且有许多知名的CNN架构,其中一些包括:

-

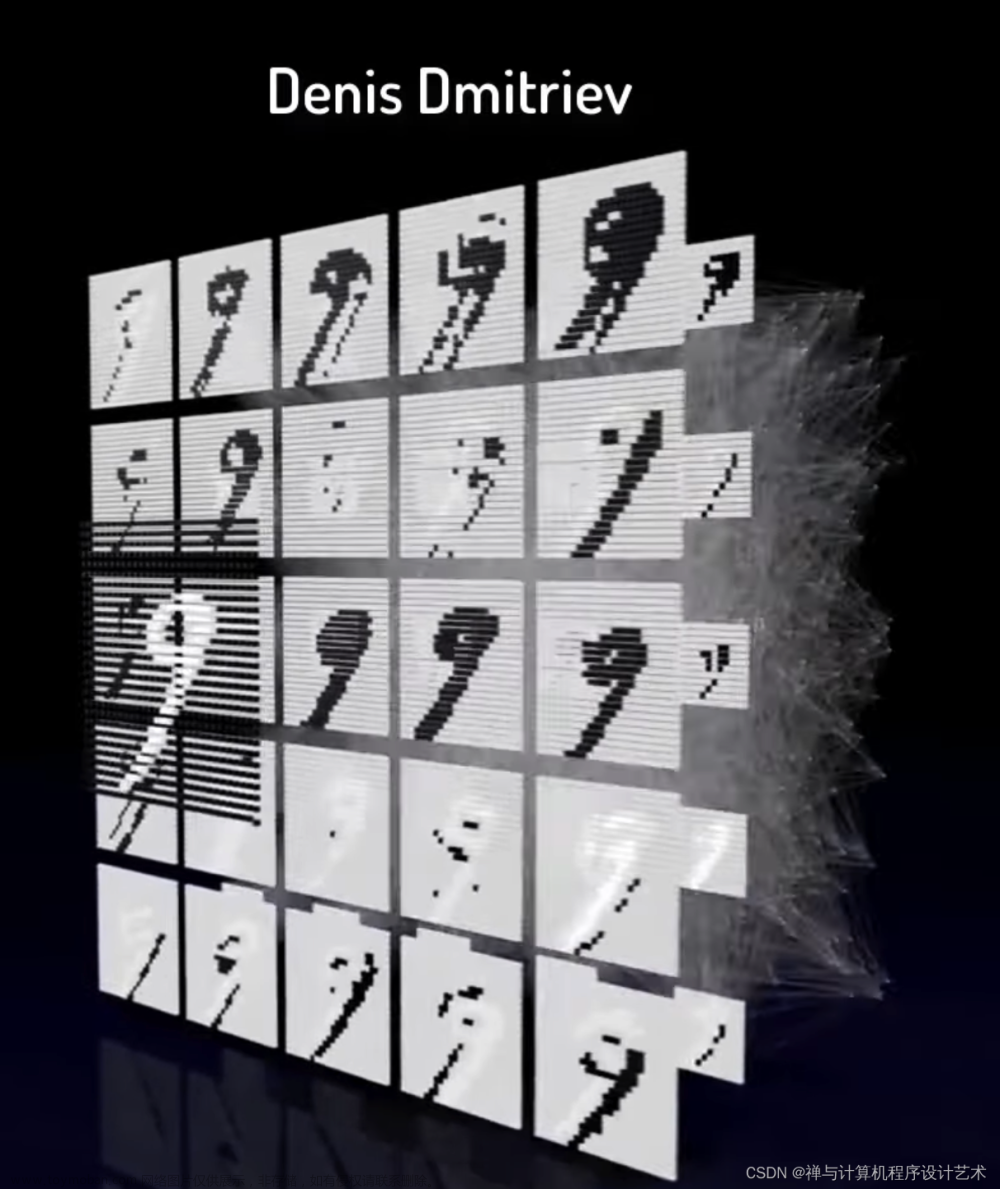

LeNet-5:LeNet-5由Yann LeCun于1998年提出,是最早的卷积神经网络之一,用于手写数字识别。它由卷积层、池化层和全连接层组成,为卷积神经网络的发展奠定了基础。

-

AlexNet:AlexNet由Alex Krizhevsky、Ilya Sutskever和Geoffrey Hinton于2012年提出,是第一个在ImageNet大规模图像分类竞赛中获得胜利的深度卷积神经网络。它引领了深度学习在计算机视觉中的复兴。

-

VGGNet:VGGNet由牛津大学的研究团队提出,以其深度和简单的卷积层结构而闻名。它有多个版本,如VGG16和VGG19,被广泛用于图像分类和特征提取任务。

-

GoogLeNet(Inception):GoogLeNet由Google的研究团队于2014年提出。它使用了一种称为Inception模块的结构,可以在减少参数的同时增加网络的深度,使其更加有效。

-

ResNet:ResNet由Microsoft的研究团队在2015年提出,以其深度残差连接结构而著名。这种结构允许训练非常深的网络,有助于避免梯度消失问题。

-

MobileNet:MobileNet是Google提出的一系列轻量级卷积神经网络,旨在在移动设备上进行实时图像处理。它具有高效的模型架构,适用于资源受限的环境。

-

Inception-ResNet:Inception-ResNet是Inception模块和ResNet残差连接的结合,旨在兼顾两者的优点,提高了网络的性能和效率。

-

Xception:Xception是一种极端深度的卷积神经网络,采用了深度可分离卷积,以减少参数量和提高计算效率。

这些是一些知名的卷积神经网络架构,每个架构都在不同领域和任务中取得了显著的成功。根据特定任务的需求和计算资源的限制,选择合适的CNN架构非常重要。此外,还有许多其他CNN变种和自定义架构,以满足不同的应用需求。

三、AlexNet的历史意义

AlexNet之所以被认为是一次重要的突破,是因为它在2012年的ImageNet大规模图像分类竞赛(ILSVRC)中取得了显著的胜利,其性能远远超过了传统的计算机视觉方法。这个胜利表明了深度学习可以在计算机视觉领域表现出色,具体来说,它证明了学习到的特征可以超越手动设计的特征的重要性,原因如下:

-

大规模数据集:AlexNet的成功得益于其在大规模ImageNet数据集上的训练。ImageNet包含了数百万张不同类别的图像,这使得深度神经网络能够从大量多样的数据中学习特征,而不仅仅是受限于手动设计的特征提取器。

-

深度架构:AlexNet采用了深度的卷积神经网络结构,具有多个卷积层和池化层。这种深度架构使得网络可以自动地从原始数据中学习到多层次、抽象的特征表示,而不需要手动设计复杂的特征提取方法。

-

并行计算:AlexNet的架构利用了GPU等并行计算硬件,使得训练大规模神经网络变得可行。这使得深度学习在计算上变得更加高效,从而有可能处理更复杂的问题。

-

激活函数:AlexNet引入了Rectified Linear Unit(ReLU)等新型激活函数,这些激活函数有助于克服神经网络中的梯度消失问题,从而使网络更容易训练。

-

数据增强:AlexNet采用了数据增强技术,通过对训练图像进行随机变换,增加了数据的多样性,有助于提高模型的泛化能力。

总的来说,AlexNet的成功证明了深度学习在大规模图像分类问题上的能力,同时也表明了学习到的特征可以比手动设计的特征更好地捕捉数据的复杂性和层次结构。这个突破激发了深度学习在计算机视觉和其他领域的广泛应用,成为了现代深度学习的奠基之一。

四、AlexNet和LeNet之间的联系

AlexNet和LeNet都是深度卷积神经网络的代表性模型,但它们分别出现在不同的时间和背景下,并具有一些重要的区别。

-

时间和背景:

- LeNet:LeNet是由Yann LeCun于1998年提出的,是深度学习领域中最早的卷积神经网络之一。当时,LeNet主要用于手写数字识别等简单图像分类任务。

- AlexNet:AlexNet由Alex Krizhevsky、Ilya Sutskever和Geoffrey Hinton在2012年提出,并在ImageNet大规模图像分类竞赛(ILSVRC)中取得了显著的成功。它标志着深度学习在计算机视觉领域的崭露头角。

-

网络结构:

- LeNet:LeNet是一个相对较浅的卷积神经网络,包含两个卷积层和三个全连接层。它主要用于手写数字识别,输入图像的分辨率相对较低。

- AlexNet:AlexNet是一个更深的卷积神经网络,包含五个卷积层和三个全连接层。它专门设计用于处理大分辨率的自然图像。

-

激活函数:

- LeNet:LeNet使用的主要激活函数是Sigmoid函数。

- AlexNet:AlexNet引入了Rectified Linear Unit(ReLU)作为主要激活函数,这有助于克服梯度消失问题,加速训练。

-

数据集和任务:文章来源:https://www.toymoban.com/news/detail-704212.html

- LeNet:LeNet最初用于手写数字识别,例如MNIST数据集。

- AlexNet:AlexNet最初用于ImageNet大规模图像分类竞赛,处理包含数百万张大尺寸自然图像的数据集。

尽管有这些区别,AlexNet可以被视为LeNet的进一步发展和扩展,它引入了更深的网络结构、更大的数据集和更有效的激活函数。AlexNet的成功为深度学习在计算机视觉领域的广泛应用铺平了道路,同时也标志着深度学习的复兴和关注,成为现代深度学习的里程碑之一。文章来源地址https://www.toymoban.com/news/detail-704212.html

到了这里,关于“现代”“修饰”卷积神经网络,何谓现代的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!