一、神经网络的搭建

tf.Keras 中构建模有两种方式,一种是通过 Sequential 构建,一种是通过 Model 类构建。前者是按一定的顺序对层进行堆叠,而后者可以用来构建较复杂的网络模型。首先我们介绍下用来构建网络的全连接层:

tf.keras.layers.Dense(

units, activation=None, use_bias=True, kernel_initializer='glorot_uniform',

bias_initializer='zeros')

units: 当前层中包含的神经元个数

Activation: 激活函数,relu,sigmoid等

use_bias: 是否使用偏置,默认使用偏置

Kernel_initializer: 权重的初始化方式,默认是Xavier初始化

bias_initializer: 偏置的初始化方式,默认为0

1.1 通过Sequential构建

Sequential() 提供一个层的列表,就能快速地建立一个神经网络模型,实现方法如下所示:

# 导入相关的工具包

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras import layers

# 定义一个Sequential模型,包含3层

model = keras.Sequential(

[

# 第一层(隐藏层):激活函数为relu,权重初始化为he_normal

layers.Dense(3, activation="relu",

kernel_initializer="he_normal", name="layer1",input_shape=(3,)),

# 第二层(隐藏层):激活函数为relu,权重初始化为he_normal

layers.Dense(2, activation="relu",

kernel_initializer="he_normal", name="layer2"),

# 第三层(输出层):激活函数为sigmoid,权重初始化为he_normal

layers.Dense(2, activation="sigmoid",

kernel_initializer="he_normal", name="layer3"),

],

name="my_Sequential" # 定义该模型的名字

)

# 展示模型结果

model.summary()

通过这种 sequential 的方式只能构建简单的序列模型,较复杂的模型没有办法实现。

1.2 利用function API构建

tf.keras 提供了 Functional API,建立更为复杂的模型,使用方法是将层作为可调用的对象并返回张量,并将输入向量和输出向量提供给 tf.keras.Model 的 inputs 和 outputs 参数,实现方法如下:文章来源:https://www.toymoban.com/news/detail-708929.html

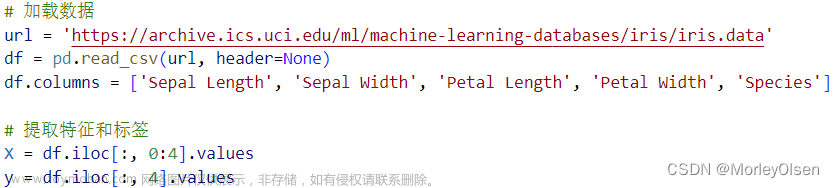

# 导入工具包

import tensorflow as tf

# 定义模型的输入

inputs = tf.keras.Input(shape=(3,),name = "input")

# 第一层:激活函数为relu,其他默认

x = tf.keras.layers.Dense(3, activation="relu",name = "layer1")(inputs)

# 第二层:激活函数为relu,其他默认

x = tf.keras.layers.Dense(2, activation="relu",name = "layer2")(x)

# 第三层(输出层):激活函数为sigmoid

outputs = tf.keras.layers.Dense(2, activation="sigmoid",name = "layer3")(x)

# 使用Model来创建模型,指明输入和输出

model = tf.keras.Model(inputs=inputs, outputs=outputs,name="my_model")

1.3 通过model的子类构建

通过 model 的子类构建模型,此时需要在 __init__ 中定义神经网络的层,在 call 方法中定义网络的前向传播过程,实现方法如下:文章来源地址https://www.toymoban.com/news/detail-708929.html

# 导入工具包

import tensorflow as tf

# 定义model的子类

class MyModel(tf.keras.Model):

# 在init方法中定义网络的层结构

def __init__(self):

super(MyModel, self).__init__()

# 第一层:激活函数为relu,权重初始化为he_normal

self.layer1 = tf.keras.layers.Dense(3, activation="relu",

kernel_initializer="he_normal", name="layer1",input_shape=(3,))

# 第二层:激活函数为relu,权重初始化为he_normal

self.layer2 =tf.keras.layers.Dense(2, activation="relu",

kernel_initializer="he_normal", name="layer2")

# 第三层(输出层):激活函数为sigmoid,权重初始化为he_normal

self.layer3 =tf.keras.layers.Dense(2, activation="sigmoid",

kernel_initializer="he_normal", name="layer3")

# 在call方法中完成前向传播

def call(self, inputs):

x = self.layer1(inputs)

x = self.layer2(x)

return self.layer3(x)

# 实例化模型

model = MyModel()

# 设置一个输入,调用模型(否则无法使用summay())

x = tf.ones((1, 3))

y = model(x)

到了这里,关于神经网络 04(神经网络的搭建)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!