目录

分布式内存计算Spark环境部署

1. 简介

2. 安装

2.1【node1执行】下载并解压

2.2【node1执行】修改配置文件名称

2.3【node1执行】修改配置文件,spark-env.sh

2.4 【node1执行】修改配置文件,slaves

2.5【node1执行】分发

2.6【node2、node3执行】设置软链接

2.7【node1执行】启动Spark集群

2.8 打开Spark监控页面,浏览器打开:

2.9【node1执行】提交测试任务

分布式内存计算Flink环境部署

1. 简介

2. 安装

2.1【node1操作】下载安装包

2. 2【node1操作】修改配置文件,conf/flink-conf.yaml

2.3 【node1操作】,修改配置文件,conf/slaves

2.4【node1操作】分发Flink安装包到其它机器

2.5 【node2、node3操作】

2.6 【node1操作】,启动Flink

2.7 验证Flink启动

2.8 提交测试任务

注意:

本小节的操作,基于:大数据集群(Hadoop生态)安装部署环节中所构建的Hadoop集群,如果没有Hadoop集群,请参阅前置内容,部署好环境。

大数据集群(Hadoop生态)安装部署:

大数据集群(Hadoop生态)安装部署_时光の尘的博客-CSDN博客

大数据NoSQL数据库HBase集群部署:

大数据NoSQL数据库HBase集群部署-CSDN博客

分布式内存计算Spark环境部署

1. 简介

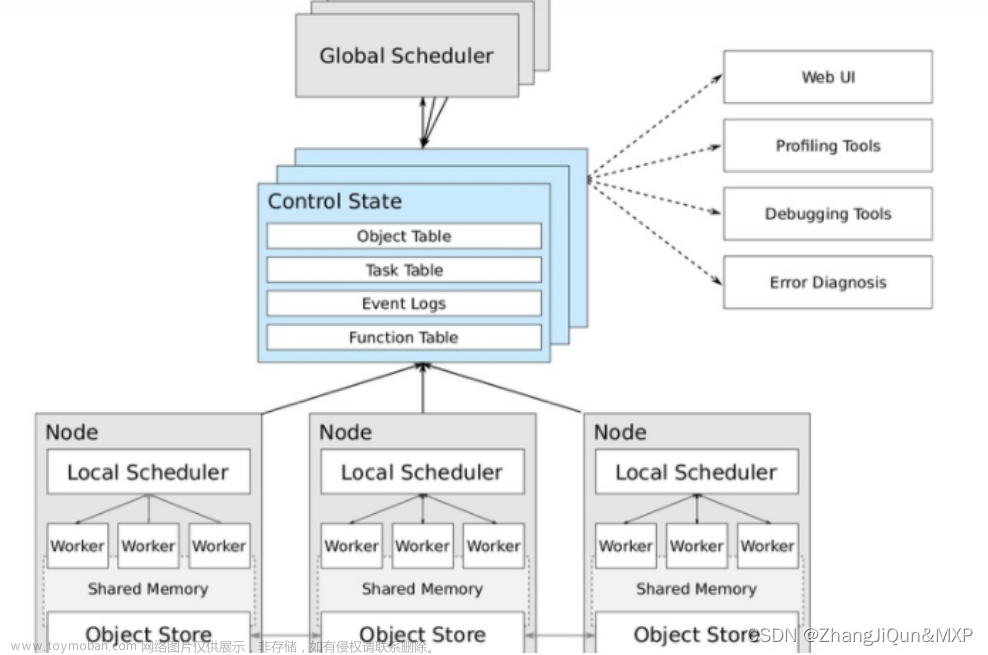

Spark是一款分布式内存计算引擎,可以支撑海量数据的分布式计算。

Spark在大数据体系是明星产品,作为最新一代的综合计算引擎,支持离线计算和实时计算。

在大数据领域广泛应用,是目前世界上使用最多的大数据分布式计算引擎。

我们将基于前面构建的Hadoop集群,部署Spark Standalone集群。

2. 安装

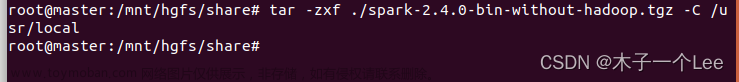

2.1【node1执行】下载并解压

wget https: / archive.apache.org/dist/spark/spark-2.4.5/spark-2.4.5-bin-hadoop2.7.tgz

# 解压

tar -zxvf spark-2.4.5-bin-hadoop2.7.tgz -C /export/server/

# 软链接

ln -s /export/server/spark-2.4.5-bin-hadoop2.7 /export/server/spark2.2【node1执行】修改配置文件名称

# 改名

cd /export/server/spark/conf

mv spark-env.sh.template spark-env.sh

mv slaves.template slaves2.3【node1执行】修改配置文件,spark-env.sh

#设置JAVA安装目录

JAVA_HOME=/export/server/jdk

#HADOOP软件配置文件目录,读取HDFS上文件和运行YARN集群

HADOOP_CONF_DIR=/export/server/hadoop/etc/hadoop

YARN_CONF_DIR=/export/server/hadoop/etc/hadoop

#指定spark老大Master的IP和提交任务的通信端口

export SPARK_MASTER_HOST=node1

export SPARK_MASTER_PORT=7077

SPARK_MASTER_WEBUI_PORT=8080

SPARK_WORKER_CORES=1

SPARK_WORKER_MEMORY=1g2.4 【node1执行】修改配置文件,slaves

node1

node2

node32.5【node1执行】分发

scp -r spark-2.4.5-bin-hadoop2.7 node2:$PWD

scp -r spark-2.4.5-bin-hadoop2.7 node3:$PWD2.6【node2、node3执行】设置软链接

ln -s /export/server/spark-2.4.5-bin-hadoop2.7 /export/server/spark2.7【node1执行】启动Spark集群

/export/server/spark/sbin/start-all.sh

# 如需停止,可以

/export/server/spark/sbin/stop-all.sh2.8 打开Spark监控页面,浏览器打开:

http://node1:8081

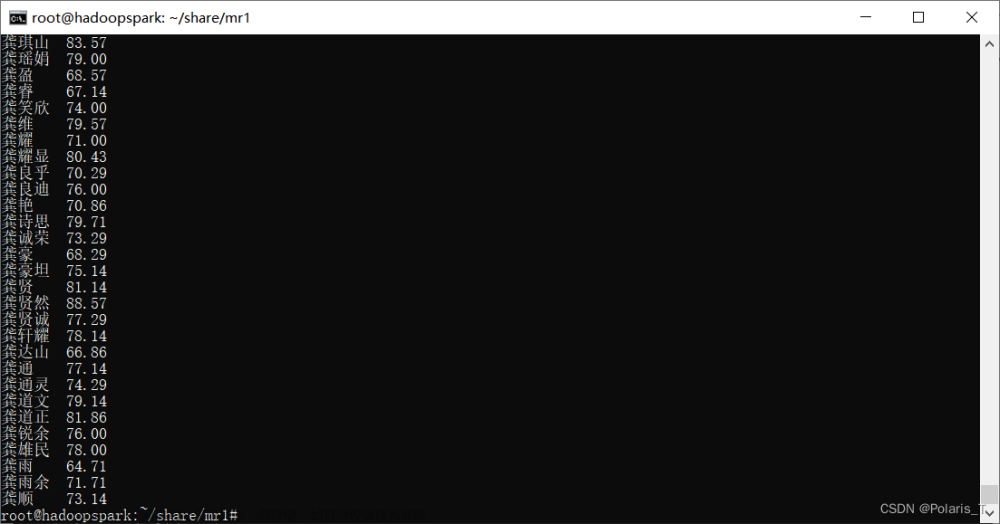

2.9【node1执行】提交测试任务

/export/server/spark/bin/spark-submit --master

spark: / node1:7077 - class

org.apache.spark.examples.SparkPi

/export/server/spark/examples/jars/spark-examples_2.11-2.4.5.jar

分布式内存计算Flink环境部署

1. 简介

Flink同Spark一样,是一款分布式内存计算引擎,可以支撑海量数据的分布式计算。

Flink在大数据体系同样是明星产品,作为最新一代的综合计算引擎,支持离线计算和实时计算。

在大数据领域广泛应用,是目前世界上除去Spark以外,应用最为广泛的分布式计算引擎。

我们将基于前面构建的Hadoop集群,部署Flink Standalone集群

Spark更加偏向于离线计算而Flink更加偏向于实时计算。

2. 安装

2.1【node1操作】下载安装包

wget https: / archive.apache.org/dist/flink/flink-1.10.0/flink-1.10.0-bin-scala_2.11.tgz

# 解压

tar -zxvf flink-1.10.0-bin-scala_2.11.tgz -C

/export/server/

# 软链接

ln -s /export/server/flink-1.10.0

/export/server/flink2. 2【node1操作】修改配置文件,conf/flink-conf.yaml

# jobManager 的IP地址

jobmanager.rpc.address: node1

# JobManager 的端口号

jobmanager.rpc.port: 6123

# JobManager JVM heap 内存大小

jobmanager.heap.size: 1024m

# TaskManager JVM heap 内存大小

taskmanager.heap.size: 1024m

# 每个 TaskManager 提供的任务 slots 数量大小

taskmanager.numberOfTaskSlots: 2

#是否进行预分配内存,默认不进行预分配,这样在我们不使用flink集群时候不会占用集群资源

taskmanager.memory.preallocate: false

# 程序默认并行计算的个数

parallelism.default: 1

#JobManager的Web界面的端口(默认:8081)

jobmanager.web.port: 8081

2.3 【node1操作】,修改配置文件,conf/slaves

node1

node2

node32.4【node1操作】分发Flink安装包到其它机器

cd /export/server

scp -r flink-1.10.0 node2:`pwd`/

scp -r flink-1.10.0 node3:`pwd`/2.5 【node2、node3操作】

# 配置软链接

ln -s /export/server/flink-1.10.0

/export/server/flink2.6 【node1操作】,启动Flink

/export/server/flink/bin/start-cluster.sh2.7 验证Flink启动

# 浏览器打开

http://node1:80812.8 提交测试任务

【node1执行】

/export/server/flink/bin/flink run

/export/server/flink-1.10.0/examples/batch/WordCount.jar更多环境部署:

MySQL5.7版本与8.0版本在CentOS系统安装:

MySQL5.7版本与8.0版本在CentOS系统安装_时光の尘的博客-CSDN博客

MySQL5.7版本与8.0版本在Ubuntu(WSL环境)系统安装:

MySQL5.7版本与8.0版本在Ubuntu(WSL环境)系统安装-CSDN博客

Tomcat在CentOS上的安装部署:

Tomcat在CentOS上的安装部署-CSDN博客

Nginx在CentOS上的安装部署、RabbitMQ在CentOS上安装部署:

Nginx在CentOS上的安装部署、RabbitMQ在CentOS上安装部署-CSDN博客

集群化环境前置准备:

集群化环境前置准备_时光の尘的博客-CSDN博客

Zookeeper集群安装部署、Kafka集群安装部署:文章来源:https://www.toymoban.com/news/detail-714686.html

Zookeeper集群安装部署、Kafka集群安装部署_时光の尘的博客-CSDN博客文章来源地址https://www.toymoban.com/news/detail-714686.html

到了这里,关于分布式内存计算Spark环境部署与分布式内存计算Flink环境部署的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!