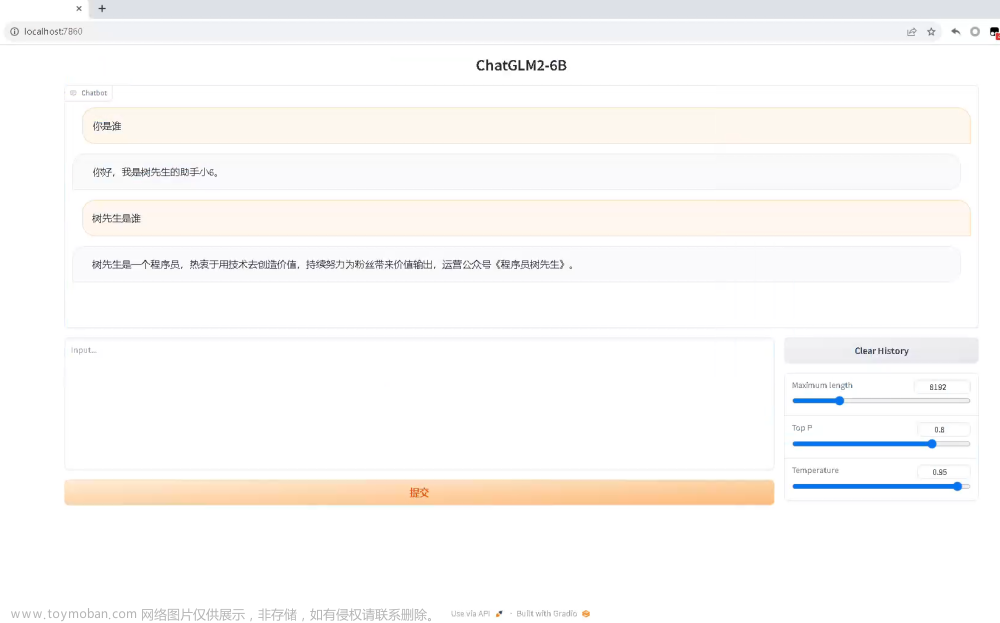

LLMs之ChatGLM2:基于ChatGLM Efficient Tuning(微调工具包)实现对ChatGLM2进行LoRA微调(CLI/GUI【text-generation-webui】)并进行推理测试图文教程之详细攻略

目录

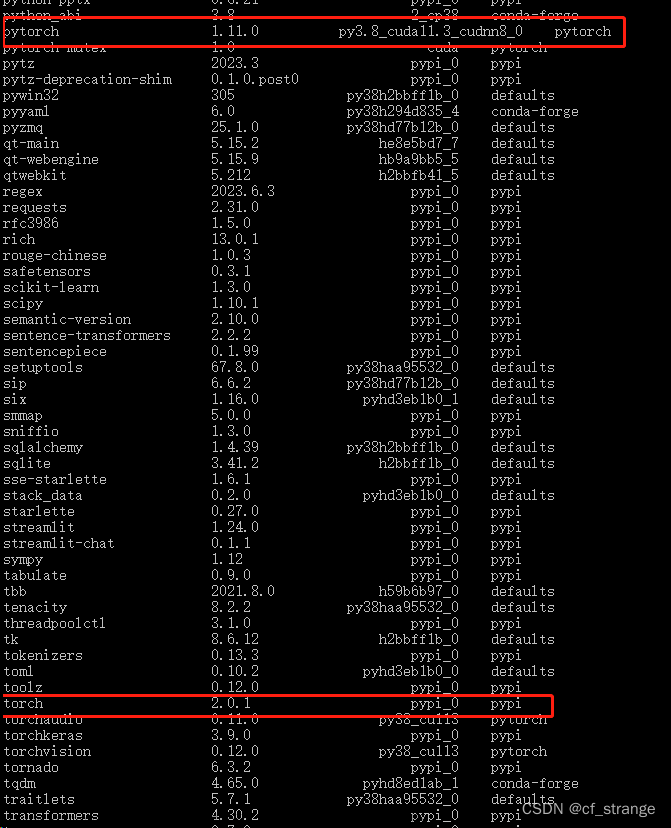

1、硬件要求和Python依赖

2、代码和模型权重下载文章来源:https://www.toymoban.com/news/detail-718609.html

(1)、项目代码下载文章来源地址https://www.toymoban.com/news/detail-718609.html

到了这里,关于LLMs之ChatGLM2:基于ChatGLM Efficient Tuning(微调工具包)实现对ChatGLM2进行LoRA微调(CLI/GUI【text-generation-webui】)并进的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!