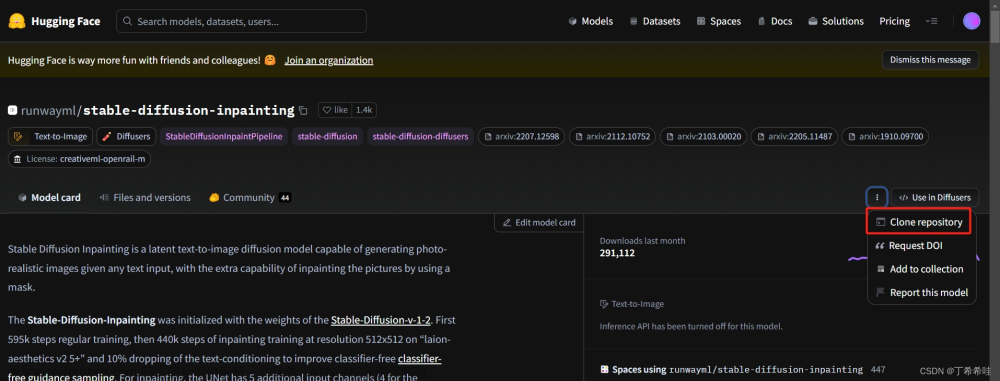

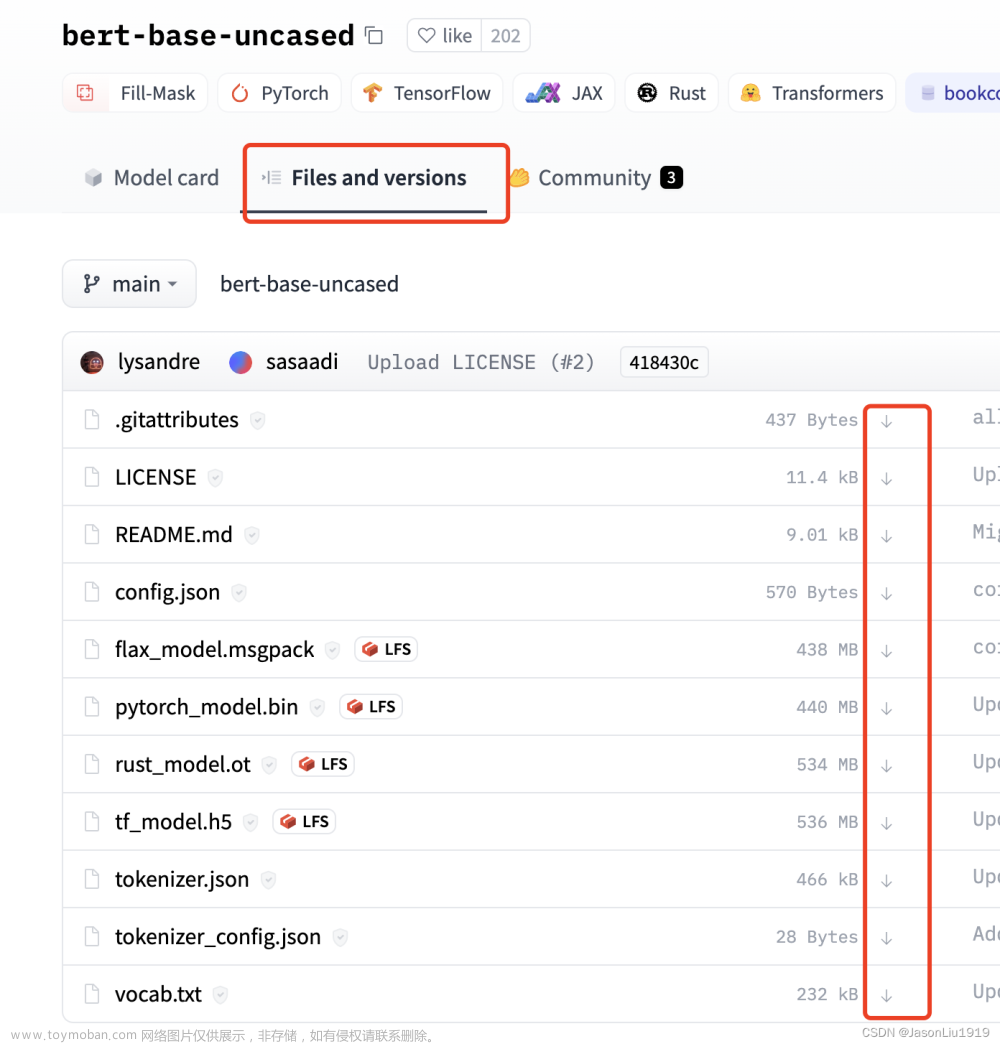

方法1:直接在Huggingface上下载,但是要fanqiang,可以git clone或者在代码中:

from huggingface_hub import snapshot_download

# snapshot_download(repo_id="decapoda-research/llama-7b-hf")

snapshot_download(repo_id="THUDM/chatglm3-6b")

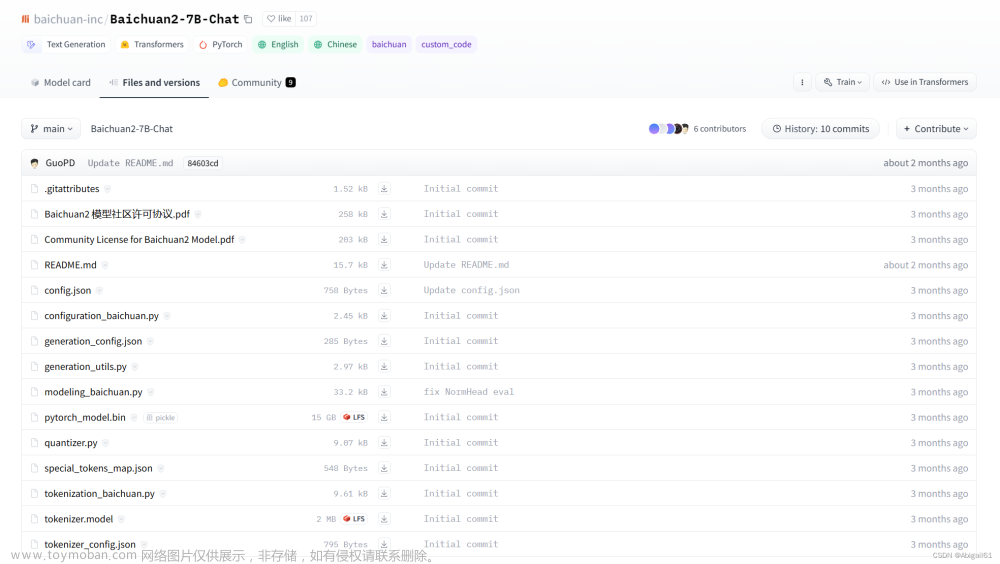

方法2:使用modelscope:

pip install modelscope

# 从modelscope上下载模型

from modelscope.hub.snapshot_download import snapshot_download

model_dir = snapshot_download('baichuan-inc/baichuan-7B', cache_dir='./model', revision='master')

如果你网速很好,下载就很快,如果是kb/s,那么大文件下载会失败。

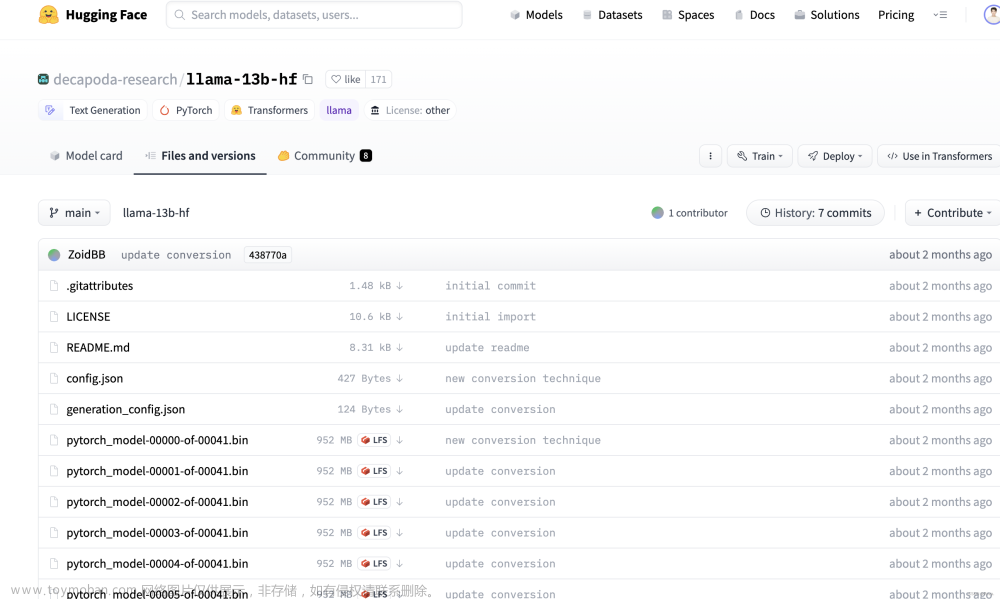

方法3:使用hf的镜像网站,https://hf-mirror.com/baichuan-inc

代码还是使用的huggingface那坨,但是在terminal运行代码时加上HF_ENDPOINT=https://hf-mirror.com:文章来源:https://www.toymoban.com/news/detail-720599.html

HF_ENDPOINT=https://hf-mirror.com python download_data.py

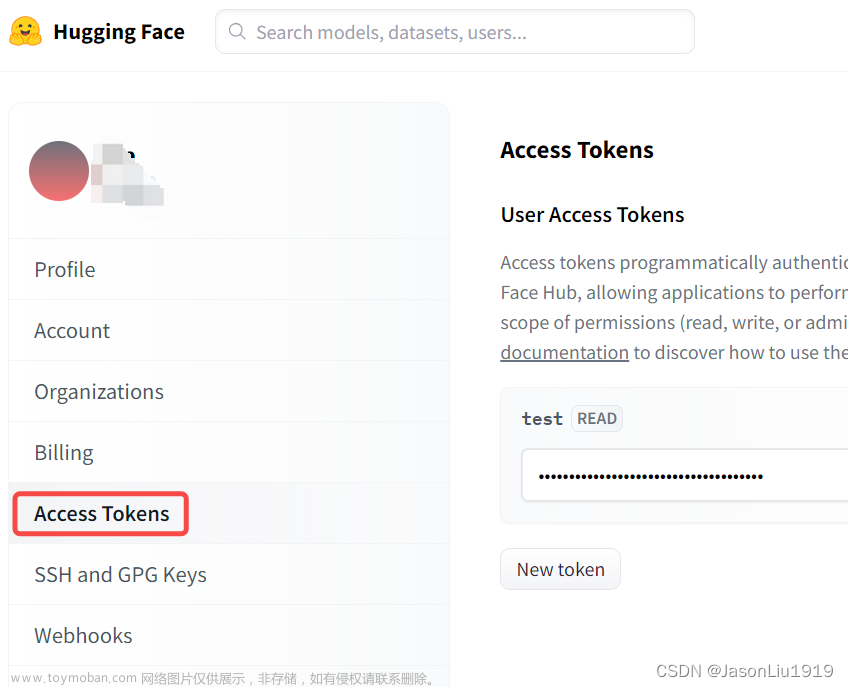

注:huggingface的镜像网站下载llama2系列模型如何加认证的信息啊?

加 huggingface access token 就可以下载,wget --header=“Authorization: Bearer <hf_token>” url ,如果是git clone,则提示输密码时输入access token。文章来源地址https://www.toymoban.com/news/detail-720599.html

到了这里,关于【tips】huggingface下载模型权重的方法的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!