作者:禅与计算机程序设计艺术

1.简介

Apache Spark Streaming 是 Apache Spark 提供的一个用于高吞吐量、容错的流式数据处理引擎。它可以实时的接收数据并在系统内部以微批次的方式进行处理,并将结果输出到文件、数据库或实时消息系统中。Spark Streaming 支持 Java、Scala 和 Python 编程语言。本文将详细介绍 Spark Streaming 的相关原理及功能特性,包括其核心概念和术语、架构设计、主要组件及应用场景等。最后,通过实际案例展示如何在 Hadoop Yarn 上部署和运行 Spark Streaming 流程,并对比 Spark Structured Streaming 对实时流式数据分析的优缺点。

文章假定读者具有一定的编程能力,并且熟悉 Hadoop MapReduce 或 Spark 基本的 API 操作。对于 Java 开发人员来说,还需要掌握 Java 多线程编程模型和集合框架等知识。

2.基本概念和术语

2.1 Apache Spark Streaming概述

Apache Spark Streaming 是 Apache Spark 提供的一个用于高吞吐量、容错的流式数据处理引擎。它可以实时的接收数据并在系统内部以微批次的方式进行处理,并将结果输出到文件、数据库或实时消息系统中。Spark Streaming 使用反应式数据流(Reactive Data Stream)编程模型,它允许对实时输入的数据进行快速地、批量地、增量地处理。文章来源:https://www.toymoban.com/news/detail-720792.html

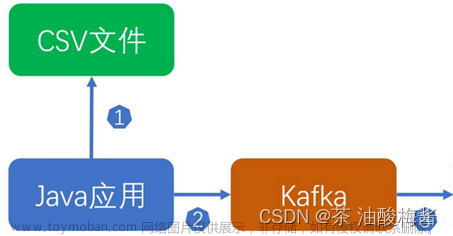

Spark Streaming 可以同时支持离线数据处理和实时数据处理。它的输入数据来源可以是任何可被 Spark 支持的文件格式,比如 HDFS、Kafka、Flume、Kinesis、TCP Socket、或从其他消息队列读取。然后,S文章来源地址https://www.toymoban.com/news/detail-720792.html

到了这里,关于Spark Streaming实时流式数据处理的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!