Alexnet

VGG

VGG的启示

VGGNet采用了多次堆叠3x3的卷积核,这样做的目的是减少参数的数量。

例如,2个3x3的卷积核效果相当于1个5x5的卷积核效果,因为它们的感受野(输入图像上映射区域的大小)相同。但2个3x3卷积核的参数个数(18个)却比1个5x5(25个)的卷积核参数个数少。

类似地,3个3x3的卷积核相当于1个7x7的卷积核,而1个7x7的卷积核的参数个数为49,而3个3x3的卷积核的参数个数仅为27。

感受野

ResNet

为了解决深度神经网络存在的问题

· 层数越多,训练效果一定越好吗?

· 如何优化过深的神经网络?

· 如何避免梯度消失和梯度爆炸? 文章来源:https://www.toymoban.com/news/detail-722954.html

文章来源:https://www.toymoban.com/news/detail-722954.html

ResNet 即深度残差网络

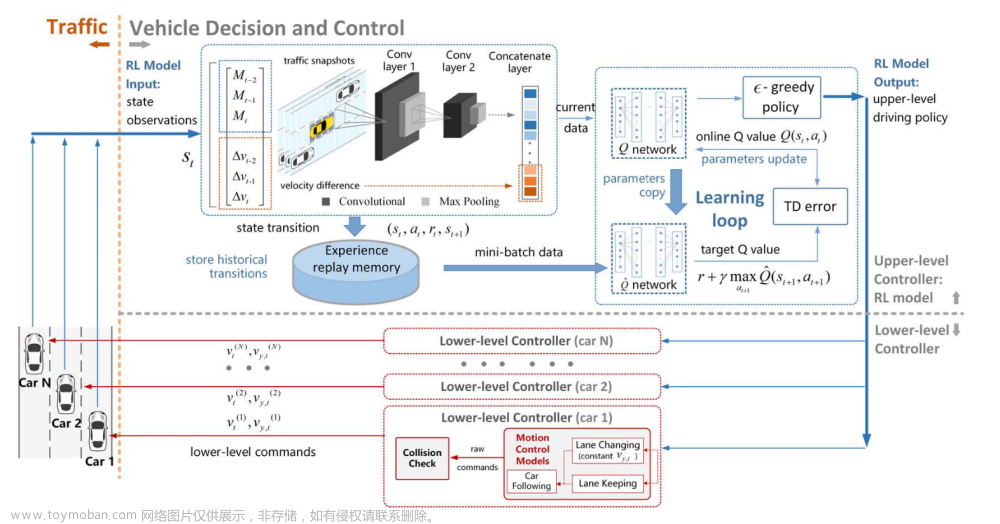

ResNet使用了一种连接方式叫做“shortcut connection”,顾名思义,shortcut就是“抄近道”的意思

ResNet模型引入残差网络结构,在两层或两层以上的节点两端添加了一条“捷径”,这样一来,原来的输出F(x)就变成了F(x)+x

ResNet通过引入残差结构,我们就可以直接使用传统的反向传播对很深的神经网络进行训练,并且收敛速度快,误差小网络越深,梯度消失的现象就越来越明显,网络的训练效果也不好,这样的问题就称为“退化”

ResNet通过引入残差结构,很好地解决了"退化"问题,退化与过拟合都会使网络预测准确率降低,但两者并不是一回事文章来源地址https://www.toymoban.com/news/detail-722954.html

到了这里,关于经典网络模型的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!