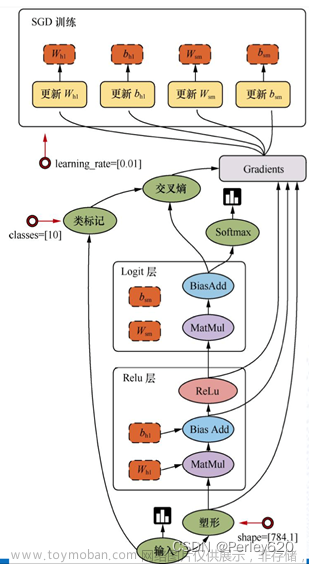

梯度下降法(Gradient Descent):

这是最常见的神经网络训练方法之一。它通过计算损失函数对权重的梯度,并沿着梯度的反方向更新权重,从而逐步减小损失函数的值。梯度下降有多个变种,包括随机梯度下降(SGD)和小批量梯度下降。

反向传播算法(Backpropagation):

反向传播是一种基于链式法则的方法,用于计算神经网络中每个神经元的梯度。这些梯度用于更新权重,以减小损失函数。反向传播通常与梯度下降一起使用。

动量法(Momentum):

动量法是一种改进的梯度下降方法,它引入了动量项,有助于加速收敛并减少震荡。它通过考虑之前梯度的方向来更新权重。

自适应学习率方法:

这些方法自动调整学习率,以便在训练过程中更好地收敛。常见的自适应学习率算法包括Adagrad、RMSprop和Adam。

遗传算法(Genetic Algorithms):

遗传算法是一种进化算法,用于优化神经网络的权重和结构。它通过模拟自然选择和遗传机制来搜索最佳解决方案。

正则化方法:

正则化方法用于防止过拟合,包括L1正则化和L2正则化。它们在损失函数中引入额外的项,以惩罚权重的大小。

Dropout:

Dropout是一种正则化技术,随机地在训练过程中关闭一些神经元,以减少过拟合风险。文章来源:https://www.toymoban.com/news/detail-727231.html

卷积神经网络特定方法:

对于卷积神经网络(CNN),还存在一些特定的训练方法,如权重共享和池化。文章来源地址https://www.toymoban.com/news/detail-727231.html

到了这里,关于深度学习DAY3:神经网络训练常见算法概述的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![计算机视觉与深度学习-全连接神经网络-训练过程-欠拟合、过拟合和Dropout- [北邮鲁鹏]](https://imgs.yssmx.com/Uploads/2024/02/732361-1.png)