目录

一、前言

二、使用Python爬取舆情数据

1.安装requests库

2.分析数据

3.爬取数据

三、通过代理IP提高数据爬取效率

1.获取代理IP

2.使用代理IP

四、使用Flask框架实现舆情监控可视化系统

五、使用MongoDB存储数据

六、总结

一、前言

在当今社会,舆情监控越来越被重视。随着互联网技术的发展,我们从传统媒体渠道、官方报告、调查问卷等方式搜集到的舆情信息,逐渐被网络上的内容所替代。因为网络上的内容传播速度快、及时性强、覆盖范围广,成为了管理者、企业、政府等了解社会大众情绪、掌握市场动向的重要途径。

本文介绍如何基于Flask框架,使用Python语言编写一个高校舆情分析,舆情监控可视化系统。下面主要涉及5个方面:

- 如何使用Python爬取舆情数据;

- 如何通过代理IP提高数据爬取效率;

- 如何使用Flask框架实现舆情监控可视化系统;

- 如何使用MongoDB存储数据;

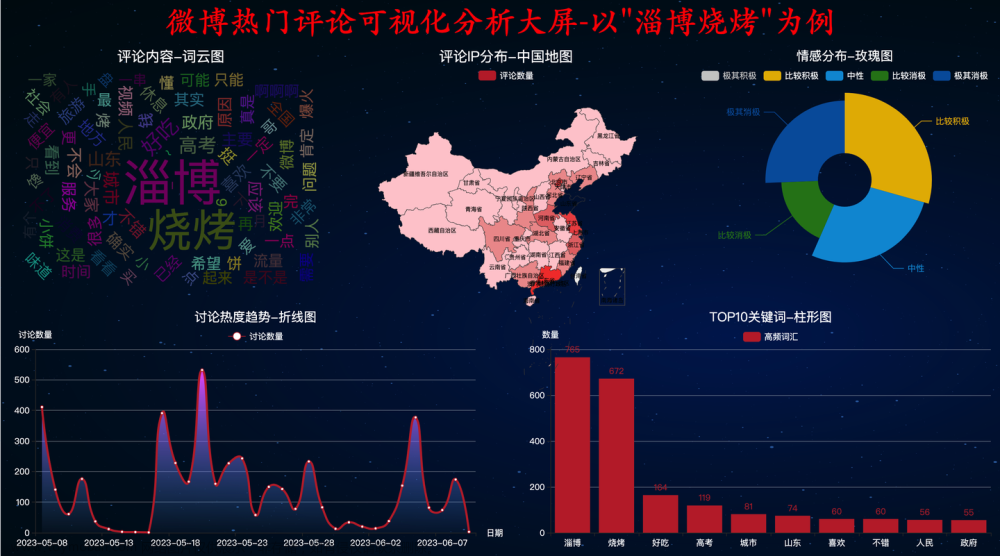

- 如何使用ECharts实现数据可视化展示。

二、使用Python爬取舆情数据

爬取舆情数据主要有两种方式,一种是直接使用API接口,通过调用API获取相应的数据。另一种方式是使用Python爬取网站上的数据。

本文介绍的是第二种数据获取方式,以爬取中国大学排名网为例。

1.安装requests库

使用Python爬取网站数据,首先需要安装requests库,requests库是Python中的HTTP客户端库,能够模拟HTTP请求,发送请求、接收响应。使用以下命令进行安装:

!pip install requests2.分析数据

在爬取数据前,我们需要分析数据。打开中国大学排名网,点击“大学排名”->“全球排名”,网站链接为:http://www.zuihaodaxue.com/ARWU2020.html 。

从网站中我们可以看到展示的数据大致如下:

我们需要获取的数据列为“排名”、“学校名称”、“所在地区”、“总分”。

3.爬取数据

分析完数据之后,我们就可以开始爬取数据。首先,我们需要导入requests库、BeautifulSoup库。

import requests

from bs4 import BeautifulSoup接着,我们需要设置请求头和请求参数,这里我们设置如下:

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3'}

params = {

'from': 'hao360',

'ie': 'utf-8',

'query': 'python'}

其中,headers为请求头,用于告诉服务器我们的身份信息,params为请求参数,表示要搜索“python”关键词。

接着,我们使用requests库发送请求,获取网页内容,并解析所需的数据。

url = 'http://www.zuihaodaxue.com/ARWU2020.html'

response = requests.get(url, headers=headers)

response.encoding = response.apparent_encoding

soup = BeautifulSoup(response.text, 'html.parser')

all_university = soup.findAll('tr', {'class': 'bgfd'})

for university in all_university:

rank = university.find('td', {'align': 'center'}).getText()

name = university.find('a').getText()

region = university.find('div', {'style': 'padding-left:10px;'}).getText().strip()

score = university.findAll('td', {'align': 'center'})[-1].getText()

print(rank, name, region, score)这样,我们就可以获取到所有大学的排名、学校名称、所在地区、总分数据。

不过需要注意,如果直接爬取网站,可能会被封IP,下一节会介绍如何通过代理IP提高数据爬取效率。

三、通过代理IP提高数据爬取效率

当我们爬取数据时,如果频繁访问同一个网站,可能会被检测到,从而导致IP被封,无法正常访问。这时候,我们可以使用代理IP来避免这个问题,使用代理IP进行数据爬取,可以更好地保护我们的真实IP,达到更好的效果。

1.获取代理IP

在互联网上有很多代理IP提供商,我们可以通过购买代理IP解决被封IP的问题。这里,我们使用的是免费的站大爷代理ip(https://www.zdaye.com/)提供的免费IP。

在站大爷代理ip网站上,我们可以获得如下信息:

- IP地址

- 端口号

- 区域

- 匿名度

- 类型

- 存活时间

- 验证时间

我们需要使用的是IP地址和端口号,将它们加入到请求头中,即可使用代理IP进行数据爬取。

2.使用代理IP

使用代理IP的方式非常简单,只需要将代理IP加入到请求头中即可。例如,以下代码使用站大爷代理提供的代理IP进行数据爬取:

import requests

url = 'http://www.zuihaodaxue.com/ARWU2020.html'

proxies = {'http': 'http://111.177.190.36:9999', 'https': 'https://111.177.190.36:9999'}

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3'}

response = requests.get(url, headers=headers, proxies=proxies)

print(response.text)这里我们设置了一个代理IP,格式为http://IP:port。在发送请求时,通过proxies参数将代理IP加入到请求头中,即可使用代理IP进行数据爬取。

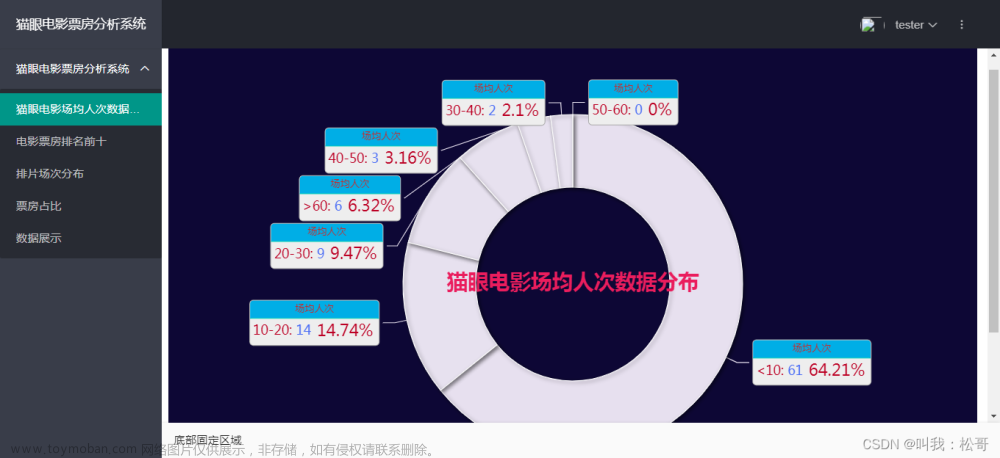

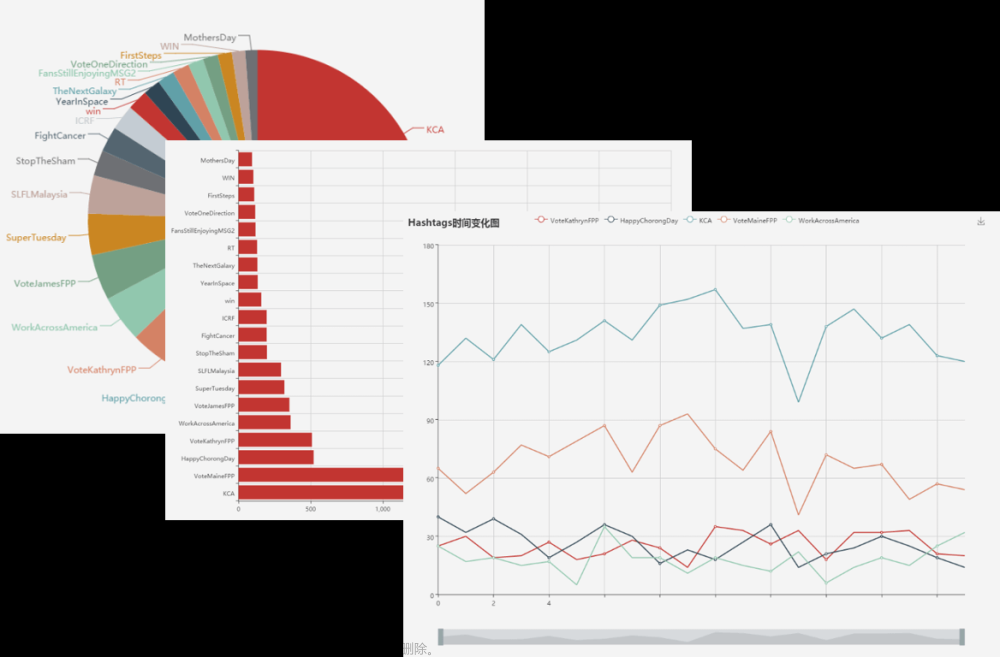

四、使用Flask框架实现舆情监控可视化系统

Flask是一个轻量级的Python Web框架,用于编写基于Web的应用程序。它非常适合小型应用程序和简单的Web服务,同时也可以作为基于大型应用程序的核心。

Flask框架包含了请求分发、模板渲染、数据存取等功能,非常适合开发Web应用程序和API。

在使用Flask框架搭建舆情监控可视化系统时,我们需要安装Flask和pymongo(用于连接MongoDB数据库)库,并使用以下代码创建Flask应用程序:

import json

from flask import Flask, render_template

from pymongo import MongoClient

app = Flask(__name__)

@app.route('/')

def index():

client = MongoClient('localhost', 27017)

db = client['university']

collection = db['ARWU']

data_list = []

for data in collection.find():

del data['_id']

data_list.append(data)

return render_template('index.html', data_list=json.dumps(data_list, ensure_ascii=False))

if __name__ == '__main__':

app.run()其中,localhost代表MongoDB数据库所在的主机名,27017代表MongoDB数据库的端口号。此外,我们也可以使用request库获取前端传输来的数据,例如:

from flask import request

@app.route('/api/search', methods=['GET'])

def search():

keyword = request.args.get('keyword')

client = MongoClient('localhost', 27017)

db = client['university']

collection = db['ARWU']

data_list = []

for data in collection.find({'name': {'$regex': keyword}}):

del data['_id']

data_list.append(data)

return json.dumps(data_list, ensure_ascii=False)在使用Flask框架时,我们需要创建一个templates文件夹,用于存放html文件,如下所示:

在templates文件夹中,我们需要创建一个index.html文件,用于显示数据。具体代码如下:

<!DOCTYPE html>

<html>

<head>

<meta charset="UTF-8">

<title>中国大学排名</title>

<script src="https://cdn.jsdelivr.net/npm/echarts/dist/echarts.min.js"></script>

<style>

/* 设置容器大小 */

#main {

height: 600px;

}

</style>

</head>

<body>

<!-- 设置一个容器用于展示数据 -->

<div id="main"></div>

<!-- 使用JavaScript渲染表格 -->

<script type="text/javascript">

// 获取后端传输的数据

var data = JSON.parse({{data_list}});

// 初始化echarts图表

var myChart = echarts.init(document.getElementById('main'));

// 配置图表参数

var option = {

tooltip: {},

legend: {

data: ['总分']

},

xAxis: {

data: data.map(function (item) {

return item.name;

})

},

yAxis: {},

series: [{

name: '总分',

type: 'bar',

data: data.map(function (item) {

return item.score;

})

}]

};

// 使用刚指定的配置项和数据显示图表。

myChart.setOption(option);

</script>

</body>

</html>这里,我们使用了ECharts库(https://echarts.apache.org/)来实现数据可视化展示。最后,在命令行中运行app.py文件,即可启动Flask应用程序。

五、使用MongoDB存储数据

在本例中,我们使用MongoDB作为数据存储方式。MongoDB是一种非关系型数据库,与关系型数据库相比,MongoDB更加灵活、扩展性更好、支持海量数据存储等特点。

在Python中,我们可以使用pymongo库来进行MongoDB的连接和操作。具体代码如下:

from pymongo import MongoClient

client = MongoClient('localhost', 27017)

db = client['university']

collection = db['ARWU']

data = {'rank': '1', 'name': 'Harvard University', 'region': 'USA', 'score': '100'}

collection.insert_one(data)

result = collection.find({'region': 'USA'})

for data in result:

print(data)在上述代码中,我们首先连接MongoDB,并选择要操作的数据库和集合。然后,我们插入一条数据,并通过find方法查询指定条件的数据。

六、总结

本文介绍了如何使用Python爬取舆情数据,通过使用代理IP提高数据爬取效率。同时,我们还学习了如何使用Flask框架搭建舆情监控可视化系统,以及使用MongoDB存储数据。

这个舆情监控可视化系统还有许多需要完善和改进的地方,例如如何实时更新数据、如何提高数据可视化展示的交互性等等,希望读者能够在此基础上进行更进一步的探索和实践。文章来源:https://www.toymoban.com/news/detail-731783.html

文章来源地址https://www.toymoban.com/news/detail-731783.html

到了这里,关于Python基于Flask的高校舆情分析,舆情监控可视化系统的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!