前言

如果你要问我为什么直接部署ChatGLM2的模型?

因为当我在8月份在上海召开的全球人工智能大会上了解到清华-智谱发布的ChatGLM模型时,它已经发布了新的版本ChatGLM2,并且推理的效果提升了不少,那么本着只要最好的原则,我就直接上手先玩新版本了。

模型简介

部署的环境

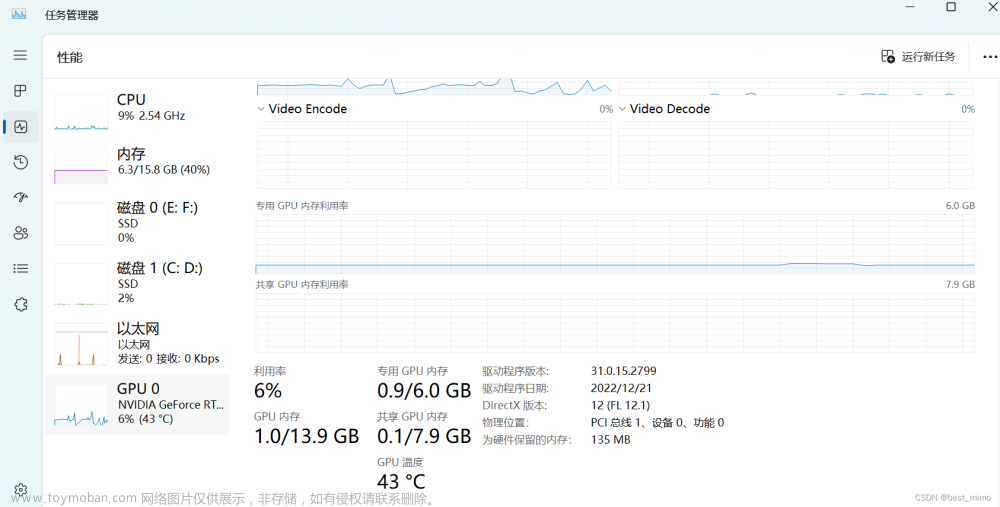

作为AIGC方面的小白来说,我抱着非常天真的想法,想让它在我的工作笔记本上用i5的CPU去跑,至于为什么这么想,当然是因为我没有GPU,身边也没有其他的带显卡电脑

恰好,在腾讯云看到了GN7的显示优惠活动,60块钱15天,Nvidia T4的AI卡,直接斥巨资购买了15天

并且为了方便访问模型资源,我这里选择了新加坡的节点

软件环境

腾讯云的服务器,我选择了自己常用ubuntu镜像,同时此模型都是基于python语言,pytorch框架训练的模型,为了便于管理python版本库,使用anaconda来管理。

具体软件环境版本如下:

conda 4.8.2

python 3.9

pytorch2.0.1

cuda 11.7

具体的软件环境搭建过程,另起一篇去记录

代码工程及模型准备

1. github工程准备

git clone https://github.com/THUDM/ChatGLM2-6B.git

下载完后,进入到工程目录下 需要执行 pip install -r requirements.txt 安装需要的依赖

2. 模型权重准备

模型权重一般在huggingface上,但是现在huggingface被墙了,国内的同学需要科学上网才行,这里国内的小伙伴推荐去国内的modelscope下载模型权重

下载前需要安装git-lfs

sudo apt-get install git-lfs

使用git下载:

git lfs clone https://www.modelscope.cn/ZhipuAI/chatglm2-6b.git

运行

1.修改运行脚本cli_demo.sh

将模型路径修改为本地路径,即刚刚从modelscope下载的

2.运行推理

跑一个命令行的对话

python cli_demo.py

同时,官方也提供了 网页版的web_demo,同样只需要修改模型路径为本地即可文章来源:https://www.toymoban.com/news/detail-735557.html

体验

文章来源地址https://www.toymoban.com/news/detail-735557.html

文章来源地址https://www.toymoban.com/news/detail-735557.html

到了这里,关于AIGC - ChatGLM大模型:ChatGLM2-6B模型推理部署的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!