目录

一、准备工作

1、安装Python和相关库

2、确定目标网站和数据结构

二、编写爬虫代码

1、导入库

2、设置代理IP

3、发送HTTP请求并解析HTML页面

4、查找音频文件链接

5、提取音频文件名和下载链接

6、下载音频文件

三、完整代码示例

四、注意事项

1、遵守法律法规和网站规定

2、不要过于频繁地访问网站

3、不要忽略网站的反爬虫机制

4、尊重网站的robots.txt文件

总结

网络爬虫是一种自动化程序,用于从网络上获取数据。在本文中,我们将介绍如何使用Python编写一个简单的网络爬虫,以从特定的音乐网站上爬取高音质音频文件。我们将使用BeautifulSoup库进行HTML解析和数据提取,使用requests库发送HTTP请求,以及使用selenium库模拟浏览器行为。

一、准备工作

1、安装Python和相关库

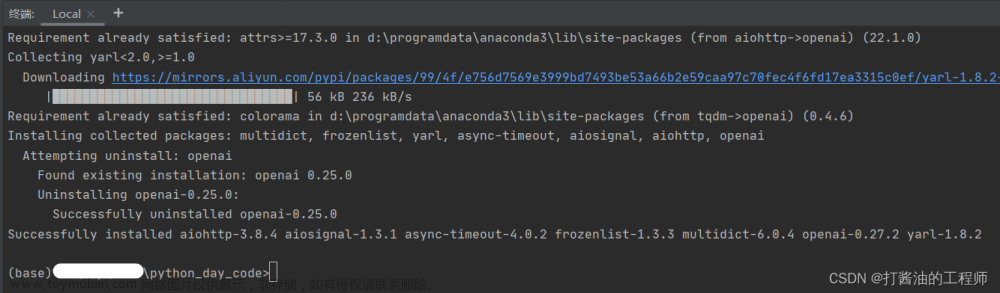

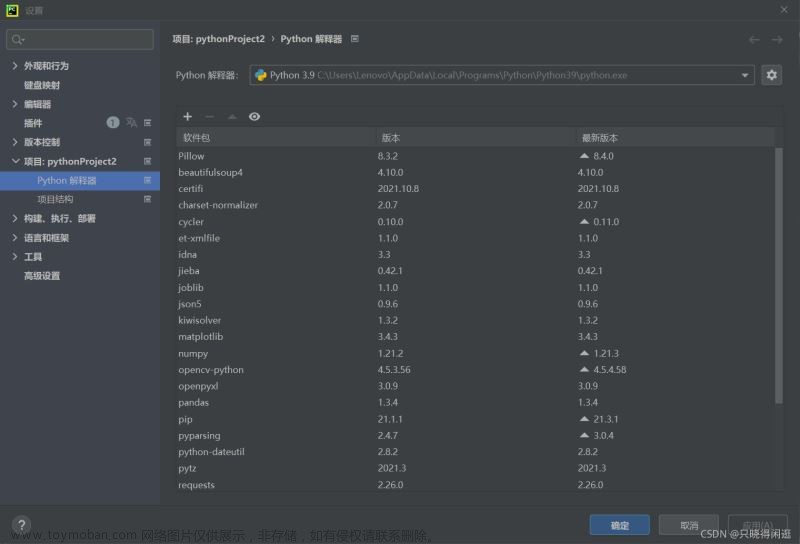

确保您的计算机上已安装Python,并且已安装requests、beautifulsoup4和selenium等库。可以使用以下命令在终端中安装它们:

pip install requests beautifulsoup4 selenium2、确定目标网站和数据结构

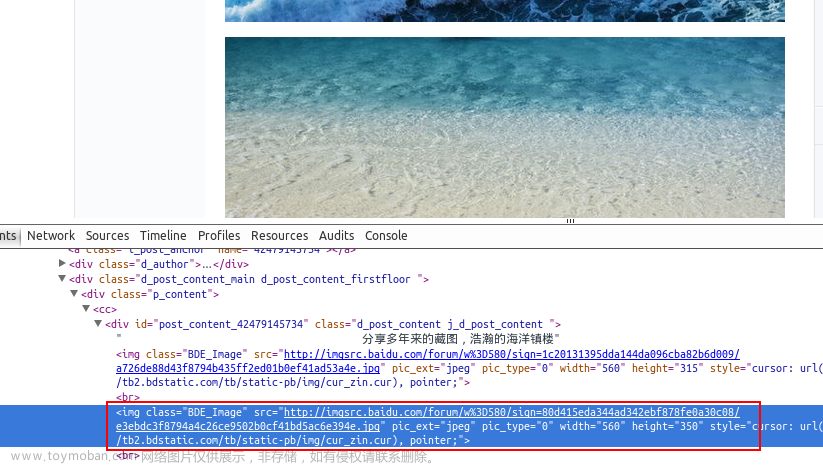

我们需要确定要爬取的目标网站以及网站上的数据结构。在本例中,我们将爬取一个提供高音质音频文件的音乐网站。我们需要了解网站的HTML结构和音频文件的URL地址结构。

二、编写爬虫代码

1、导入库

首先,我们导入所需的库:

python

from bs4 import BeautifulSoup

import requests

from selenium import webdriver

from selenium.webdriver.chrome.options import Options

2、设置代理IP

这里我们使用Chrome浏览器和Selenium库来实现自动化浏览器行为。为了模拟真实用户行为,我们还需要设置Chrome浏览器选项以隐藏浏览器窗口和禁用JavaScript。

from selenium import webdriver

from selenium.webdriver.chrome.options import Options

# 定义代理IP和端口号 ,可以从站大爷网站获取代理IP

proxy_ip = "168.88.88.88"

proxy_port = 16888

# 创建Chrome浏览器选项并设置代理

options = Options()

options.add_argument("--headless") # 隐藏浏览器窗口

options.add_argument("--disable-dev-shm-usage") # 解决内存问题

options.add_argument("--no-sandbox") # 禁用沙盒模式

options.add_argument(f"--proxy-server={proxy_ip}:{proxy_port}") # 设置代理服务器地址和端口号

driver = webdriver.Chrome(options=options)

# 打开目标网站

driver.get("目标网站URL")3、发送HTTP请求并解析HTML页面

接下来,我们发送HTTP请求并解析HTML页面以获取所需数据。在本例中,我们需要找到包含音频文件URL的HTML元素。这里我们使用BeautifulSoup库进行HTML解析和数据提取:

url = "目标网站URL" # 替换为您要爬取的网站URL

response = requests.get(url) # 发送HTTP请求并获取响应内容

soup = BeautifulSoup(response.text, "html.parser") # 解析响应内容为BeautifulSoup对象4、查找音频文件链接

接下来,我们需要查找包含音频文件链接的HTML元素。在本例中,音频文件链接存储在一个包含多个下载链接的列表中。我们可以使用BeautifulSoup库的select方法来查找包含所需数据的HTML元素:

# 查找包含音频文件链接的HTML元素

download_links = soup.select("div.download-links-container a")

# 遍历下载链接并查找音频文件链接

for link in download_links:

href = link["href"]

if "audio" in href or "mp3" in href: # 检查链接中是否包含音频文件扩展名

audio_link = href

break5、提取音频文件名和下载链接

现在,我们可以提取音频文件名和下载链接:

# 提取音频文件名和下载链接

filename = audio_link.split("/")[-1] # 获取文件名

download_link = f"{url}/{audio_link}" # 构建完整的下载链接6、下载音频文件

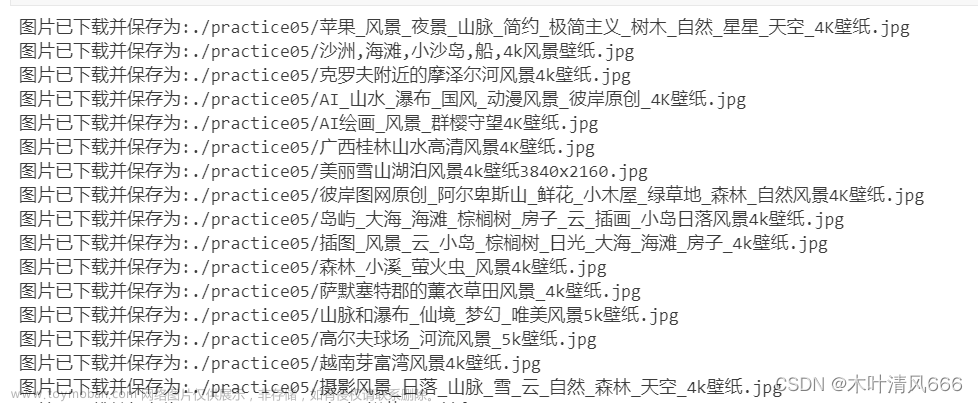

最后,我们可以使用requests库来下载音频文件:

# 下载音频文件

response = requests.get(download_link)

with open(filename, "wb") as file:

file.write(response.content)三、完整代码示例

以下是完整的代码示例:

from bs4 import BeautifulSoup

import requests

from selenium import webdriver

from selenium.webdriver.chrome.options import Options

import time

options = Options()

options.add_argument("--headless") # 隐藏浏览器窗口

options.add_argument("--disable-dev-shm-usage") # 解决内存问题

options.add_argument("--no-sandbox") # 禁用沙盒模式

driver = webdriver.Chrome(options=options)

url = "目标网站URL" # 替换为您要爬取的网站URL

driver.get(url) # 打开网站页面

time.sleep(3) # 等待页面加载完成,根据实际情况适当调整等待时间

response = driver.page_source # 获取页面源代码

soup = BeautifulSoup(response, "html.parser") # 解析页面源代码为BeautifulSoup对象

# 查找包含音频文件链接的HTML元素并提取音频文件名和下载链接

download_links = soup.select("div.download-links-container a")

for link in download_links:

href = link["href"]

if "audio" in href or "mp3" in href: # 检查链接中是否包含音频文件扩展名

audio_link = href

break

filename = audio_link.split("/")[-1] # 获取文件名

download_link = f"{url}/{audio_link}" # 构建完整的下载链接

# 下载音频文件并保存到本地磁盘上

response = requests.get(download_link) # 使用requests库下载音频文件,可以根据实际情况设置请求头和代理等参数

with open(filename, "wb") as file: # 将响应内容保存到本地磁盘上,可以根据实际情况设置保存路径和文件名等参数

file.write(response.content) # 将响应内容写入文件中,保存为二进制格式的文件流数据(byte array)形式。四、注意事项

1、遵守法律法规和网站规定

在编写爬虫代码之前,请确保您已经了解了相关法律法规和网站规定,并遵守它们。在爬取网站数据时,请尊重网站的隐私政策和使用条款,不要侵犯他人的合法权益。

2、不要过于频繁地访问网站

在爬取网站数据时,请注意不要过于频繁地访问网站。如果您的爬虫程序过于频繁地访问网站,可能会被网站封禁或被视为恶意攻击。为了防止这种情况发生,您可以在爬虫程序中添加适当的延迟时间,以模拟真实用户行为。

3、不要忽略网站的反爬虫机制

许多网站都配备了反爬虫机制,以防止恶意攻击或过度访问。在编写爬虫代码时,请注意不要忽略这些机制。如果网站检测到您正在进行爬虫操作,可能会采取措施限制您的访问权限或封禁您的IP地址。因此,您需要在编写爬虫代码时采取相应的防护措施,以避免触发这些机制。

4、尊重网站的robots.txt文件

网站的robots.txt文件通常用于告诉爬虫程序如何访问网站。在编写爬虫代码时,请尊重网站的robots.txt文件,遵循其中的规定和限制。这样可以避免不必要的纠纷和问题。文章来源:https://www.toymoban.com/news/detail-735559.html

总结

通过使用BeautifulSoup库进行HTML解析和数据提取,以及使用requests库发送HTTP请求和Selenium库模拟浏览器行为,我们可以实现自动化地爬取所需数据并下载音频文件。但是,在编写爬虫代码之前,请确保您已经了解了相关法律法规和网站规定,并遵守它们。文章来源地址https://www.toymoban.com/news/detail-735559.html

到了这里,关于用爬虫代码爬取高音质音频示例的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!