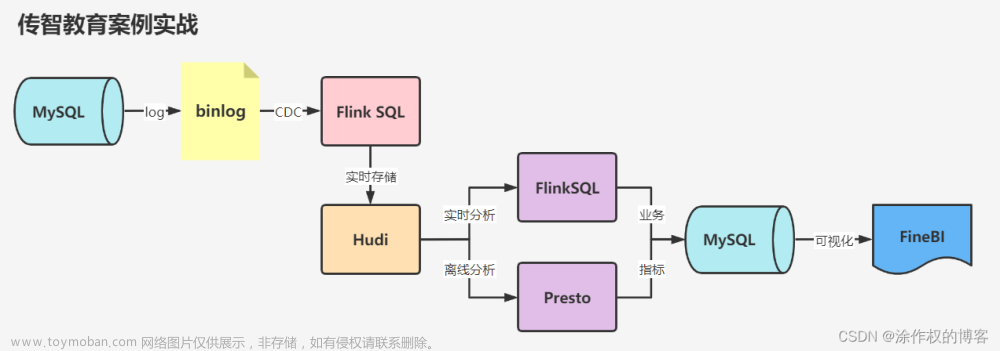

大数据技术在当前的数据分析和处理中扮演着重要的角色。Apache Flink作为一种快速、可靠的流处理引擎,在大规模数据处理中广受欢迎。本文将介绍如何使用Flink CDC(Change Data Capture)从数据库采集数据,并通过设置checkpoint来支持数据采集中断恢复,从而保证数据不丢失。

1. Flink CDC简介

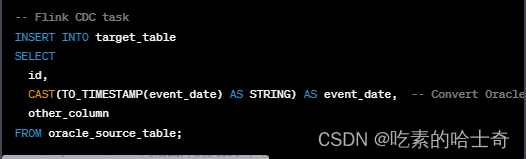

Flink CDC是Flink提供的一个用于捕获数据库变更的组件。它能够监视数据库中的更改操作,并将这些变更以流的形式传递给Flink应用程序进行处理。通过使用Flink CDC,我们可以实现实时的数据库数据同步和实时的数据分析。文章来源:https://www.toymoban.com/news/detail-758466.html

2. 集成Flink CDC到Flink应用程序

首先,我们需要在Flink应用程序中集成Flink CDC。在pom.xml文件中添加相关的依赖项:文章来源地址https://www.toymoban.com/news/detail-758466.html

<dependency>

<groupId>org.apache.flink</groupId到了这里,关于使用Flink CDC从数据库采集数据,保证数据不丢失:实现断点续传机制的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!