Stable Diffusion XL webui tagger 插件Linux安装

为什么要安装tagger插件

为了使SD能生成我们想要的图像效果,往往需要对SD模型进行微调,但其权重参数太多,如果是用更新全部参数的方法来微调,会耗费大量的计算资源。那么可不可以仅需少量计算资源,对模型进行微调,也有不错的效果呢?答案是肯定的,那就是:基于LoRA对其进行微调!

本文写作动机:想自己训练LoRA,需要对训练数据进行tag,但是自己手动tag,比较麻烦,于是考虑用tagger插件,来实现对每张训练图像进行tag,然后在其基础上进行修改,以减少工作量。

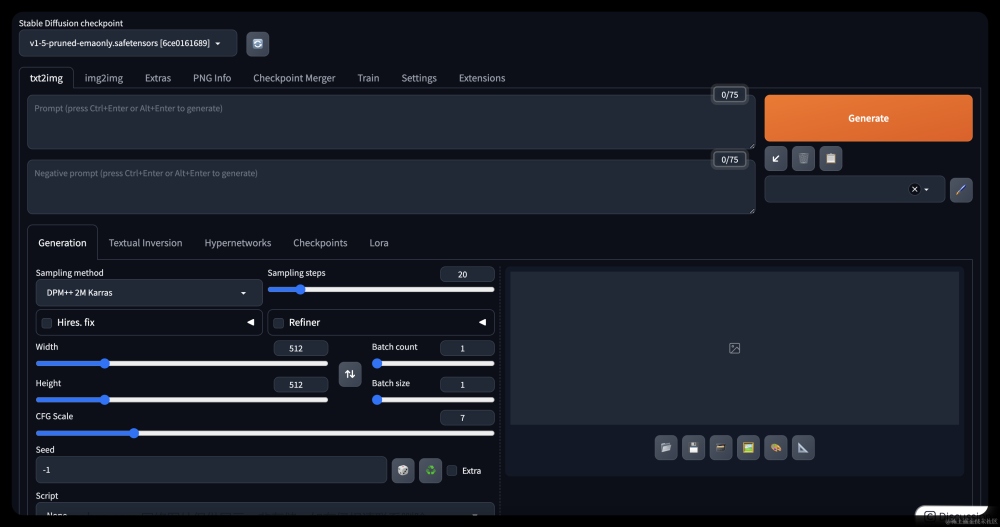

webui提供了插件扩展,方便我们安装tagger插件。

可以看到,tagger插件能直接生成对于训练图片的描述。

安装tagger插件

在安装前,敲黑板!!!这个插件对于webui版本有很强的依赖性,所以需要安装合适的版本,以下教程,全部基于webui v1.6.0-2版本,还没有安装的可以参考我之前的文章,传送门

有三种安装方式。分别是:

- 在linux终端通过git 命令来安装

- 在webui界面,直接输入tagger仓库的URL

- 通过available界面直接选择

这里主要介绍第二种方式。

这里主要介绍第二种方式。

下载tagger仓库

输入https://github.com/toriato/stable-diffusion-webui-wd14-tagger,点击Install就行了。

如果出现以下报错:

在/stable-diffusion-webui/extensions/stable-diffusion-webui-wd14-tagger/tagger/ui.py第10行左右

修改

from webui import wrap_gradio_gpu_call

为

# from webui import wrap_gradio_gpu_call

from modules.call_queue import wrap_gradio_gpu_call

如果出现以下报错:

在/stable-diffusion-webui/extensions/stable-diffusion-webui-wd14-tagger/preload.py文件第4行左右,删掉

from modules.shared import models_path

default_ddp_path = Path(models_path, 'deepdanbooru')

改为

from modules import paths

default_ddp_path = Path(paths.models_path, 'deepdanbooru')

下载wd-v1-4-vit-tagger 模型权重

由于huggingface被墙了,需要手动下载,URL。下载这两项即可:

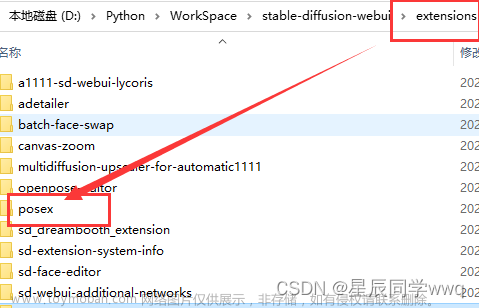

然后新建一个文件夹,将下载好的两个文件放在.cache下。

cd /.cache/huggingface/hub

mkdir models--SmilingWolf--wd-v1-4-vit-tagger-v2

然后修改/stable-diffusion-webui/extensions/stable-diffusion-webui-wd14-tagger/tagger/interrogator.py文件,在229行左右。

model_path = Path(hf_hub_download(

**self.kwargs, filename=self.model_path))

tags_path = Path(hf_hub_download(

**self.kwargs, filename=self.tags_path))

改为下载后两个文件的绝对路径文章来源:https://www.toymoban.com/news/detail-762247.html

model_path = "/.cache/huggingface/hub/models--SmilingWolf--wd-v1-4-vit-tagger-v2/model.onnx"

tags_path = "/.cache/huggingface/hub/models--SmilingWolf--wd-v1-4-vit-tagger-v2/selected_tags.csv"

最后,运行./webui.sh,就可以正常使用tagger插件了!文章来源地址https://www.toymoban.com/news/detail-762247.html

到了这里,关于Stable Diffusion XL webui tagger 插件Linux安装(保姆级教程)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!