1.简介

在3D人体姿态估计中存在遮挡和模糊问题,使用多相机可能会缓解这些困难,因为不同的视角可以补偿这些遮挡并用于相互一致性。目前的3D人体姿态估计中大多数都是单视角的,有一部分是多视角的,但是他们的方法依赖于相机之间的相对位置,这要用到相机的外参。对于相机内参的缺乏,一些方法可以尝试去估计内参,但是估计的值肯定会不准确。

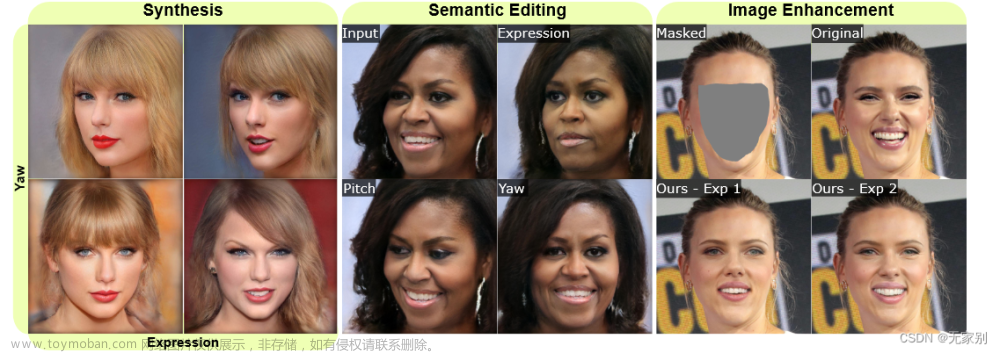

作者的工作引入了一个不需要外部参数的多视角运动重建,此工作建立在一个新的概念之上,使用众所周知的关节旋转和骨长。此工作依赖于一个关键的见解,即对于所有视角而言,关节旋转和骨长是确定的,也就是说,骨架部分的3D角度与相机位置是没有关系的,此时预测的是运动信息,而不是3D关节的位置,这就避免了对相机外参的依赖。如下图:

作者的模型名叫FLEX,是一个端到端的深度卷积网络。输入是多视角的2D关节,可以由2D关节检测器检测而来,也可以是真实的2D关节坐标。

目前3D姿态估计可以分为俩组,一组是直接从图像中回归出3D坐标,第二组是先对图像进行2D姿态估计,然后将得到的2D姿态信息lifting到3D空间。第一种方法受益于直接使用图像,与2D关节位置相比,图像的信息更多,第二组通过使用中间监督获益。在3D姿态估计中,通常是对一段视频进行运动重建,但现在很多工作都是使用一帧信息来预测此帧的3D姿态信息,没有考虑到前后帧之间的联系,而作者的工作使用了时间信息来重建运动。

2.模型

作者工作的baseline是一篇2020年发表在CVPR的论文(MotioNet: 3D Human Motion Reconstruction from Monocular Video with Skeleton Consistency),这是一个使用单视角的3D姿态估计的工作,这篇论文为了让预测的运动更加丝滑,首次在3D姿态估计中引入FK(forward kinematics,前向运动学),下面先介绍这篇MotioNet的网络架构:

2D poses:T帧经过2D姿态估计处理过的2D姿态位置;

Confidence values:用于数据增强,对每个关节的2D位置进行0~360°的偏移,位移距离由置信度值来决定,置信度值的来源是关节的经验分布;

输入:将2D poses经过confidence values数据增强后输入网络之中

EQ:编码器,对输入的2D姿态信息进行处理,预测出T组根位置+关节旋转+脚接触标签,定义两个胯骨之间的关节点为根位置,因为这个关节点被遮挡的概率比较低,而且较易预测出来,由于预测的关节旋转是相对于根位置的旋转,因此需要预测出世界坐标系下根的位置,从而能够重建出世界坐标系下的运动,脚接触标签是为了处理脚步滑动伪影,设定地面位置为T帧图像中脚部位置距离图片底部最低的20%的均值,因为一般都假定人处于图像的中间;

ES:编码器,对输入的2D姿态信息进行处理,只需要预测出一组骨长;

D:鉴别器,判断EQ预测的旋转是否是真实的,由于逆运动学中存在的固有的模糊性,因此产生的旋转和速度可能是不自然的,这可能导致将此旋转信息用到骨架上会导致扭曲。求导操作是因为直接应用于旋转的损失可能不会收敛,而且数据集中不同样本的T-poses未对齐,两个相似的姿势可能由不同的旋转表示(初始位置不同,最终位置相同);

FK:根据旋转信息对T-pose进行旋转操作,下图可以解释FK的过程,其中q表示四元数。

下面讲解FLEX的网络架构

下面只对FLEX对MotioNet有改变的地方做一些介绍,主要是加了FQ和FS两个融合层。

输入有所改变,使用K个视角的视频经过2D姿态估计而来的2D姿态序列;

FQ:多视角卷积层+多头注意力机制,其中多视角卷积层是为了能够感知来自多个视角和多个帧的特征,

FS:仅有多头注意力机制

EQ:此时预测的根位置就要针对不同的视角分别预测出对应视角的根位置及其旋转信息。

3.实验

上图是在数据集Human3.6M下的结果,评测标准为MPJPE(Mean Per Joint Position Error,平均关节位置),可以看出多视图的方法普遍优于单视图的方法。

上图是在数据集Ski-Pose PTZ-Camera数据集下的结果,相机参数均为给出,前两种方法使用的相机参数通过参数估计而给出。

上图是比较平滑度,根据平均加速度来评价,越小越好

消融实验,验证判断注意力的影响, 上图为了验证视角数量的影响和使用

其中TE:Transformer Encoder, 2D姿态检测与使用GT之间的区别

MHA:Multi-head Encoder,

L:堆叠层数,文章来源:https://www.toymoban.com/news/detail-764059.html

h:注意力头的数量文章来源地址https://www.toymoban.com/news/detail-764059.html

到了这里,关于论文阅读笔记《FLEX: Extrinsic Parameters-free Multi-view 3D Human Motion Reconstruction》的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!