1.修改上图extra_model_paths.yaml.example为extra_model_paths.yaml

#Rename this to extra_model_paths.yaml and ComfyUI will load it

#config for a1111 ui

#all you have to do is change the base_path to where yours is installed

a111:

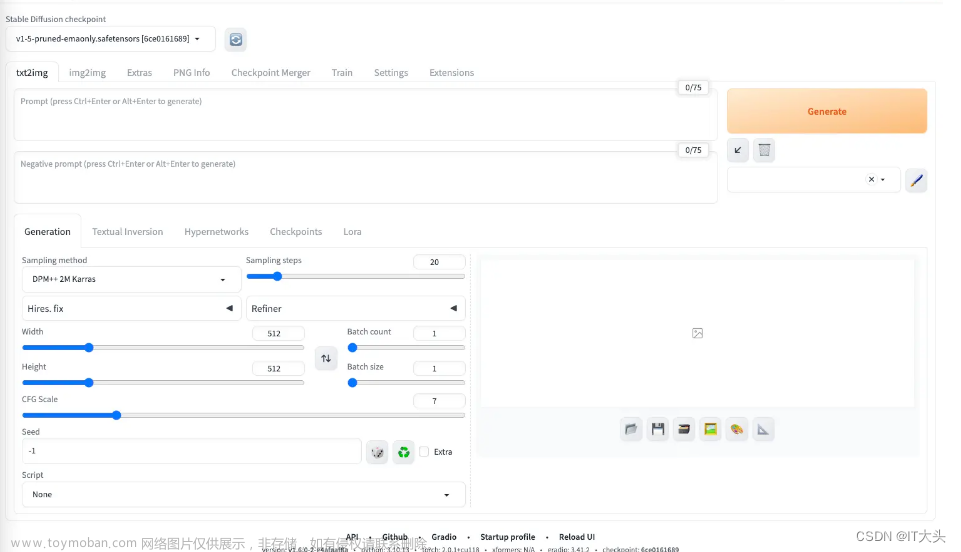

base_path: path/to/stable-diffusion-webui/

checkpoints: models/Stable-diffusion

configs: models/Stable-diffusion

vae: models/VAE

loras: |

models/Lora

models/LyCORIS

upscale_models: |

models/ESRGAN

models/RealESRGAN

models/SwinIR

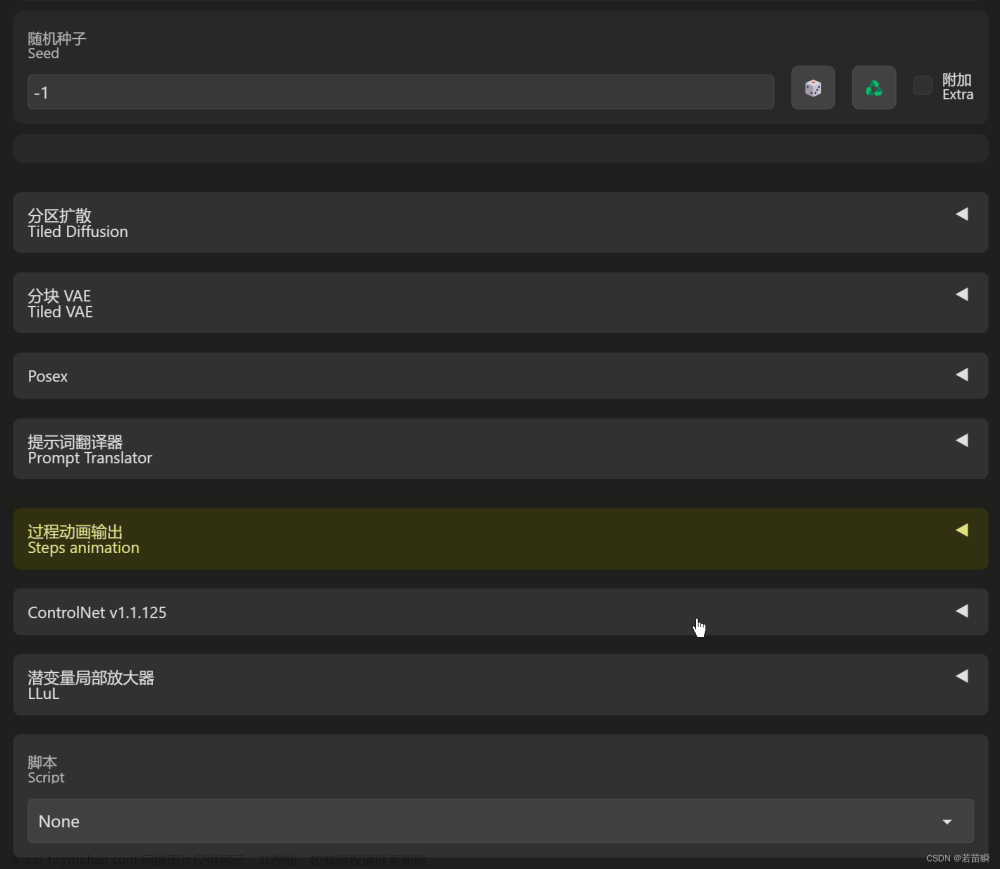

embeddings: embeddings

hypernetworks: models/hypernetworks

controlnet: models/ControlNet

#other_ui:

# base_path: path/to/ui

# checkpoints: models/checkpoints

# gligen: models/gligen

# custom_nodes: path/custom_nodes

2.将base_path: path/to/stable-diffusion-webui/修改成你的/stable-diffusion-webui安装路径(例如:base_p: D:/stable-diffusion-webui)文章来源:https://www.toymoban.com/news/detail-764182.html

做个记录文章来源地址https://www.toymoban.com/news/detail-764182.html

到了这里,关于stable-diffusion的webui和comfyuig共享模型路径的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!