在 Apache Spark 中,DataFrame 的 checkpoint 方法用于强制执行一个物理计划并将结果缓存到分布式文件系统,以防止在计算过程中临时数据丢失。这对于长时间运行的计算过程或复杂的转换操作是有用的。

具体来说,checkpoint 方法执行以下操作:

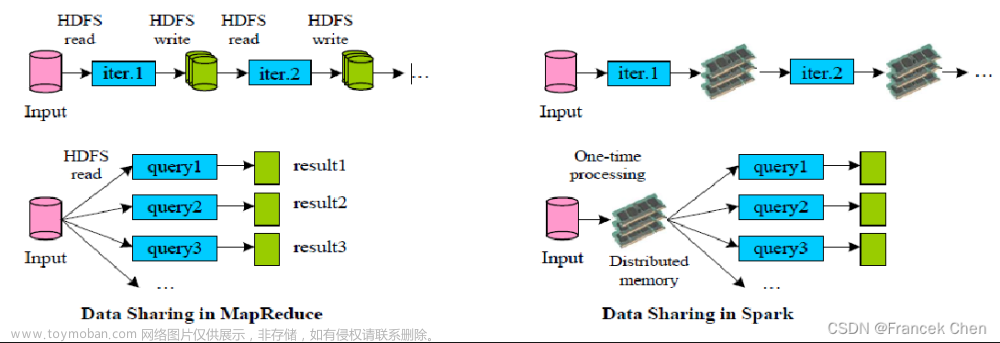

- 将 DataFrame 的物理计划执行,并将结果存储到指定的分布式文件系统(例如 HDFS)上的检查点目录中。

- 用新的 DataFrame 代替原始的 DataFrame,新的 DataFrame 读取检查点目录中的数据,而不是从头开始重新计算。

这个过程的主要优势在于,如果计算过程中断或出现故障,Spark 可以从检查点目录中读取数据,而不是重新计算整个 DataFrame。这有助于提高计算的容错性和效率。

以下是一个简单的示例:

import org.apache.spark.sql.SparkSession

val spark = SparkSession.builder.appName("DataFrameCheckpoint").getOrCreate()

// 假设 df 是你的 DataFrame

val df = spark.read.format("csv").load("your_data.csv")

// 设置检查点目录

val checkpointPath = "hdfs://your_hdfs_path/checkpoint"

// 执行检查点操作

df.checkpoint(checkpointPath)

// 使用检查点后的 DataFrame 进行后续操作

val result = df.filter("some_condition").groupBy("column").agg("agg_column" -> "sum")

result.show()

在上述代码中,df.checkpoint(checkpointPath) 将 DataFrame df 的计算结果存储到指定的检查点目录中。

在之后的代码中,我们可以使用 result 来进行进一步的操作,而 Spark 会尽可能地使用检查点后的数据来加速计算。

需要注意的是

-

检查点目录应该在一个可靠的分布式文件系统中,例如 HDFS。文章来源:https://www.toymoban.com/news/detail-770775.html

-

可能会导致额外的磁盘 I/O文章来源地址https://www.toymoban.com/news/detail-770775.html

到了这里,关于[spark] DataFrame 的 checkpoint的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!