之前章节介绍了Stable Diffusion的入门,介绍了文生图的魅力,可以生成很多漂亮的照片,非常棒

传送门:

Stable Diffusion新手村-我们一起完成AI绘画-CSDN博客

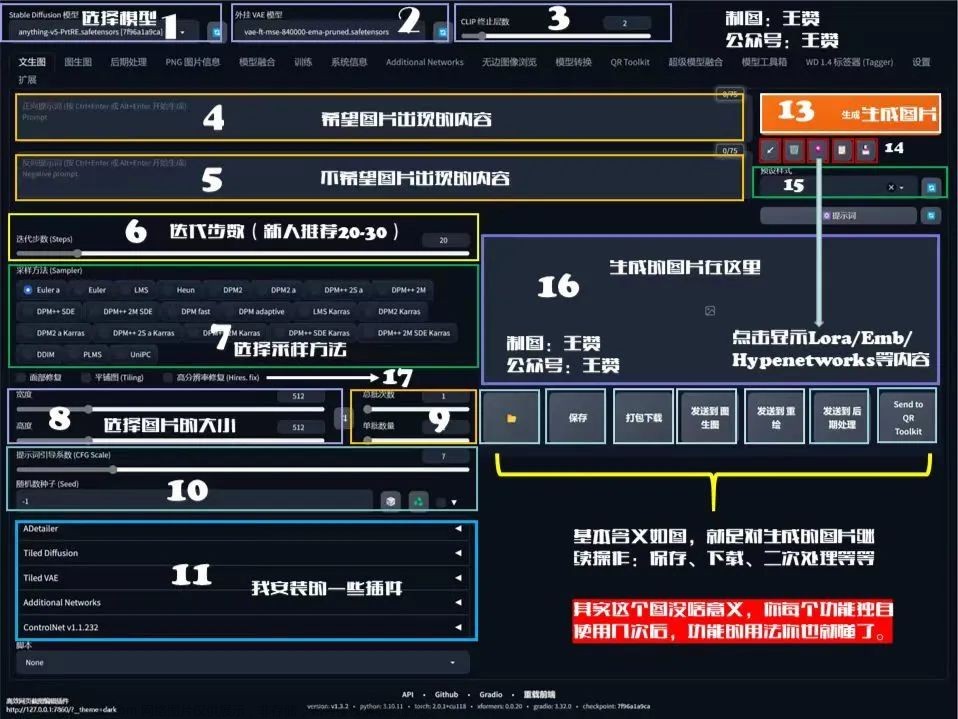

那我们今天就进一步讲讲这个Stable Diffusion还能做些什么,

1.图生图

你是否也和我一样的想法,都已经有图了还生成什么,其实这个场景早就在我们的生活里出现过并火过一段时间了,比如你上传一个图片他帮你生成二次元的场景,感觉非常美哈哈,那今天咱们也看下怎么实现把!

首先标签选择图生图,然后和之前一样,用什么Stable Diffusion模型就选择什么Stable Diffusion模型,然后就是提示词(按照你给的照片描述就会比较像你的场景)以及反向提示词(你不想要什么)。

再往下面走则是我们要上传一个图生图的照片,

我们可以选择尺寸,调整尺寸的时候界面会有一个红色标识,代表你要图生图哪些部分,然后最主要的重绘幅度,一般是0.6-0.7左右最好,太低直接是原图了。

都调整好了,然后直接点击生成,就会生成相似的二次元图片。这是0.75的重绘幅度下的图片。

这是重绘幅度下的0.6的图片

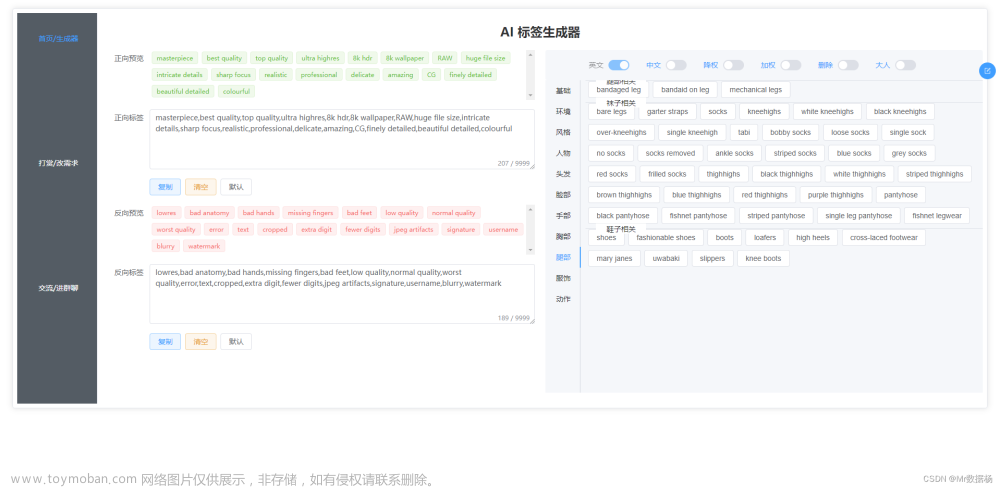

2.WD1.4标签器

如果我们一个个的处理提示词太麻烦,也不一定精确,你看中一个照片的构图你可以下载下来我们可以用WD1.4标签器。

选中WD1.4标签器这个标签以后,我们上传图片,然后什么都不动,等待它把内容生成出来,我们把标签里的内容复制到文生图或者图生图里。是不是具方便呢。

把图片导出图生图里边,然后把提示词复制进来,点击生成完成了。

3.PNG图片信息

你是不是苦恼于网上生成的AI图很好看,然后你发现你复刻不了,因为不知道用的是哪些大模型,也不知道用的是什么提示词,就算知道什么提示词也一点不相像呢?

这时候我们就可以使用PNG图片信息标签了(前提是必须由SD生成的图片信息),

我们上传AI生成的图片,自动就会生成参数,我们用的什么提示词,消极的提示词,以及大模型,迭代的步数,采样器等等等当,让你更轻易的复刻别人的图片。

4.扩展标签器

扩展标签咱们今天说说从网址安装,只需要将git地址放入标红的“扩展的git仓库”,点击安装,这样就轻松安装了工具插件,重启下就会有对应的标签。

比如我安装了图绘pose然后就直接有了

5.ControlNet

ControlNet有特别多的功能,有可以固定肢体动作的,也可以生成线稿的,甚至可以帮助房屋设计,主要目的是固定让画面精准可控,更多更好玩的你可以自己去试试看看。

需要下载对应的ControlNet模型才可以生成对应想要的图片哦,否则只可以预览哦。

迹寒编程给了一些ControlNet基本的都有,可以关注它,公众号为:迹寒编程,回复:controlnet模型

模型链接如下:

百度网盘:https://pan.baidu.com/s/1NMbTs8lQqUqU3WOFe0JMfw?pwd=jhbc 提取码:jhbc

夸克网盘:https://pan.quark.cn/s/4026d5e895f8提取码:BBdB

下载下来的模型放入models\ControlNet,不要放错哦,放完以后就可以直接刷新ControlNet的模型了。

肢体动作的示例,这个是我导入图片然后预览看到生成对应的肢体动作,你也可以编辑肢体动作

线稿示例,也和上面一样,通过图片提取出来线条预览

5.1.ControlNet固定肢体的使用

首先找到ControlNet一栏(滚动条下拉在下面),按照下图标识的步骤做,可以看到了生成对应的姿势。

然后写上提示词,去生成对应的肢体造型的二次元图片

1boy,solo,shirt,male focus,watch,wristwatch,black pants,black hair,blue shirt,looking at viewer,simple background,grey background,hands in pockets,smile,black eyes,closed mouth,standing,short hair,shirt tucked in,Fresh and refined,点击生成生成对应图片,发现按照我们的姿势来做了

5.2.骨架图生成图片

当然我们也可以直接用骨架图生成对应姿态,然后生成对应姿态的人,需要下载对应的插件来自己处理骨骼图,复制链接放入扩展里直接安装(可以看目录4.扩展标签器),地址如下:

GitHub - fkunn1326/openpose-editor: Openpose Editor for AUTOMATIC1111's stable-diffusion-webui

如果你选择用骨架图就可以直接导入一张骨架图然后勾选允许预览,不要选择预处理器,然后就可以直接生成图片了,可以看到下图直接就生成对应的姿势。

当然也可以直接使用OpenPose编辑器,直接调整就可以

调整完可以发文生图或者是图生图里,

简单写下提示语,1个女陔,唐装,全身

Highest quality,ultra-high definition,masterpieces,8k quality,

1girl,chinese_clothes,full body,就会生成对应的姿势图片,还是蛮有意思的。

除了我们自己处理骨骼点以外,我们也可以用在线的处理骨骼点,以及查看别人上传的图片姿势。

https://avatarposemaker.deezein.com/

可以给大家大致看下,左侧这个页面的大致功能,右边就是下载下来左边的骨骼图片,然后放入SD里然后生成图片就可。

6.面部修复Face Editor

当你放大看上面古装生成的照片,你会看到这张图的人脸如此扭曲,这个根据经验来说,基本生成全身照或全景都是这样的,人脸都会崩坍,

此时我们需要用插件面部修复Face Editor插件。

下载网址:https://github.com/ototadana/sd-face-editor.git

在扩展中安装此插件就行,上面(目录4.扩展标签器)

进度条拉到最底部, 选择启用Face Editor,其余的我都是默认的,然后直接生成图片看下效果,如果不尽人意你可以进行其他的调整。

修复完以后就是倾国倾城的大美女啦!哈哈

当然面部修复除了有Face Editor还有After Detailer,这个很多人感觉效果会更好一点,大家也可以用After Detailer去试一下。文章来源:https://www.toymoban.com/news/detail-771915.html

今天要聊的就那么多,下次见!文章来源地址https://www.toymoban.com/news/detail-771915.html

到了这里,关于Stable Diffusion进阶玩法说明的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!