一、运行模式

Hadoop 运行模式包括:本地模式、伪分布式模式以及完全分布式模式。

- 本地模式(Local/Standalone Mode):单台服务器,数据存储在Linux本地。生产环境几乎不会采用该模式

- 伪分布式模式(Pseudo-Distributed Mode):单台服务器,数据存储在HDFS上。有较少的小型公司采用该模式。

- 完全分布式模式(Fully-Distributed Mode):多台服务器组成集群,数据存储在HDFS上,多台服务器工作。在企业中大量使用。

二、本地运行模式

(1)在 hadoop-3.3.6 文件下面创建一个 wcinput 文件夹

mkdir wcinput

(2)在 wcinput 文件下创建一个 word.txt 文件

cd wcinput

(3)编辑 word.txt 文件

vim word.txt

在文件中输入如下内容

a d

a c

b

b

保存退出::wq

(4)回到 Hadoop 目录/opt/module/hadoop-3.3.6

(5)执行程序

hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.3.6.jar wordcount wcinput wcoutput

(6)查看结果

cat wcoutput/part-r-00000

看到如下结果:

a 2

b 2

c 1

d 1

三、完全分布式运行模式

主要步骤:

- 准备三台服务器 hadoop102、hadoop103、hadoop104,关闭防火墙、设置静态IP、配置主机名称和主机映射。

- 安装JDK、Hadoop,配置环境变量

- 配置集群

- 单点启动

- 配置ssh

- 群起并测试集群

1. 编写集群分发脚本xsync

1.1 scp安全拷贝

scp 可以实现服务器与服务器之间的数据拷贝。(from server1 to server2)

(1) 基本语法scp [选项] 要拷贝的文件路径/名称 目的地用户@主机:目的地路径/名称

(2) 说明

| 选项 | 说明 |

|---|---|

| -r | 递归复制文件和目录 |

| -p | 在复制时保留文件的权限、模式和访问时间 |

| -P | 目标主机SSH端口号 |

| -I | 复制时限制带宽 |

| -i | 身份文件或私钥 |

| -C | 启用压缩 |

(3) 案例实操

使用scp将安装包进行分发,因为在 hadoop102上已经搭建好了 jdk、hadoop,所以可以直接复制到其他服务器上:

# 在 hadoop102 上,将 hadoop102 中/opt/module/jdk1.8.0_212 目录拷贝到hadoop103 上

scp -r /opt/module/jdk1.8.0_212 huahua@hadoop103:/opt/module

# 在 hadoop103 上,将 hadoop102 中/opt/module/hadoop-3.1.3 目录拷贝到hadoop103 上

scp -r huahua@hadoop102:/opt/module/hadoop-3.1.3 /opt/module/

# 在 hadoop103 上操作,将 hadoop102 中/opt/module 目录下所有目录拷贝到hadoop104 上

scp -r huahua@hadoop102:/opt/module/* huahua@hadoop104:/opt/module

1.2 rsync远程同步工具

rsync 主要用于备份和镜像。具有速度快、避免复制相同内容和支持符号链接的优点。

rsync 和 scp 区别:

用 rsync 做文件的复制要比 scp 的速度快,rsync 只对差异文件做更新,scp 是把所有文件都复制过去。

(1) 基本语法rsync [选项] 要拷贝的文件路径/名称 目的地用户@主机:目的地路径/名称

(2)说明

| 选项 | 功能 |

|---|---|

| -a | 归档拷贝 |

| -v | 显示复制过程 |

| –delete | 当目的路径文件或文件夹比源路径多(源路径删除了文件),删除目的路径的文件 |

(3)案例实操

# 同步 hadoop102 中的/opt/module/hadoop-3.1.3 到 hadoop103

rsync -av hadoop-3.1.3/ huahua@hadoop103:/opt/module/hadoop-3.1.3/

1.3 xsync集群分发脚本

需求:循环复制文件到所有节点的相同目录下

期望脚本:xsync 要同步的文件名称

期望脚本在任何路径都能使用(脚本放在声明了全局环境变量的路径)

# 查看声明全局变量的路径

echo $PATH

/usr/local/bin:/usr/bin:/usr/local/sbin:/usr/sbin:/home/huahua/.local/bin:/home/huahua/bin:/opt/module/jdk1.8.0_212/bin

可以编写一个shell脚本调用 rsync 命令,将文件同步到所有节点的相同目录下。在/home/huahua创建bin目录,并将/home/huahua/bin加入环境变量。

在/home/huahua/bin中新建一个shell脚本文件 xsync,内容如下:

#!/bin/bash

# 1. 判断参数个数

if [ $# -lt 1 ]

then

echo Not Enough Argument

exit

fi

# 2. 遍历集群所有机器

for host in hadoop102 hadoop103 hadoop104

do

echo ================== $host =====================

# 3. 遍历所有目录,逐个发送

for file in $@

do

# 4. 判断文件是否存在

if [ -e $file ]

then

# 5. 获取父目录

# -P 如果cd后面是一个软链接,-P可以进入软链接指向的真正文件夹

pdir=$(cd -P $(dirname $file); pwd)

# 6. 获取当前文件名称

fname=$(basename $file)

# -p 如果存在则不创建,如果不存在则创建

ssh $host "mkdir -p $pdir"

rsync -av $pdir/$fname $host:$pdir

else

echo $file does not exists!

fi

done

done

执行时,只需:xsync 文件或文件夹1 文件或文件夹2.....执行即可。

# 将/home/tengyer/bin文件夹同步到其他几台服务器

cd /home/huahua

xsync bin/

如果要同步的文件是root权限,比如环境变量配置文件/etc/profile.d/my_env.sh,可以使用sudo进行同步

# 使用sudo时,因为xsync不在root的命令列表,所以需要使用./进行调用

sudo ./bin/xsync /etc/profile.d/my_env.sh

脚本中使用了 ssh 命令和 rsync命令去连接其他服务器,所以每台服务器都要输入两次密码,比较繁琐,可以配置ssh免密登录。

2. SSH免密登录

免密登录原理

如果当前服务器使用ssh命令连接过其他服务器,那么在该用户家目录下就会生成一个 .ssh文件夹,里面存有一个

known_hosts文件,文件中保存的有该用户曾经使用ssh命令远程连接过的服务器。

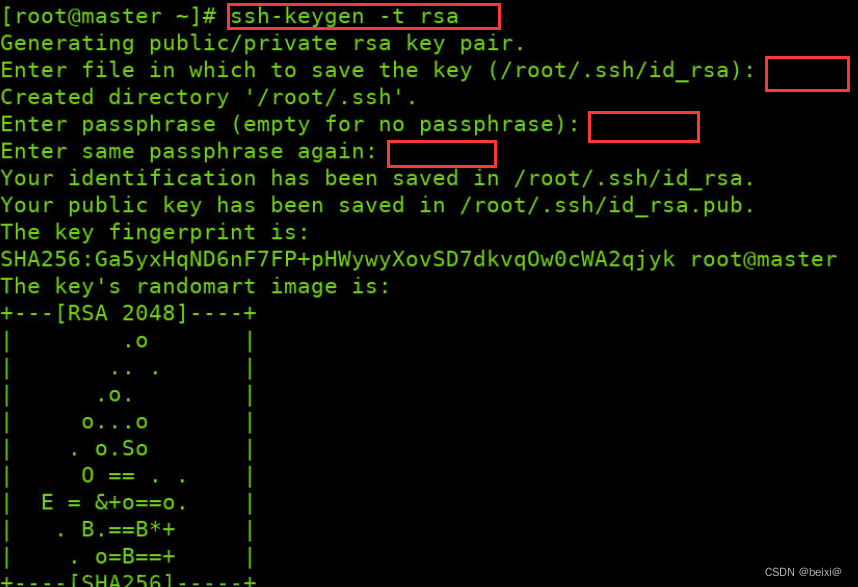

配置hadoop102免密登录hadoop103、hadoop104:

(1) 在hadoop102上创建一个SSH的RSA密钥对:

# 选择非对称加密算法为rsa算法

ssh-keygen -t rsa

# 然后一路回车即可

命令执行后,会在用户家目录下的 .ssh文件夹中生成一个公钥文件

id_rsa.pub、一个私钥文件id_rsa

(2) 将hadoop102上的公钥id_rsa.pub拷贝到hadoop103、hadoop104:

# 将hadoop102的公钥拷贝给hadoop103

# 命令执行后,需要输入hadoop103的密码

# 之后hadoop102再用ssh访问hadoop103时便不再需要输入密码

ssh-copy-id hadoop103

# 配置免密登录 hadoop104

ssh-copy-id hadoop103

(3) 另外,还需要对自己设置免密登录,否则 hadoop102 使用 ssh 连接 hadoop102 本身时也需要密码:

ssh-copy-id hadoop102

进行免密之后,在 hadoop103、hadoop104的 .ssh 文件夹中会多一个

authorized_keys文件,里面记录了允许哪些客户机免密登录自己。authorized_keys文件中的内容其实就是 hadoop102的公钥文件id_rsa.pub中的内容。

(4) 然后在 hadoop103、 hadoop104上也执行上述同样的操作,使集群中的几台服务器可以互相免密登录。

.ssh 文件夹下(~/.ssh)的文件功能解释

| 文件 | 功能 |

|---|---|

| known_hosts | 记录 ssh 访问过计算机的公钥(public key) |

| id_rsa | 生成的私钥 |

| id_rsa.pub | 生成的公钥 |

| authorized_keys | 存放授权过的无密登录服务器公钥 |

3. 集群配置

3.1 服务器规划

注意事项:

- NameNode 和 SecondaryNameNode 不要安装到同一台服务器上

- ResourceManager 也很消耗内存,不要和 NameNode、SecondaryNameNode配置在同一台机器上

Hadoop集群 = HDFS集群 + Yarn集群

- Yarn集群和HDFS集群:逻辑上分离、物理上在一起。

- 逻辑上,Yarn集群的启动和HDFS集群的启动并没有直接的依赖关系。

- 物理上,Yarn集群、HDFS集群,都是在同一个安装了Hadoop的集群内。

- MapReduce是计算框架,是代码层面的组件,没有集群之说。

对三台服务器进行如下规划:

3.2 配置文件配置

Hadoop 配置文件分两类:默认配置文件和自定义配置文件,只有用户想修改某一默认配置值时,才需要修改自定义配置文件,更改相应属性值。

默认配置文件:

| 要获取的默认文件 | 文件存放在 Hadoop 的 jar 包中的位置 |

|---|---|

| [core-default.xml] | hadoop-common-3.1.3.jar/core-default.xml |

| [hdfs-default.xml] | hadoop-hdfs-3.1.3.jar/hdfs-default.xml |

| [yarn-default.xml] | hadoop-yarn-common-3.1.3.jar/yarn-default.xml |

| [mapred-default.xml] | hadoop-mapreduce-client-core-3.1.3.jar/mapred-default.xml |

自定义配置文件:core-site.xml、hdfs-site.xml、yarn-site.xml、mapred-site.xml、workers五个配置文件存放在$HADOOP_HOME/etc/hadoop 这个路径上,用户可以根据项目需求重新进行修改配置。

(1) 配置核心配置文件 core-site.xmlcd $HADOOP_HOME/etc/hadoop进入hadoop目录,vim core-site.xml进入文件

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- 在configuration中添加以下配置信息 -->

<!-- 指定NameNode的地址 -->

<!-- core-defualt.xml中该项默认值为本地Linux路径,因为我们集群要用HDFS,所以要改成HDFS路径 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop102:8020</value>

</property>

<!-- 指定hadoop数据的存储目录 -->

<!-- core-default.xml中该项默认值为 /tmp/hadoop-${user.name},因为 /tmp在Linux中是临时目录,一段时间(默认一个月)会删除,所以要调整为自定义目录 -->

<!-- 我们指定的data文件夹如果不存在,hadoop会自动进行创建 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/module/hadoop-3.3.6/data</value>

</property>

<!-- 配置HDFS网页登录使用的静态用户为tengyer(即hdfs中的用户) -->

<!-- 如果不配置,那么在浏览器中默认的是Mr.who,该用户删除hdfs文件时,会提示无权限。-->

<property>

<name>hadoop.http.staticuser.user</name>

<value>tengyer</value>

</property>

</configuration>

(2) 配置HDFS的hdfs-site.xmlvim hdfs-site.xml 进入文件

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- 在configuration中添加以下配置 -->

<!-- NameNode对外暴露的Web端访问地址 -->

<property>

<name>dfs.namenode.http-address</name>

<value>hadoop102:9870</value>

</property>

<!-- 2NN 对外暴露的Web端访问地址(2NN安装在hadoop104上) -->

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop104:9868</value>

</property>

</configuration>

(3) 配置Yarn的yarn-site.xmlvim yarn-site.xml 进入文件

<?xml version="1.0"?>

<configuration>

<!-- 在configuration中添加以下配置 -->

<!-- 指定MR走shuffle -->

<!-- 在yarn-default.xml中该项默认值为空,但是官方推荐使用mapreduce_shuffle -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 指定ResourceManager的地址(ResourceManager安装在hadoop103) -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop103</value>

</property>

<!-- 环境变量的继承 -->

<!-- Hadoop3.1.x需要配置,因为yarn-default.xml中该项默认值缺少了HADOOP_MAPRED_HOME -->

<!-- 到了Hadoop3.2.x就不需要再配置该项了,可以直接使用yarn-default.xml中的默认值 -->

<property>

<name>yarn.nodemanager.env-whitelist</name>

<value>JAVA_HOME,HADOOP_COMMON_HOME,HADOOP_HDFS_HOME,HADOOP_CONF_DIR,CLASSPATH_PREPEND_DISTCACHE,HADOOP_YARN_HOME,HADOOP_MAPRED_HOME</value>

</property>

</configuration>

(4) 配置MapReduce的mapred-site.xmlvim mapred-site.xml 进入文件

<?xml version="1.0"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- 在configuration中添加以下配置 -->

<!-- 指定MapReduce程序运行在Yarn上 -->

<!-- mapred-default.xml中该项默认值是local,即在本地运行 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

(5) 配置完成后,将hadoop102的这些配置同步分发给hadoop103、hadoop104cd /opt/module/hadoop-3.3.6/etc

# 使用我们编写的同步分发脚本进行分发

xsync hadoop/

4.群起集群

4.1 配置workers

workers内容即为集群中的各台主机,默认的是localhost。因为我们使用集群方式,所以可以删掉localhost,然后把几台主机都配置进来。

需要在$HADOOP_HOME/etc/hadoop/workers中将几台节点都添加进去(该文件将来会作为hadoop集群启动的脚本一部分,所以主机名后面不能有空格、结尾也不能有空行)

hadoop102

hadoop103

hadoop104

将works文件分发给其他服务器

xsync works

4.2 启动集群

(1)NameNode初始化

根据集群规划,我们的NameNode节点为hadoop102。

如果是第一次启动集群,需要进行初始化操作,在hadoop102节点上格式化NameNode。(类似于电脑新加了一个硬盘,需要给硬盘进行分盘符等初始化操作)

cd $HADOOP_HOME

hdfs namenode -format

# 初始化完毕后,会在 $HADOOP_HOME 文件夹中生成 data和logs两个文件夹

注意:格式化 NameNode,会产生新的集群 id,导致 NameNode 和 DataNode 的集群 id不一致,集群找不到以往数据。如果集群在运行过程中报错,需要重新格式化 NameNode 的话,一定要先停止 namenode 和 datanode 进程,并且要删除所有机器的 data 和 logs 目录,然后再进行格式化。

(2)启动HDFS

# 在hadoop102服务器上启动集群

sbin/start-dfs.sh

启动完毕后,在三台服务器上依次使用jps查看其上面运行的 hdfs 的java进程和集群规划的是否一致。正常情况下,应该为以下形式:

- hadoop102上:jps本身、DataNode、NameNode

- hadoop103上:jps本身、DataNode

- hadoop104上:jps本身、DataNode、SecondaryNameNode

可以使用浏览器访问NameNode,查看HDFS中的存储数据信息:http://hadoop102:9870

(3)启动YARN

根据集群规划,我们的ResourceManager节点为 hadoop103

# 在hadoop103上启动YARN

sbin/start-yarn.sh

启动完毕后,在三台服务器上依次使用jps查看其上面运行的 hdfs、yarn 的java进程和集群规划的是否一致。正常情况下,应该为以下形式:

- hadoop102上:jps本身、DataNode、NameNode、NodeManager

- hadoop103上:jps本身、DataNode、NodeManager、ResourceManager

- hadoop104上:jps本身、DataNode、SecondaryNameNode、NodeManager

可以在浏览器查看Yarn的ResourceManager,查看yarn上运行的job信息:http://hadoop103:8088

4.3 测试集群运行情况

(1)测试上传文件到集群

# 在hdfs创建一个目录

hadoop fs -mkdir /wcinput

# 上传小文件

hadoop fs -put $HADOOP_HOME/wcinput/word.txt /input

# 上传大文件

hadoop fs -put /opt/software/jdk-8u381-linux-x64.tar.gz /

上传之后便可以在NameNode的web页面中进行查看下载,也可以使用命令进行查看和下载

hadoop fs -ls /wcinput

hadoop fs -get /wcinput/aa.txt aa.txt

上传的文件保存在我们在core-site.xml中配置的

/opt/module/hadoop-3.3.6/data目录。

因为hadoop上传的文件默认会存储3份进行备份,所以三台服务器上都会保存有刚刚上传的文件,位于:/opt/module/hadoop-3.3.6/data/dfs/data/current/BP-xxxxxxxx/current/finalized/subdir0/subdir0文件夹中。

(2)测试Yarn执行wordcount示例程序

在hadoop102上执行Hadoop的wordcount示例程序:

# 统计我们上传导hdfs的 /wcinput/aa.txt中的单词出现次数

# 因为我们的core-site.xml中配置的fs.defaultFS不再是local,而是hdfs地址了,所以文件输入路径、结果输出路径应该为hdfs上的路径

hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.3.6.jar wordcount /wcinput /wcoutput

通过yarn的web管理页面查看运行的job,可以发现多出来一个正在运行的wordcount任务。

执行完毕后,可以在hdfs上查看到输出的结果/wcoutput/part-r-00000。

执行完毕后,yarn管理页面上的job状态也变为FINISHED。

但是因为我们没有配置历史记录服务器,所以该job后面的History点击出现404。如果没有历史记录服务器,那么yarn无法记录历史job,当前页面展示的 job 信息过段时间就会被清除。

4.4 集群崩溃时的处理

集群中如果有服务器 DataNode服务被kill或异常终止了,或者节点的data文件夹被删除了(只删除一两台节点不影响集群,因为hdfs有3个备份,所以需要三台服务器的data都被删掉),此时集群便属于崩溃状态。

如果需要重新格式化NameNode,则可以进行以下操作:

(1) 在hadoop103上关闭集群Yarn

sbin/stop-yarn.sh

(2) 在hadoop102上关掉集群hdfs

sbin/stop-dfs.sh

(3) 删除所有节点上的 data、logs文件夹

(4) 重新进行NameNode格式化

hdfs namenode -format

5. 配置历史服务器

为了查看程序的历史运行情况,需要配置历史服务器。

在 hadoop102节点上,修改 mapred-site.xml:

<!-- 在configuration标签中加入如下配置 -->

<!-- 配置历史服务器的内部服务端地址 -->

<property>

<name>mapreduce.jobhistory.address</name>

<value>hadoop102:10020</value>

</property>

<!-- 配置历史服务器暴露的web地址 -->

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>hadoop102:19888</value>

</property>

将配置信息复制分发到其他服务器:

xsync mapred-site.xml

在hadoop103节点上重启 Yarn:

sbin/stop-yarn.sh

sbin/start-yarn.sh

因为我们配置了hadoop102为历史服务器,所以需要在hadoop102上启动历史服务器进程:

mapred --daemon start historyserver

启动之后,使用 jps查看java进程,可以发现多出来了一个 JobHistoryServer 进程。

可以在浏览器查看我们的历史服务器信息:http://hadoop102:19888

6. 配置日志的聚集

日志聚集概念:应用运行完成以后,将程序运行日志信息上传到 HDFS 系统上。

日志聚集功能好处:可以方便的查看到程序运行详情,方便开发调试。

注意:开启日志聚集功能,需要重新启动 NodeManager 、ResourceManager 和 HistoryServer。

(1)配置 yarn-site.xml

在hadoop102节点的 yarn-site.xml 中加入配置:

<!-- 在configuration中加入以下配置 -->

<!-- 配置日志聚集功能,yarn-default.xml中该项默认为false -->

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 设置日志聚集服务器地址,设置聚集到历史日志服务器上,方便查看 -->

<property>

<name>yarn.log.server.url</name>

<value>http://hadoop102:19888/jobhistory/logs</value>

</property>

<!-- 设置日志保留时间:7天 -->

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

(2)分发给其他服务器

xsync yarn-site.xml

(3)重启HistroyServer、Yarn(ResourceManager、NodeManager)

# 在hadoop102上停止历史服务器

mapred --daemon stop historyserver

# 在hadoop103上重启Yarn

sbin/stop-yarn.sh

sbin/start-yarn.sh

# 在hadoop102上启动历史服务器

mapred --daemon start historyserver

# 测试:可以删除hdfs上的/wcoutput结果文件夹,然后重新执行wordcount任务

hadoop fs -rm -f -r /wcoutput

hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.3.6.jar wordcount /wcinput /wcoutput

到 http://hadoop102:19888/ 查看历史任务时,点击logs链接便可以正常查看历史任务日志

7. 集群的启停方式

整体启动、停止 HDFS:

# 启动hdfs集群

sbin/start-dfs.sh

# 停止hdfs集群

sbin/stop-dfs.sh

整体启动、停止 YARN:

# 启动YARN集群

sbin/start-yarn.sh

# 停止YARN集群

sbin/stop-yarn.sh

分别启动、停止 HDFS 组件(例如某台DataNode宕机了,需要只将该服务器的DataNode重新启动,无需整个集群重启):

hdfs --daemon start/stop namenode/datanode/secondarynamenode

启动、停止YARN组件:

yarn --daemon start/stop resourcemanager/nodemanager

8. 编写Hadoop集群常用脚本

编写脚本集中启动、停止vim myhadoop.sh

#!/bin/bash

if [ $# -lt 1 ]

then

echo "No args Input..."

exit;

fi

case $1 in

"start")

echo "============= 启动hadoop集群 ======================"

echo "------------- 启动 hdfs ---------------------------"

ssh hadoop102 "/opt/module/hadoop-3.3.6/sbin/start-dfs.sh"

echo "------------- 启动 yarn ---------------------------"

ssh hadoop103 "/opt/module/hadoop-3.3.6/sbin/start-yarn.sh"

echo "---------- 启动 historyserver ----------------------"

ssh hadoop102 "/opt/module/hadoop-3.3.6/bin/mapred --daemon start historyserver"

;;

"stop")

echo "================ 关闭hadoop集群 =========================="

echo "-------------- 关闭historyserver ------------------------"

ssh hadoop102 "/opt/module/hadoop-3.3.6/bin/mapred --daemon stop historyserver"

echo "---------------- 关闭 yarn ------------------------------"

ssh hadoop103 "/opt/module/hadoop-3.3.6/sbin/stop-yarn.sh"

echo "---------------- 关闭 hdfs ------------------------------"

ssh hadoop102 "/opt/module/hadoop-3.3.6/sbin/stop-dfs.sh"

;;

*)

echo "Input Args Error..."

;;

esac

保存后退出,然后赋予脚本执行权限

chmod +x myhadoop.sh

使用脚本进行集群整体的启停:

# 停止整个historyserver、yarn、hdfs集群

myhadoop.sh stop

# 启动整个hdfs、yarn、historyserver集群

myhadoop.sh start

编写脚本,遍历集群中每台服务器调用jps查看上面的java进程启动情况:jpsall

#!/bin/bash

for host in hadoop102 hadoop103 hadoop104

do

echo ================= $host =================

ssh $host jps

done

执行脚本查看集群所有服务器的java进程情况:文章来源:https://www.toymoban.com/news/detail-775611.html

jpsall

将hadoop102上编写好的这两个脚本分发给其他服务器:文章来源地址https://www.toymoban.com/news/detail-775611.html

xsync jpsall myhadoop.sh

9. hadoop常用端口号

| 端口名称 | Hadoop2.x | Hadoop3.x |

|---|---|---|

| NameNode 内部通信端口 | 8020 / 9000 | 8020 / 9000/9820 |

| NameNode HTTP UI | 50070 | 9870 |

| MapReduce 查看执行任务端口 | 8088 | 8088 |

| 历史服务器通信端口 | 19888 | 19888 |

到了这里,关于【大数据】Hadoop运行模式(集群搭建)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!