1.背景介绍

人工智能(Artificial Intelligence, AI)是一种能够自主地进行问题解决、学习和改进的计算机技术。随着人工智能技术的不断发展和进步,人类在各个领域的生产力得到了显著提高,但同时也引发了一系列道德和安全问题。在这篇文章中,我们将探讨人工智能道德与安全问题,以及如何在技术发展中保护人类利益。

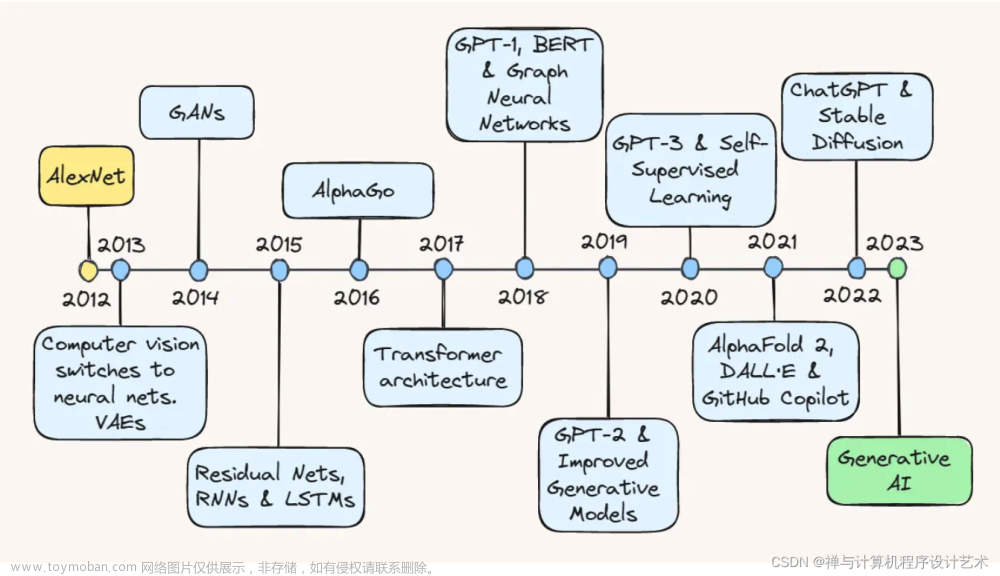

人工智能技术的发展历程可以分为以下几个阶段:

-

早期人工智能(1950年代至1970年代):这一阶段的研究主要关注如何让计算机模拟人类的思维过程,以及如何让计算机能够理解和处理自然语言。

-

知识工程(1980年代至1990年代):这一阶段的研究重点关注如何通过人工构建知识库来帮助计算机进行问题解决。

-

深度学习和机器学习(2000年代至现在):这一阶段的研究主要关注如何通过大量数据和计算资源来训练计算机模型,使其能够自主地学习和进化。

随着人工智能技术的不断发展,我们已经看到了许多令人印象深刻的成果,如自动驾驶汽车、语音助手、图像识别等。然而,这些成果也引发了一系列道德和安全问题,如隐私保护、数据安全、职业替代等。在接下来的部分中,我们将详细讨论这些问题以及如何在技术发展中保护人类利益。

2.核心概念与联系

在探讨人工智能道德与安全问题之前,我们需要了解一些核心概念。

-

人工智能(Artificial Intelligence, AI):人工智能是一种能够自主地进行问题解决、学习和改进的计算机技术。文章来源:https://www.toymoban.com/news/detail-783834.html

机器学习(Machine Learning, ML文章来源地址https://www.toymoban.com/news/detail-783834.html

到了这里,关于人工智能道德与安全:如何在技术发展中保护人类利益的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!