@article{li2024crossfuse,

title={CrossFuse: A novel cross attention mechanism based infrared and visible image fusion approach},

author={Li, Hui and Wu, Xiao-Jun},

journal={Information Fusion},

volume={103},

pages={102147},

year={2024},

publisher={Elsevier}

}

论文级别:SCI A1

影响因子:18.6

📖[论文下载地址]

💽[代码下载地址]

📖论文解读

以往的交叉注意力只考虑相关性,而图像融合任务需要关注互补信息。

为了解决这个问题,作者提出了CrossFuse,使用【交叉注意力机制CAM】增强互补信息,使用了两阶段训练策略。

第一阶段为两种模态训练结构相同的自编码器

第二阶段固定编码器参数,训练CAM和解码器

🔑关键词

Image fusion 图像融合

Transformer

Cross attention 交叉注意力

Infrared image 红外图像

Visible image 可见光图像

💭核心思想

通过【交叉注意力机制CAM】增强互补信息,降低冗余特征的负面影响。

扩展学习

[什么是图像融合?(一看就通,通俗易懂)]

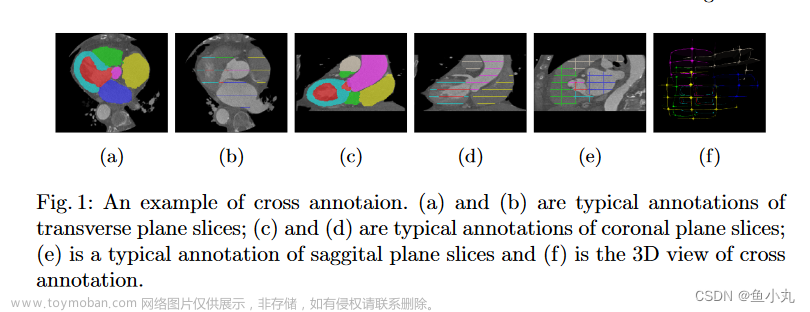

从下图中我们可以看到,相同场景的不同模态图像,有高相关性区域和高度不相关性区域。

🪅相关背景知识

🪢网络结构

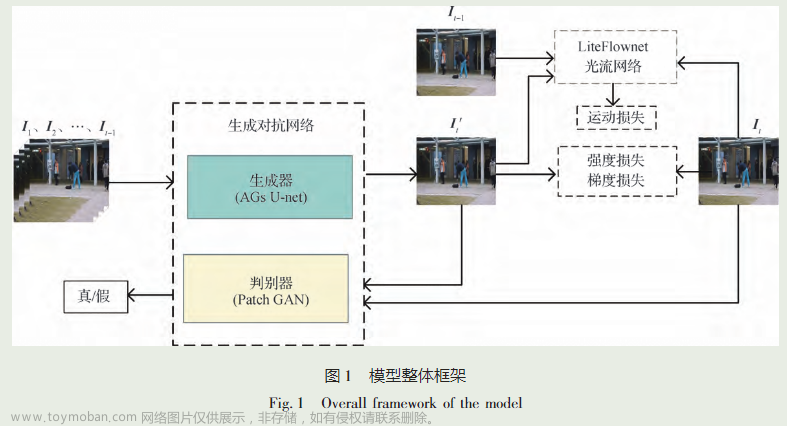

作者提出的网络结构如下所示。

I

i

r

I_{ir}

Iir和

I

v

i

I_{vi}

Ivi分别代表红外图像和可见光图像,两个编码器提取多模态信息。

基于Transformer的CAM结构用来融合多模态特征

解码器用来产生融合图像

F

F

F

在编码器和解码器之间有两个skip connection,用来保留源图的更多深/浅层特征

为什么使用两个编码器呢?因为作者认为两个模态间信息差距较大,这两个编码器结构是相同的,但是网络内部参数却有所区别。

下面我们一起来看看编码器的详细结构

🪢编码器

第一个卷积层用来提取浅层特征(保留了丰富的纹理信息),然后经过最大池化,DenseBlock保留多尺度特征中更多有用信息,随着编码器层数越来越深,深层特征开始集中在显著目标上。

为了增强细节信息和显著特征,在编码器和解码器之间加入了两个跳接。就是上图两个蓝紫色箭头,一个在Conv上,还有一个在最后一个最大池化层上。

🪢CAM

Cross-attention mechanism,交叉注意力机制。其结构如下图所示。

两个分支的参数是不相同的,每个模态的特征首先经过自注意力机制SA以增强内部特征,然后经过shift操作(在水平和垂直方向移动特征位置),然后再经过SA,然后unshift恢复位置,经过交叉注意力机制CA得到融合特征。

🪢SA

x

c

x^c

xc是SA的输入,也就下图(图4)左边的长条立方体,编码器的输出。

Q

c

K

c

V

c

Q_cK_cV_c

QcKcVc是输入的不同表示,涉及Transformer里的知识,不了解的同学可以参考下面的链接。

U

q

k

v

U_{qkv}

Uqkv是可以通过全连接层学习参数的变换矩阵

d

d

d是输入向量的维度

n

o

r

m

norm

norm表示线性范数运算

M

L

P

(

⋅

)

MLP(·)

MLP(⋅)是多层感知机

扩展学习

史上最小白之Transformer详解

🪢CA

在2式总,

c

c

c和

c

^

\hat c

c^代表不同模态。

这个地方的交叉计算,和SwinFusion有点像,感兴趣的读者可以移步去看我的另外一篇阅读笔记。

扩展学习

SwinFusion阅读笔记

SA和CA最大的区别在于矩阵乘法后的激活函数,即CA用到了反向softmax。

作者给出这个地方的解释是,对于不同的模态,应该增强互补(不相关)信息而不是冗余(相关)特征。

在经过CAM之后,得到了一个融合特征,接下来我们需要将这个融合特征解码为融合图像。

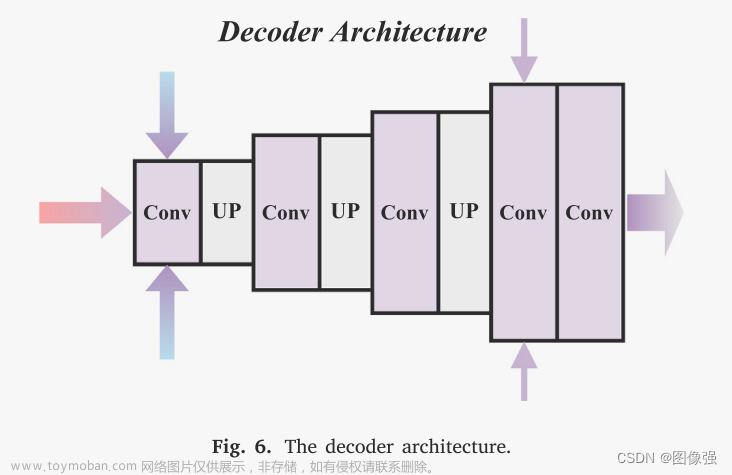

🪢解码器

解码器的结构如下图所示。

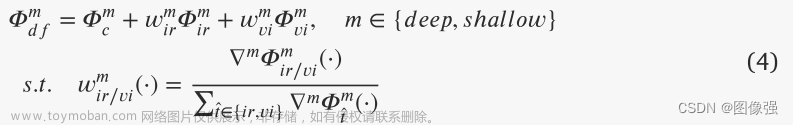

除了在编码器中刚提到两个skip connection以外,作者还加入了【特征强度感知策略】(the feature intensity aware strategy)用来进行【多级特征融合】,其公式如下:

(

⋅

)

(·)

(⋅)表示深层特征中的位置

Φ

c

m

\Phi^m_c

Φcm代表了CAM提取的特征,

Φ

i

r

m

\Phi^m_{ir}

Φirm和

Φ

v

i

m

\Phi^m_{vi}

Φvim分别代表了红外图像和可见光图像的特征。

∇

m

∇^m

∇m分别表示浅层特征和深层特征的细节和基础信息提取器。其计算公式为:

🎢训练设置

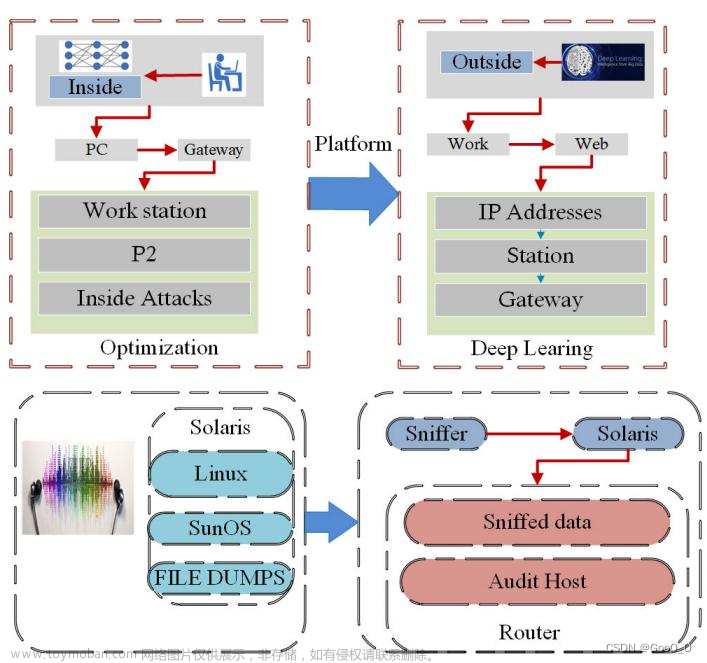

本文采用了两阶段训练。

一阶段:编码器训练。为每种模态构建自编码器网络用于重建输入。

二阶段:针对不同的编码器, 训练CAM和解码器。

🎢一阶段

一阶段训练的损失函数用到了像素损失和结构损失:

系数为1e4

🎢二阶段

二阶段训练的时候,固化一阶段训练好的编码器。训练CAM和解码器。

该阶段作者提出了一种注意损失函数,CAM损失=强度损失+10*梯度损失

M

c

M_{c}

Mc代表单个模态的强度掩码

l

o

c

c

loc_c

locc代表单个模态源图像中局部patch的平均值,可以用下式计算:

a

v

g

c

avg_c

avgc代表通过11×11核大小的均值滤波器

∇

a

∇_a

∇a计算得到的单个模态的值。

∇

g

∇_g

∇g代表了3×3的均值滤波器

训练设置如下所示。

📉损失函数

上节已介绍。

🔢数据集

- 训练:KAIST

- 测试:TNO, VOT-RGBT

图像融合数据集链接

[图像融合常用数据集整理]

🔬实验

📏评价指标

- EN

- SD

- MI

- FMI_dct

- FMI_pixel

- SCD

扩展学习

[图像融合定量指标分析]

🥅Baseline

- FusionGAN, IFCNN, U2Fusion, YDTR, DATFuse, IRFS, SemLA, DDFM

✨✨✨扩展学习

✨✨✨强烈推荐必看博客[图像融合论文baseline及其网络模型]✨✨✨

🔬实验结果

更多实验结果及分析可以查看原文:

📖[论文下载地址]

🚀传送门

📑图像融合相关论文阅读笔记

📑[(DIF-Net)Unsupervised Deep Image Fusion With Structure Tensor Representations]

📑[(MURF: Mutually Reinforcing Multi-Modal Image Registration and Fusion]

📑[(A Deep Learning Framework for Infrared and Visible Image Fusion Without Strict Registration]

📑[(APWNet)Real-time infrared and visible image fusion network using adaptive pixel weighting strategy]

📑[Dif-fusion: Towards high color fidelity in infrared and visible image fusion with diffusion models]

📑[Coconet: Coupled contrastive learning network with multi-level feature ensemble for multi-modality image fusion]

📑[LRRNet: A Novel Representation Learning Guided Fusion Network for Infrared and Visible Images]

📑[(DeFusion)Fusion from decomposition: A self-supervised decomposition approach for image fusion]

📑[ReCoNet: Recurrent Correction Network for Fast and Efficient Multi-modality Image Fusion]

📑[RFN-Nest: An end-to-end resid- ual fusion network for infrared and visible images]

📑[SwinFuse: A Residual Swin Transformer Fusion Network for Infrared and Visible Images]

📑[SwinFusion: Cross-domain Long-range Learning for General Image Fusion via Swin Transformer]

📑[(MFEIF)Learning a Deep Multi-Scale Feature Ensemble and an Edge-Attention Guidance for Image Fusion]

📑[DenseFuse: A fusion approach to infrared and visible images]

📑[DeepFuse: A Deep Unsupervised Approach for Exposure Fusion with Extreme Exposure Image Pair]

📑[GANMcC: A Generative Adversarial Network With Multiclassification Constraints for IVIF]

📑[DIDFuse: Deep Image Decomposition for Infrared and Visible Image Fusion]

📑[IFCNN: A general image fusion framework based on convolutional neural network]

📑[(PMGI) Rethinking the image fusion: A fast unified image fusion network based on proportional maintenance of gradient and intensity]

📑[SDNet: A Versatile Squeeze-and-Decomposition Network for Real-Time Image Fusion]

📑[DDcGAN: A Dual-Discriminator Conditional Generative Adversarial Network for Multi-Resolution Image Fusion]

📑[FusionGAN: A generative adversarial network for infrared and visible image fusion]

📑[PIAFusion: A progressive infrared and visible image fusion network based on illumination aw]

📑[CDDFuse: Correlation-Driven Dual-Branch Feature Decomposition for Multi-Modality Image Fusion]

📑[U2Fusion: A Unified Unsupervised Image Fusion Network]

📑综述[Visible and Infrared Image Fusion Using Deep Learning]

📚图像融合论文baseline总结

📚[图像融合论文baseline及其网络模型]

📑其他论文

📑[3D目标检测综述:Multi-Modal 3D Object Detection in Autonomous Driving:A Survey]

🎈其他总结

🎈[CVPR2023、ICCV2023论文题目汇总及词频统计]

✨精品文章总结

✨[图像融合论文及代码整理最全大合集]

✨[图像融合常用数据集整理]文章来源:https://www.toymoban.com/news/detail-792005.html

🌻【如侵权请私信我删除】

如有疑问可联系:420269520@qq.com;

码字不易,【关注,收藏,点赞】一键三连是我持续更新的动力,祝各位早发paper,顺利毕业~文章来源地址https://www.toymoban.com/news/detail-792005.html

到了这里,关于图像融合论文阅读:CrossFuse: 一种基于交叉注意机制的红外与可见光图像融合方法的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!