1.背景介绍

线性代数和机器学习之间的关系是非常紧密的。线性代数是一门数学分支,它研究的是如何解决系统中的线性方程组问题。机器学习则是一门跨学科的研究领域,它旨在让计算机程序能够从数据中自动发现模式、关系和规律,并利用这些发现来进行预测、分类和决策。

在过去的几年里,机器学习技术在各个领域取得了显著的进展,例如自然语言处理、计算机视觉、医疗诊断等。这些成功的应用使得机器学习技术在商业、科学和日常生活中的重要性得到了广泛认识。然而,为了更好地理解和应用机器学习技术,我们需要对其背后的数学基础有一个深入的了解。

线性代数是机器学习的基石,它为机器学习算法提供了数学模型和工具。在本文中,我们将探讨线性代数与机器学习之间的关系,并深入解释其核心概念、算法原理、具体操作步骤和数学模型。我们还将通过具体的代码实例来展示如何将这些数学概念应用于实际的机器学习任务中。

2.核心概念与联系

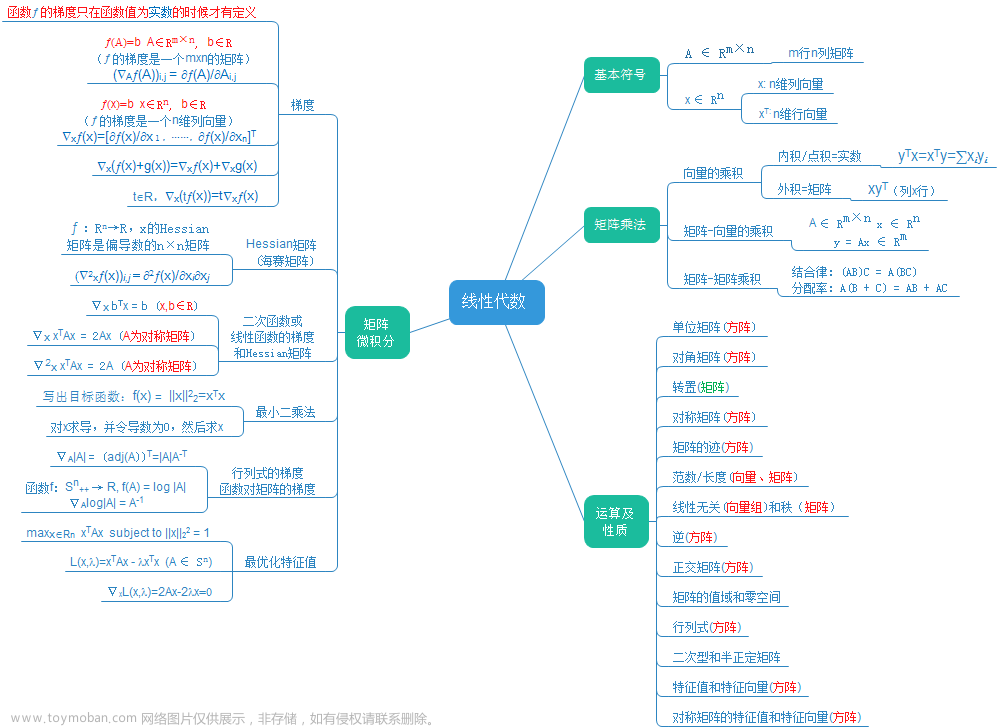

2.1 线性代数的基本概念

线性代数是一门数学分支,它研究的是如何解决系统中的线性方程组问题。线性代数的核心概念包括向量、矩阵、线性方程组、行列式、逆矩阵等。这些概念在机器学习中具有广泛的应用。

2.1.1 向量

向量是一个具有多个元素的有序列表。向量可以用括号、方括号或箭头符号表示。例如,在一维空间中,一个向量可以表示为 $(x_1, x_2, x_3)$,在二维空间中,一个向量可以表示为 $(x_1, x_2)$。向量在机器学习中常用于表示数据的特征和输出。文章来源:https://www.toymoban.com/news/detail-794241.html

2.1.2 矩阵

矩阵是一种特殊的表示方式,用于表示多个向量的集合。矩阵由行和列组成,每个单元称为元素。矩阵可以用括号、方括号或箭头符号表示。例如,一个二维矩阵可以表示为&#x文章来源地址https://www.toymoban.com/news/detail-794241.html

到了这里,关于线性代数与机器学习的紧密关系的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!