目录

一:requests

二:BeautifulSoup

三:Scrapy

四:Selenium

一:requests

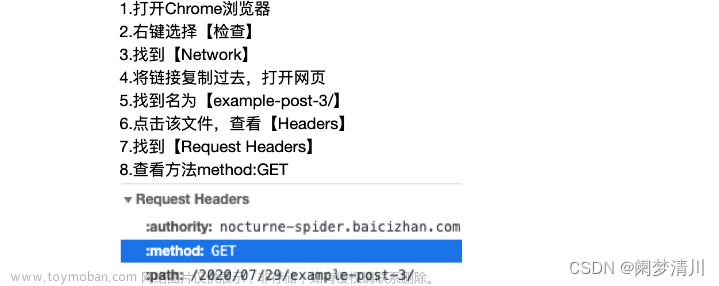

requests 是一个用于发送 HTTP 请求的 Python 库。它提供了简洁的 API 来发送各种类型的 HTTP 请求,如 GET、POST、PUT、DELETE 等,并处理响应。

import requests

# 发送 GET 请求

response = requests.get('https://www.example.com')

# 打印响应内容

print(response.text)

# 发送 POST 请求

data = {'key1': 'value1', 'key2': 'value2'}

response = requests.post('https://www.example.com/post', data=data)

# 打印响应内容

print(response.text)

二:BeautifulSoup

BeautifulSoup 是一个用于解析和操作 HTML 和 XML 文档的 Python 库。它被广泛用于网页抓取、数据提取、数据清洗和自动化测试等任务。

下面是 BeautifulSoup 的一些主要功能和特点:

HTML/XML 解析:BeautifulSoup 可以解析 HTML 和 XML 文档,并将其转换为树形结构,使得数据提取更加方便。

数据提取:使用 BeautifulSoup,你可以通过标签名、属性、内容等方式来查找和提取数据。

数据清洗:BeautifulSoup 提供了方便的方法来修改和清洗提取的数据。

自动编码:BeautifulSoup 能够自动检测输入文档的编码,并使用该编码来解析文档。

与 lxml 集成:BeautifulSoup 可以与 lxml 库集成,提供更快的解析速度。

灵活的导航、搜索和修改:BeautifulSoup 提供了强大的导航、搜索和修改功能,使你能够轻松地在文档树中移动并提取信息。

Pythonic API:BeautifulSoup 的 API 设计得非常 Pythonic,使得代码看起来简洁且易于理解。

与其他库的整合:BeautifulSoup 可以与其他 Python 库(如 requests)很好地整合,用于网络爬虫和数据抓取。

以下是一个简单的使用 BeautifulSoup 来解析 HTML 的例子

from bs4 import BeautifulSoup

import requests

# 获取网页内容

url = "https://example.com"

response = requests.get(url)

html_content = response.content

# 解析 HTML

soup = BeautifulSoup(html_content, "html.parser")

# 查找标题

title_tag = soup.title

print(title_tag) # 输出: <title>网站标题</title>

# 查找所有段落

p_tags = soup.find_all("p")

for tag in p_tags:

print(tag.text) # 输出段落内容

三:Scrapy

Scrapy是一个用于从网站上抓取数据的Python框架。它是一个用于网络爬虫和数据抓取的强大工具,可以帮助开发人员快速构建和部署爬虫。Scrapy提供了许多内置的功能,如请求处理、数据提取、爬虫管理等,以及易于使用的API,使开发人员能够轻松地编写高效的爬虫。

Scrapy使用异步IO框架Twisted,具有高性能和可扩展性。它支持多种数据提取方法,如CSS选择器、XPath等,并提供了方便的API来处理HTML和XML内容。Scrapy还支持多种存储后端,如关系型数据库、NoSQL数据库等,方便将抓取的数据存储到各种存储系统中。

使用Scrapy可以快速构建爬虫,并且可以轻松地定制和扩展其功能。Scrapy的社区非常活跃,提供了丰富的资源和文档,帮助开发人员更好地使用这个框架。总之,Scrapy是一个功能强大、易于使用和高度可扩展的Python网络爬虫框架,适用于各种数据抓取和爬虫应用场景。

import scrapy

class MyspiderSpider(scrapy.Spider):

name = 'myspider'

allowed_domains = ['example.com']

start_urls = ['http://example.com']

def parse(self, response):

for link in response.css('a::attr(href)').getall():

yield scrapy.Request(response.urljoin(link), self.parse)

四:Selenium

Selenium是一个用于Web应用程序的测试工具,可以模拟用户与网页的交互,例如点击、填写表单和滚动页面等。Selenium还提供了自动化测试的功能,可以通过编写测试脚本对Web应用程序进行测试,并生成测试报告。

Python是一种流行的编程语言,可以与Selenium结合使用,编写自动化测试脚本。Python提供了多种库和框架,例如unittest、pytest和Selenium WebDriver等,这些库和框架可以帮助您编写高效、可维护的测试脚本。

下面是一个简单的Python Selenium WebDriver示例,用于打开一个网页并查找特定的元素:

from selenium import webdriver

# 启动Chrome浏览器驱动程序

driver = webdriver.Chrome()

# 打开网页

driver.get("https://www.example.com")

# 查找元素

element = driver.find_element_by_id("myElement")

# 点击元素

element.click()

# 关闭浏览器

driver.quit()文章来源:https://www.toymoban.com/news/detail-798544.html

文章来源地址https://www.toymoban.com/news/detail-798544.html

文章来源地址https://www.toymoban.com/news/detail-798544.html

到了这里,关于python下常用的爬虫模块的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!