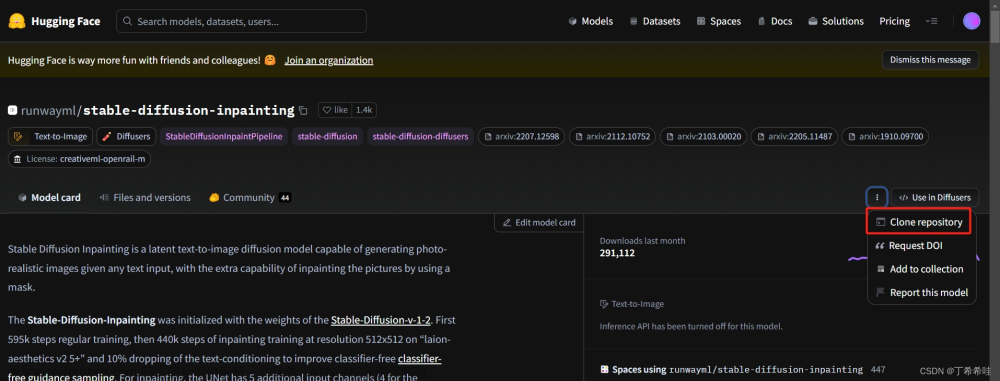

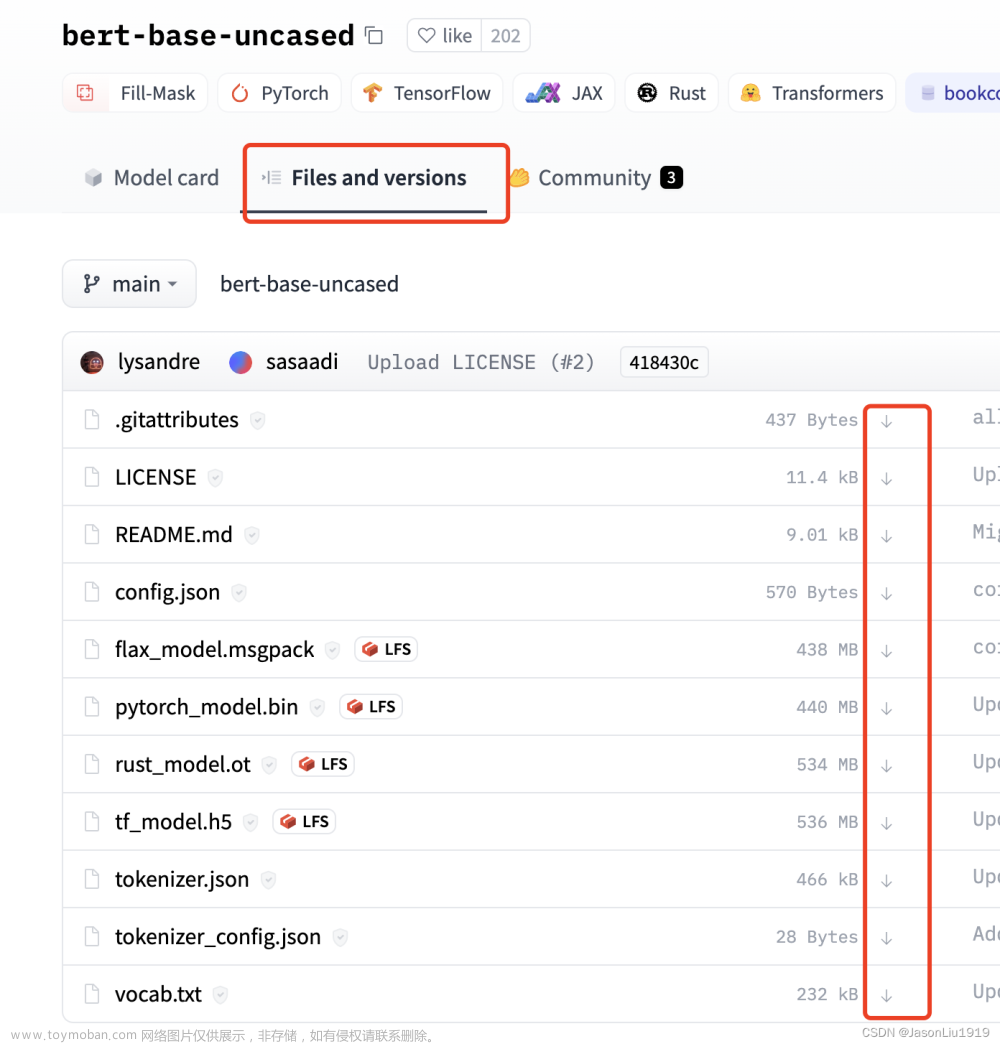

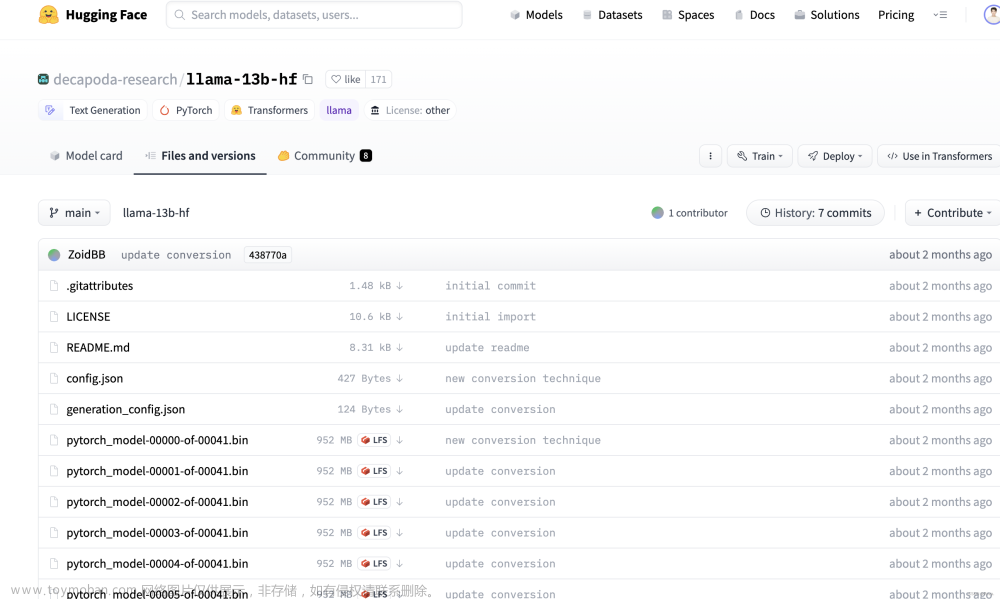

huggingface 下载模型

如果服务器翻墙了,不用租机器

如果服务器没翻墙,可以建议使用下面的方式

可以租一台**autodl**不用显卡的机器,一小时只有1毛钱,启动学术加速,然后下载,下载完之后,用scp拷贝到目标机器

autodl学术加速启动

source /etc/network_turbo

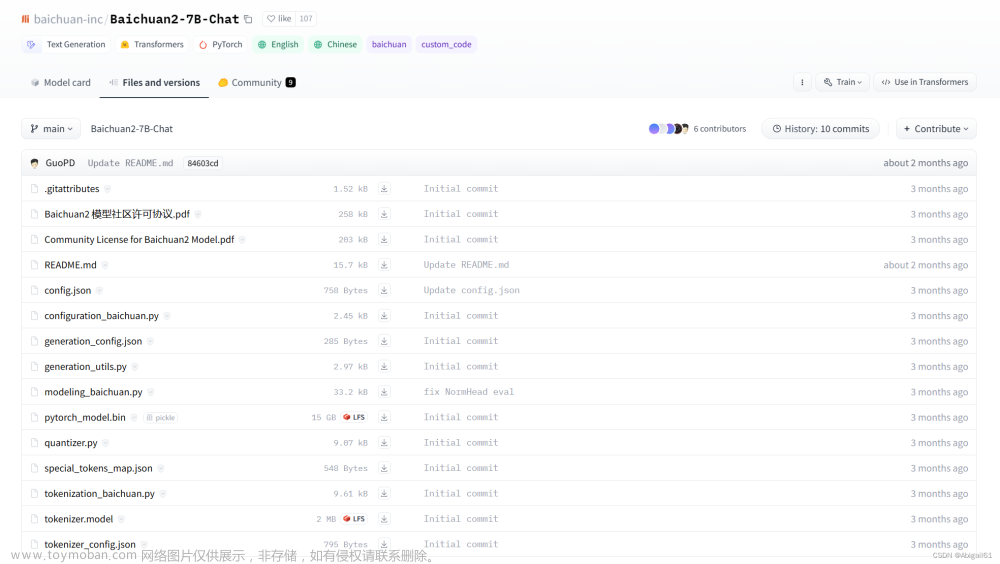

from huggingface_hub import snapshot_download

model_path = "baichuan-inc/Baichuan-13B-Chat"

cache_dir = "model/Baichuan-13B-Chat"

snapshot_download(repo_id=model_path, local_dir=cache_dir, local_dir_use_symlinks=False)

魔塔下载模型

不需要翻墙

pip install modelscope

下载模型代码

from modelscope import snapshot_download

model_path="Qwen/Qwen-14B-Chat"

cache_path="/root/autodl-tmp/Qwen-14B-Chat"

snapshot_download(model_path, cache_dir=cache_path)

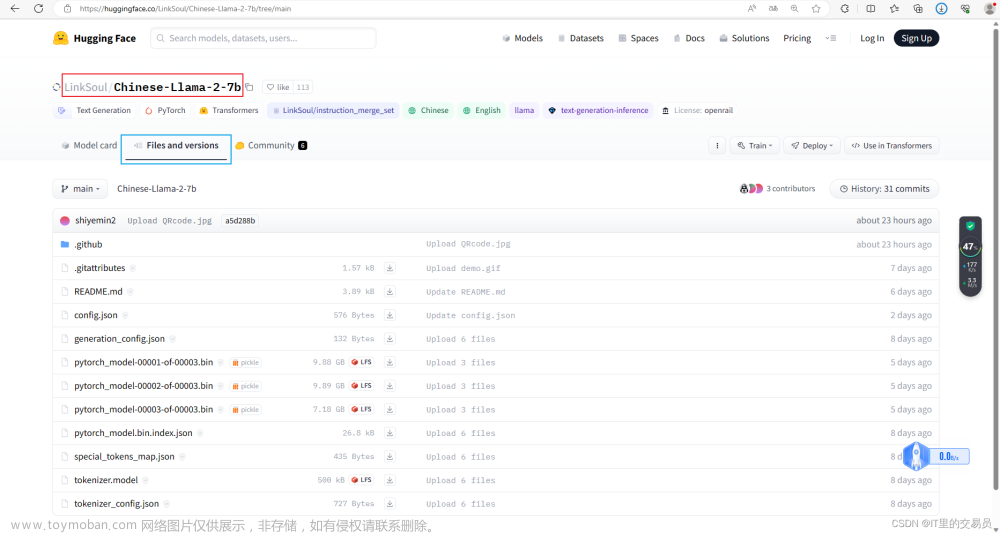

huggingface镜像

huggingface镜像不好用,下载特别慢,几十k,而且下载到80%左右就报错,停止,建议用上面的两种方法

huggingface-cli download --resume-download --local-dir-use-symlinks False Qwen/Qwen-14B-Chat --local-dir /root/autodl-tmp/Qwen-14B-Chat

本站域名 hf-mirror.com,用于镜像 huggingface.co 域名。

更多用法(多线程加速等)详见这篇文章。简介:

方法一:使用huggingface 官方提供的 huggingface-cli 命令行工具。

(1) 安装依赖

pip install -U huggingface_hub

(2) 基本命令示例:

export HF_ENDPOINT=https://hf-mirror.com

huggingface-cli download --resume-download --local-dir-use-symlinks False bigscience/bloom-560m --local-dir bloom-560m

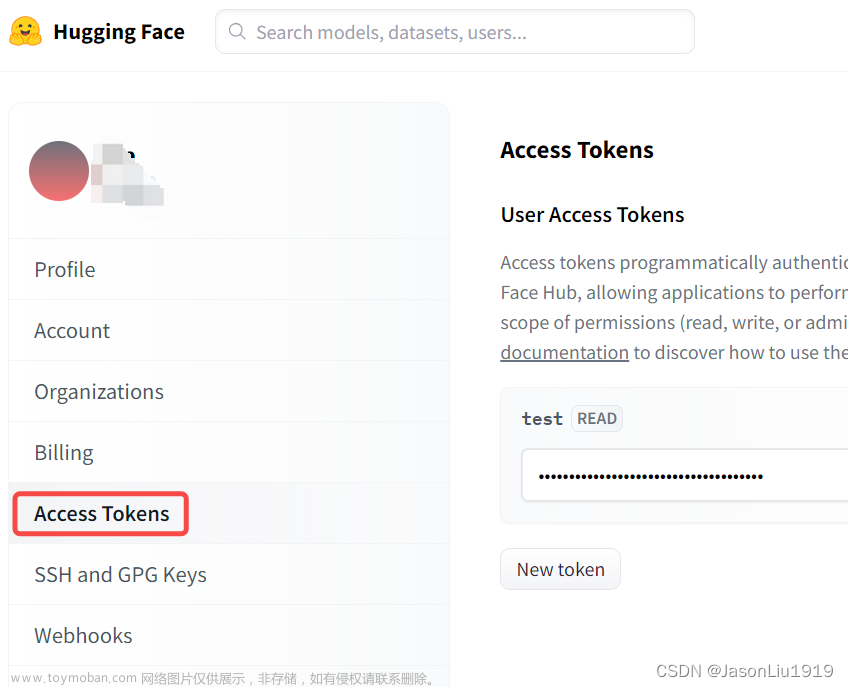

(3) 下载需要登录的模型(Gated Model)

请添加–token hf_***参数,其中hf_***是 access token,请在huggingface官网这里获取。示例:

huggingface-cli download --token hf_*** --resume-download --local-dir-use-symlinks False meta-llama/Llama-2-7b-hf --local-dir Llama-2-7b-hf

方法二:使用url直接下载时,将 huggingface.co 直接替换为本站域名hf-mirror.com。使用浏览器或者 wget -c、curl -L、aria2c 等命令行方式即可。

下载需登录的模型需命令行添加 --header hf_*** 参数,token 获取具体参见上文。

方法三:(非侵入式,能解决大部分情况)huggingface 提供的包会获取系统变量,所以可以使用通过设置变量来解决。文章来源:https://www.toymoban.com/news/detail-799444.html

HF_ENDPOINT=https://hf-mirror.com python your_script.py

不过有些数据集有内置的下载脚本,那就需要手动改一下脚本内的地址来实现了文章来源地址https://www.toymoban.com/news/detail-799444.html

到了这里,关于大语言模型下载,huggingface和modelscope加速的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!

![[NLP]Huggingface模型/数据文件下载方法](https://imgs.yssmx.com/Uploads/2024/02/603970-1.png)