0 要点

说明:本文在于能够让大家能够更加快速地了解MIL这个领域,因此将从以下几个方面重点介绍MIL (这里不详细介绍每一篇文章,只做概述)。

注1:欢迎和我进一步交流,可以加入我建立的QQ群 (2024年1月15日建立,没啥人hhh);

注2:如果给出的文章包含代码,可以点击其名称缩写获取;

注3:承2,如果包含博客讲解,可以点击其全称获取;

1 多示例背景介绍

概述:多示例学习 (MIL) 是一种典型的弱监督学习,其输入的单个样本被称为包 (bag),包中包含多个实例 (instance)。在训练阶段,通常只有包的标签可知,而实例的标签不可知或者获取成本极高。因此,概括性的,MIL与传统机器学习的主要区别在于:

- 弱监督场景:实例的数量巨大却没有标签,仅通过包标签来预测未知类,甚至预测实例标签是极具挑战性的;

- 数据结构:包是多个实例的集合,实例可以是向量、图像、视频等任意结构,因此传统机器学习可以看作是MIL的一种特殊情况;

纵观MIL发展历程,其可以分为几个阶段:

- 早期:从Dietterich团队的药物活性预测研究开始,尝试直接使用传统的机器学习方法解决MIL问题;

- 发展:尝试MIL问题的转换,通常使用嵌入函数或包相似性度量来将其简化为传统的机器学习问题;

- 深度:利用深度学习的强大特征提取及表征能力,直接预测包的标签,这也是目前MIL研究的重点;

- 应用:考虑更多背景信息,如视频的时序、医疗图像相邻区块的关联性,以更好地处理实际任务;

2 理论MIL概述

之所以优先介绍传统MIL方法,究其原因为:

- 传统MIL方法包含众多实用策略,其思想内核至今仍被前沿的深度MIL方法使用;

- 传统方法均可被深度MIL直接或间接复刻,通过对齐首要了解,可以为后续深度MIL方法学习打下基础;

2.1 传统MIL方法

传统MIL方法大致分为三种:

- 实例方法:首先预测实例标签,并通过MIL假设计算包标签;

- 包方法:设计类似于高斯核的MIL包距离度量,使得 k k kNN和SVM等基于距离矩阵的方法得以施展;

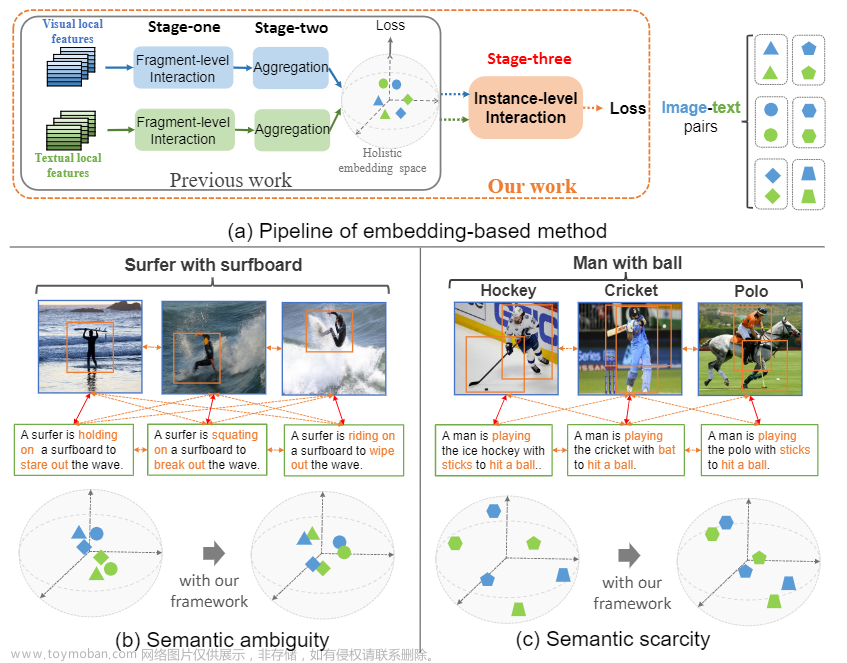

- 嵌入方法:将包转换为向量,使得传统机器学习策略生效,这也是目前MIL表征学习的基础;

当然,立足于深度MIL方法的小伙伴只需大致了解这类方法。以下是对一些经典方法的归类:

| 方法名 | 团队 | 期刊/会议 | 全称 | 思想 | 领域 |

|---|---|---|---|---|---|

| MINTL | 广东工业大学 | TNNLS’24 | Multi-instance nonparallel tube learning | 基于优化理论的类边界信息学习,以提升模型性能 | 理论 |

| ISK | 周志华 | KDD‘19 | Isolation set-kernel and its application to multi-instance learning | 基于孤立核设置集合核和嵌入函数 | 理论 |

| MILDM | 悉尼科技大学 | TKDE’18 | Multi-instance Learning with discriminative bag mapping | 利用辨别性优化嵌入结果 | 理论 |

| miVLAD | 周志华 | TNNLS’16 | Scalable algorithms for multi-instance learning | 基于 k k kMeans聚类的高效MIL算法 | 理论 |

| miFV | 周志华 | ICDM’14 | Scalable multi-instance learning | 混合高斯模型及Fisher核编码包为向量 | 理论 |

| BAMIL | 周志华 | Applied Intelligence’09 | Multi-instance clustering with applications to multi-instance prediction | 利用包距离度量和 k k kMeans聚类获取包嵌入向量 | 理论 |

2.2 注意力网络

注意力机制的引入是深度MIL发展史上的一次伟大变革,其以Ilse等人发表的ABMIL和GAMIL为伊始,并深刻影响着后续MIL算法的发展。后续的基于对比学习、介入学习等策略的MIL大都围绕其展开,只是方法的侧重有所不同:

| 方法名 | 团队 | 期刊/会议 | 全称 | 思想 | 领域 |

|---|---|---|---|---|---|

| IBMIL | 上海交通大学 | CVPR’23 | Interventional bag multi-instance learning on whole-slide pathological images | 基于训练模型和 k k kMeans的全局特征提取 | WSI |

| MHIM-MIL | 香港科技大学 | CVPR’23 | Multiple instance learning framework with masked hard instance mining | 基于蒙版硬实例和软实例的孪生网络 | WSI |

| ItS2CLR | 纽约大学 | CVPR’23 | Multiple instance learning via iterative self-paced supervised contrastive learning | 实例伪标签提升表示学习质量,并通过自步采用策略优化 | WSI |

| CHEESE | 大连理工大学 | IEEE TCDS’23 | Multiple instance learning for cheating detection and localization in online examinations | 综合被检测人员的眼睛注视、头部姿势和面部特征等信息来学习模型 | VAD |

| LNPL-MIL | 清华大学 | ICCV’23 | LNPL-MIL: Learning from noisy pseudo labels for promoting multiple instance learning in whole slide image | 提出了一种更准确的Top- k k k实例选择策略,并设计了一个能够感知实例顺序和分布的Transformer | WSI |

| CausalMIL | 东南大学 | NeurIPS’22 | Multi-instance causal representation learning for instance label prediction and out-of-distribution generalization | 获得实例级因果表示并考虑OOD问题 | 理论 |

| ZoomMIL | IBM 欧洲研究院 | ECCV’22 | Differentiable zooming for multiple instance learning on whole-slide images | 多尺度WSI同时输入 | WSI |

| DSMIL | 威斯康星大学 | CVPR’21 | Dual-stream multiple instance learning network for whole slide image classification with self-supervised contrastive learning | 双流架构及自监督对比学习 | WSI |

| TransMIL | 清华大学 | NeurIPS‘21 | TransMIL: Transformer based correlated multiple instance learning for whole slide image classification | 基于Transformer的相关型MIL框架 | WSI |

| LAMIL | 佛罗里达大学 | AAAI’20 | Loss-based attention for deep multiple instance learning | 额外添加实例损失优化模型且提供理论证明 | 理论 |

| ABMIL&GAMIL | 阿姆斯特丹大学 | ICML’18 | Attention-based deep multiple instance learning | 设计了两种注意力机制来捕捉包中的关键实例 | 理论 |

2.3 对比学习

| 方法名 | 团队 | 期刊/会议 | 全称 | 思想 | 领域 |

|---|---|---|---|---|---|

| ItS2CLR | 纽约大学 | CVPR’23 | Multiple instance learning via iterative self-paced supervised contrastive learning | 实例伪标签提升表示学习质量,并通过自步采用策略优化 | WSI |

| SMILES | 东北大学 | AAAI’23 | Robust self-supervised multi-instance learning with structure awareness | 引入无监督对比学习来获取包表示 | 理论 |

2.4 介入学习

| 方法名 | 团队 | 期刊/会议 | 全称 | 思想 | 领域 |

|---|---|---|---|---|---|

| IBMIL | 上海交通大学 | CVPR’23 | Interventional bag multi-instance learning on whole-slide pathological images | 基于训练模型和 k k kMeans的全局特征提取 | WSI |

2.5 强化学习

2.6 GAN

3 MIL交叉领域

3.1 多示例偏标签

3.2 多示例多标签

3.3 多示例正和无标签学习

正和无标签学习 (PU) 的训练集中只包含正样本和无标记样本,对应的问题有叶片上的异常结冰检测、诈骗邮件检测等。文章来源:https://www.toymoban.com/news/detail-800212.html

| 方法名 | 团队 | 期刊/会议 | 全称 | 思想 | 领域 |

|---|---|---|---|---|---|

| PU-MIL-AD | 鲁汶大学 | KDD’23 | Learning from positive and unlabeled multi-instance bags in anomaly detection | 在MIL中首次引入PU学习的概念,并基于VAE进行异常检测 | Anomaly Detection |

3.4 多示例对抗攻击及防御

考虑MIL的弱监督设置,通过添加对抗扰动的方式愚弄MIL分类器,以解释模型的脆弱性和安全性。此外,对抗防御则用于降低MIL攻击者的效能。文章来源地址https://www.toymoban.com/news/detail-800212.html

| 方法名 | 团队 | 期刊/会议 | 全称 | 思想 | 领域 |

|---|---|---|---|---|---|

| CAF-GAN | 韩国航空航天大学 | IEEE TIFS’23 | A robust open-set multi-instance learning for defending adversarial attacks in digital image | 基于GAN的对抗防御及数字取证研究 | Anti-forensic |

| MI-CAP&MI-UAP | 西南交通大学 | PR’23 | Interpreting vulnerabilities of multi-instance learning to adversarial perturbations | 首次在MIL中引入对抗攻击,以解释算法的脆弱性,后续可作为数据增强策略等 | 理论 |

3.5 多示例分布外检测

3.6 多模态多示例

4 应用MIL概述

4.1 全幻灯片分类

4.2 视频异常检测

4.3 图像分类

4.4 调制识别

4.5 Benchmark

到了这里,关于多示例学习 (multi-instance learning, MIL) 学习路线 (归类、重点文章列举、持续更新)的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!