文章来源地址https://www.toymoban.com/news/detail-803964.html

文章来源地址https://www.toymoban.com/news/detail-803964.html

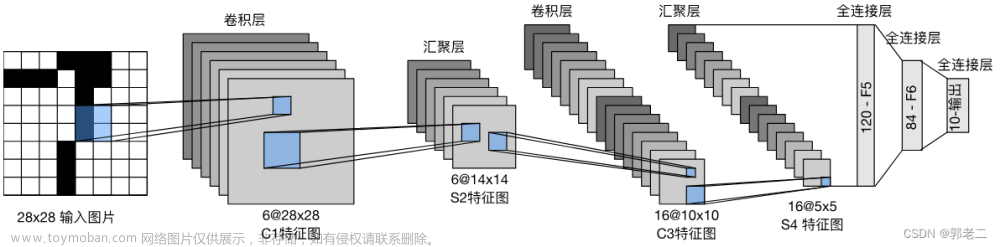

1. 多层神经网络

1.1. 这一被明斯基和佩珀特所摒弃的、认为很有可能“不育的”带有扩展层的感知机,事实证明反而成了现代人工智能的基础

1.2. 网络是以多种方式相互连接的一组元素的集合

1.2.1. 社交网络的元素是人

1.2.2. 计算机网络中的元素自然是计算机

1.3. 隐藏单元

1.3.1. 表示的是一个非输出单元

1.3.2. 称之为“内部单元”(interior unit)可能更好

1.3.3. 每个隐藏单元与每个输出单元之间都有一个加权连接

1.4. 多层神经网络,因为它包含两层结构,即一个隐藏层和一个输出层,而非仅有一个输出层

1.5. 多层神经网络可以有多层隐藏单元,具有多于一层隐藏单元的网络被称为“深度网络”(deep networks)

1.5.1. 对几乎所有的这些公司来说,人工智能基本上等同于深度学习

1.5.2. 网络的深度就是其隐藏层的数量

1.6. 多层神经网络中的每个单元将它的每个输入乘以其权重并求和

1.6.1. 与感知机不同的是,这里的每个单元并不是简单地基于阈值来判断是“激活”还是“不激活”(输出1或0)

1.6.2. 使用它求得的和来计算一个0~1之间的数,称为激活值

1.6.3. 如果一个单元计算出的和很小,则该单元的激活值接近0

1.6.4. 如果计算出的和很高,则激活值接近1

1.6.5. 具有最高置信度的数字类别被认为是它的答案

1.6.5.1. 它给出的分类

1.7. 多层神经网络能够学会使用其隐藏单元来识别更为抽象的特征

1.7.1. 一个手写的8的上半部分和下半部分这种形状

1.7.2. 它要比像素这种简单特征抽象得多

1.8. 很难提前知道,对于一个给定的任务,一个神经网络到底需要多少层隐藏单元,以及一个隐藏层中应该包含多少个隐藏单元才会表现更好,大多数神经网络研究人员采用试错的方式来寻找最佳设置

1.9. 神经网络不仅可以被应用于图像,也可以被应用于任何领域、任何类型的数据,如语音识别、股市预测、语言翻译和音乐创作等

1.10. 猫识别机

1.10.1. 2012年,谷歌的一个人工智能团队构建了一个“观看”了数百万个随机YouTube视频的多层神经网络,该网络具有超过10亿个权重,并且能够为了成功地压缩并解压视频中选定的帧而对这些权重进行调整

1.10.1.1. 谷歌的研究人员并没有告诉系统要去学习任何特定的对象

1.10.1.2. 经过一星期的训练之后一个似乎能够识别猫的神经元(单元)

1.10.2. 这台自学成才的“猫识别机”是过去10年中引起公众关注的一系列人工智能成就之一

1.10.2.1. 这些成就大多归功于被统称为深度学习的一系列神经网络算法

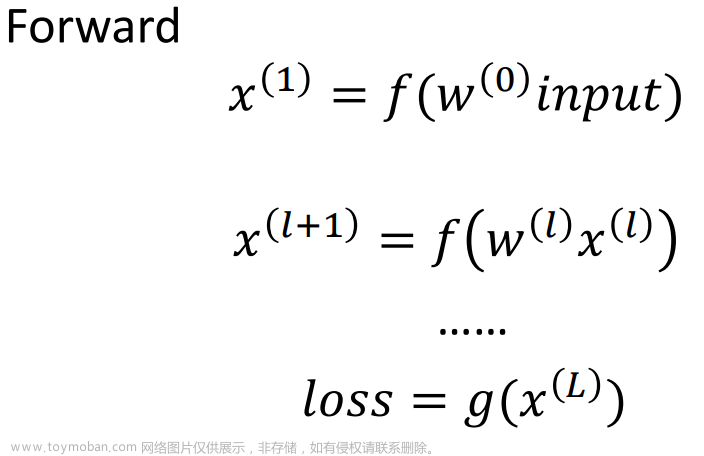

2. 反向传播

2.1. 到了70年代末和80年代初,这些研究小组中的一些人开发了一种名为“反向传播”(back-propagation)的通用学习算法来对网络进行训练

2.1.1. 有力地驳斥了明斯基和佩珀特对于多层神经网络“不育性”的猜测

2.2. 反向传播算法是一种对输出端观察到的错误进行反向罪责传播,从而为网络中的每个权重都分配恰当罪责的方法

2.2.1. 反向罪责传播是指,从右向左追溯罪责源头

2.2.2. 这使得神经网络能够确定为减少错误应该对每个权重修改多少

2.2.3. 神经网络中所谓的学习就是逐步修改连接的权重,从而使得每个输出在所有训练样本上的错误都尽可能接近于零

2.2.4. 无论神经网络有多少个输入单元、隐藏单元和输出单元,反向传播都能行得通,至少原则上如此

2.3. 反向传播算法在许多对于简单感知机来说很难的任务上都表现得非常好

3. 联结主义

3.1. 智能的关键在于构建一个合适的计算结构

3.2. “联结主义”(connectionist)

3.2.1. 这些网络上的知识存在于单元之间的加权连接中

3.3. 到20世纪80年代中期,依赖人类创建并反映特定领域专家知识规则的符号人工智能方法——专家系统,越来越暴露出自身的脆弱性

3.3.1. 容易出错,且在面对新情况时往往无法进行一般化或适应性的处理

3.4. 在分析这些系统的局限性时,研究人员发现,编写规则的人类专家实际上或多或少依赖于潜意识中的知识(常识)以便明智地行动

4. 亚符号系统的本质

4.1. 符号系统可以由人类设计,被输入人类知识,并使用人类可理解的逻辑推理来解决问题

4.1.1. 为了与符号人工智能区分开来,机器学习成了人工智能领域一个独立的分支学科

4.2. 亚符号系统往往难以阐释,并且没人知道如何直接将复杂的人类知识和逻辑编码到这些系统中

4.3. 亚符号系统似乎更适合那些人类难以定义其中规则的感知任务

4.3.1. 你很难写出能够完成识别手写数字、接住棒球或识别你母亲声音等任务的规则

4.3.2. 你基本上是连下意识的思考都没有经过就自动完成了这些事情

4.3.3. 不擅长逻辑,擅长接飞盘

4.4. 完全可以用符号系统来完成类似于语言描述和逻辑推理的高级任务

4.5. 用亚符号系统来完成诸如识别人脸和声音这样的低级感知任务

4.6. 这两个领域之间几乎没有任何联系

4.6.1. 两种方法都曾在其各自细分的领域里获得了重要的成功

4.6.2. 对于实现人工智能的最初目标还有很大的局限性

4.6.3. 尽管已经有一些融合符号和亚符号系统来构建混合系统的尝试,但至今还未取得任何显著的成功

5. 讽刺

5.1. 当IBM的深蓝系统在1997年击败国际象棋世界冠军加里·卡斯帕罗夫时卡斯帕罗夫极其震惊,以至于他指控IBM的团队作弊

5.2. 在2006年世界象棋锦标赛中,局面发生了逆转,有一名棋手指控另一名棋手通过接受计算机象棋程序的帮助作弊

5.3. 一旦它开始奏效,就没人再称它为人工智能了。

5.3.1. 麦卡锡

5.3.2. 当计算机在某一特定任务上超越人类时,我们就得出结论,该任务实际上并不需要智能

5.3.3. 我们接受了国际象棋是可以屈服于暴力搜索机器的,我们认为下棋下得好一点都不需要通用智能

5.4. YouTube开始为视频提供相当精确的自动字幕

5.5. 即时通信软件Skype则可在多语言的视频通话中提供同声传译

5.6. Facebook甚至可以在上传的照片中识别出你的脸了

5.7. 照片分享网站Flickr也开始用描述照片内容的文字来对图片进行自动标注了

5.8. AlphaGo的程序在5局比赛的4局里击败了世界上最好的棋手之一

5.8.1. AlphaGo可能是世界上最好的围棋玩家,但除此之外什么也做不了,它甚至不会玩跳棋、井字棋等游戏

5.9. 谷歌翻译可以把英文的影评翻译成中文,但它无法告诉你影评者是否喜欢这部电影,更不用说让它自己来观看和评论电影了

5.10. “狭义”和“弱”人工智能往往是与“强”“人类水平”“通用”或“全面”人工智能(有时候也被称作AGI,即通用人工智能)对比而言

5.11. 通用人工智能是人工智能领域研究最初的目标,但后来研究者发现实现这一目标比预期要困难得多

5.12. 要困难得多。随着时间的推移,人工智能领域的工作开始聚焦于特定的、定义明确的任务,如语音识别、下棋、自动驾驶等

5.13. 创造能执行这些功能的机器很有用并且往往利润丰厚,可以说这些任务中的任何一个都需要某种具体的智能

5.14. 至今人们还没有创建出任何能够在通用意义上被称为“智能”的人工智能程序

6. 思考

6.1. 人工智能是在模拟思考,还是真的在思考

6.2. 从神学角度看,思考是人类不朽之灵魂的一种功能,上帝赋予了每个人不朽的灵魂,但并没有将其赋予其他任何动物或机器,因此没有动物或机器能够进行思考

6.3. 从超心理学角度看,人类可以使用心灵感应进行交流,而机器不能

6.4. 图灵认为后面这个论点是“非常强大的”,因为至少对于心灵感应来说,统计证据是无法辩驳的

6.5. 只有当一台机器能“感受”事物,并知道自己的行为和感觉,即具有意识时,我们才能认为它是真正在思考

6.5.1. 没有一台机器能够做到这点,因此,没有一台机器能够真正地思考

6.6. 多年来,图灵测试已上演过多次,其中计算机参赛者是聊天机器人,即专门用来进行对话的程序,其他任何事情它们都不会做

6.7. 至少可以在计算机中运用大脑的基本原理并复制其智能

6.7.1. 这种逆向工程是一种实用的、短期内能实现的创造人类水平的人工智能的方法

6.8. 提供一项教育可能需要花费很多年的时间

6.8.1. 一旦人工智能掌握了人类基本的语言技能,它将能通过快速阅读所有的人类文献以及吸收数百万网站上的开源知识,来扩展自己的语言技能和通用知识

6.9. 人类学习的根本模式是经验性的

6.9.1. 关于经验的知识,在很大程度上是隐性的,也就是说,这些知识从来不被直接和明确地表达,那就无法从书本中找到

文章来源:https://www.toymoban.com/news/detail-803964.html

到了这里,关于读AI3.0笔记03_神经网络的文章就介绍完了。如果您还想了解更多内容,请在右上角搜索TOY模板网以前的文章或继续浏览下面的相关文章,希望大家以后多多支持TOY模板网!